AgentLM:对齐Agent能力的大模型来了!7B/13B/70B全开源

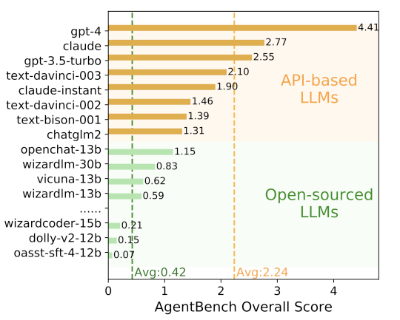

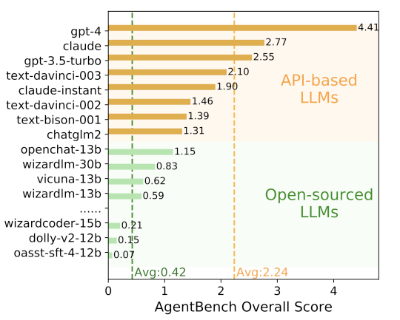

AgentLM:对齐Agent能力的大模型来了!7B/13B/70B全开源智谱AI&清华KEG提出了一种对齐 Agent 能力的微调方法 AgentTuning,该方法使用少量数据微调已有模型,显著激发了模型的 Agent能力,同时可以保持模型原有的通用能力。

搜索

搜索

智谱AI&清华KEG提出了一种对齐 Agent 能力的微调方法 AgentTuning,该方法使用少量数据微调已有模型,显著激发了模型的 Agent能力,同时可以保持模型原有的通用能力。

阿里巴巴算法工程师手把手教你部署AI模型

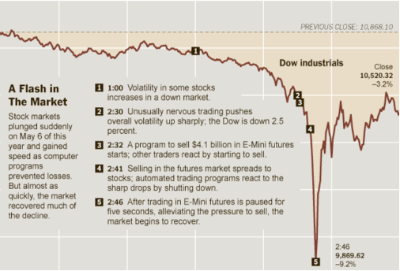

GPT-4根本不知道自己犯错?最新研究发现,LLM在推理任务中,自我纠正后根本无法挽救性能变差,引AI大佬LeCun马库斯围观。

Inc42 题为《2023 年印度生成式 AI 初创公司格局》的最新报告,该国的 GenAI 市场将在未来几年呈指数级增长。预计到 2030 年,这一数字将从 2023 年的 11 亿美元突破 170 亿美元,复合年增长率为 48%。

英伟达最新AI AgentEureka ,用GPT-4生成奖励函数,结果教会机器人完成了三十多个复杂任务。

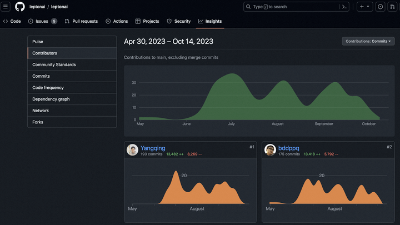

最近,智源、清华和北大联合发布了全新的10亿参数的3D视觉通用模型——Uni3D,在主流3D视觉能力上取得了全方位的性能突出!

Meta AI研发新成果,利用脑电信号将人类大脑活动解码并可视化。这项研究开辟了一条前所未有的新途径,能够帮助科学界了解图像如何在大脑中表示,进一步揭示人类智能的其他方面。

神经网络可以识别出哪些引用是不支持文章观点的,并且搜索出更好的来源作为引用。这是一个对于AI写论文领域的重要发现。

最近多模态大模型是真热闹啊。 这不,Transformer一作携团队也带来了新作,一个规模为80亿参数的多模态大模型Fuyu-8B

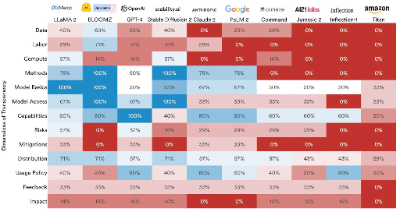

斯坦福大学的研究人员公布了一套 "基础模型透明度指数"评分系统,目的是让大家对AI模型有更深的了解

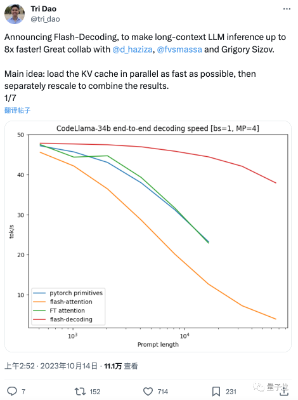

这两天,FlashAttention团队推出了新作: 一种给Transformer架构大模型推理加速的新方法,最高可提速8倍。 该方法尤其造福于长上下文LLM,在64k长度的CodeLlama-34B上通过了验证

ChatGPT之类的AI编码工具来势汹汹,Stack Overflow又裁员了!不过,普林斯顿和芝大竟发现,面对真实世界GitHub问题,GPT-4的解决率竟是0%。

Zilliz和 Dify.AI 达成合作,Zilliz 旗下的产品 Zilliz Cloud、Milvus 与开源 LLMOps 平台 Dify 社区版进行了深度集成。

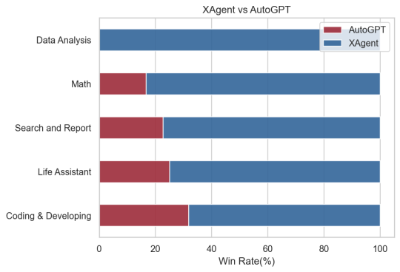

国内领先的人工智能大模型公司面壁智能又放大招,联合清华大学 NLP 实验室共同研发并推出大模型「超级英雄」——XAgent。

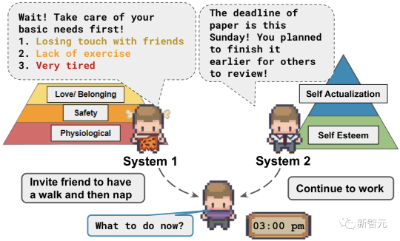

英伟达、华盛顿大学等机构提出的Humanoid Agents,行为竟如此接近人类!累了要休息,孤独要找人陪,发泄怒火时会跑步或冥想。

早就听说笔记本PC就能跑生成式AI,我们也试了试,看看笔记本仅借助CPU能不能在本地自己写代码、自己作图?

Agent 的思路为我们带来了 Software 2.0 的图景:LLM 作为推理引擎能力不断增强,AI Agent 框架为其提供结构化思考的方法,软件生产进入“3D 打印”时代

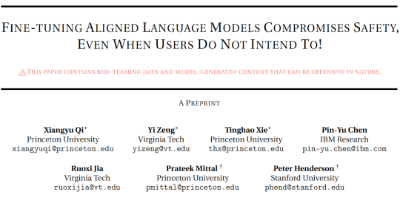

微调LLM需谨慎,用良性数据、微调后角色扮演等都会破坏LLM对齐性能!学习调大了还会继续提高风险!

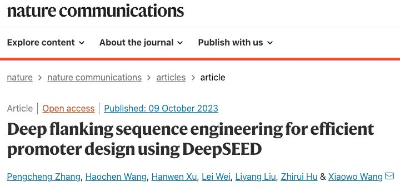

清华大学自动化系汪小我团队在 Nature Communications 期刊发表论文,研究提出了一种将专家知识与大数据学习相融合的合成启动子人工智能辅助设计方法——DeepSEED

悟道·天鹰Aquila大语言模型系列全面升级到Aquila2,并再添 340亿参数(34B)重量级新成员,带来当前最强的开源中英双语大模型。

在自己的系统上部署大型语言模型可能会出人意料地简单 - 前提是你拥有正确的工具。以下是如何在桌面上使用像Meta的新Code Llama这样的LLM的方法。

人工智能价值对齐(AI alignment)是关涉AI控制与AI安全的重要问题,随着人工智能的飞速发展和广泛应用,人工智能可能带来的风险和挑战也日益凸显,由此,“价值对齐”问题开始被广泛讨论和提及。

复旦大学马剑鹏教授领衔的科研团队开发的新型计算方法OPUS-DSD,不但能够成功地解析冷冻电子显微镜(Cryo-EM)结构解析技术中因传统方法无法分辨而缺损的生物大分子结构,并且高效精准地分辨出柔性结构域在受测样品中的构象分布。

研究人员已经找到了解决数字图像准确性和美观性之间基本权衡的方法

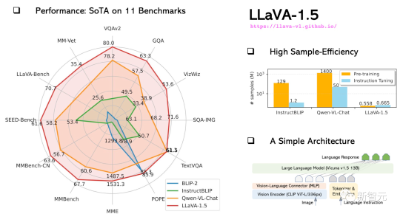

GPT-4V风头正盛,LLaVA-1.5就来踢馆了!它不仅在11个基准测试上都实现了SOTA,而且13B模型的训练,只用8个A100就可以在1天内完成。

在大语言模型内部,是否有一个世界模型?LLM是否具有空间感?并且在多个时空尺度上都是如此? 最近,MIT的几位研究者发现,答案是肯定的!

悄无声息,羊驼家族“最强版”来了! 与GPT-4持平,上下文长度达3.2万token的LLaMA 2 Long,正式登场。

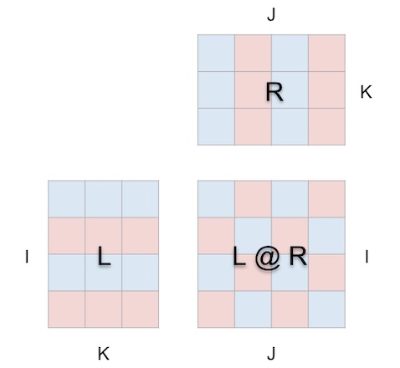

矩阵乘法已经成为机器学习模型的构建模块,是各种强大 AI 技术的基础,了解其执行方式必然有助于我们更深入地理解这个 AI 以及这个日趋智能化的世界。

艾瑞发布《AIGC系列报告——中国AIGC产业全景报告》,作为AIGC系列首发,报告将展开对AIGC产业的全景洞察、探究生成式AI技术对数字产业的影响变化

有效的压缩就是要找到模式,在不丢失信息的情况下将数据变小。当一种算法或模型能准确猜出序列中的下一条数据时,就表明它善于发现这些模式。