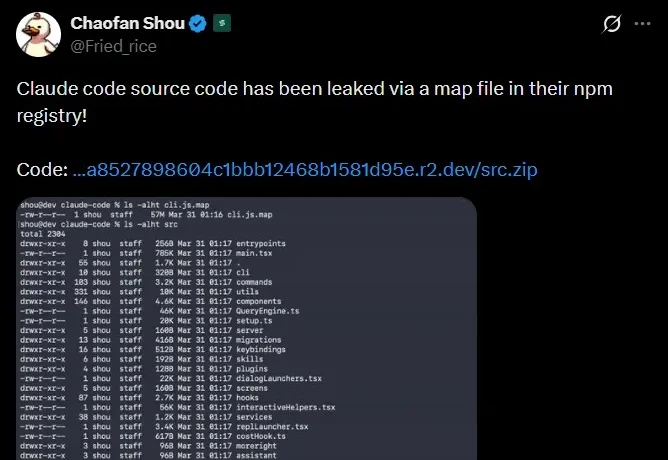

Claude Code 源码泄漏了,但我不打算写源码分析分析文章

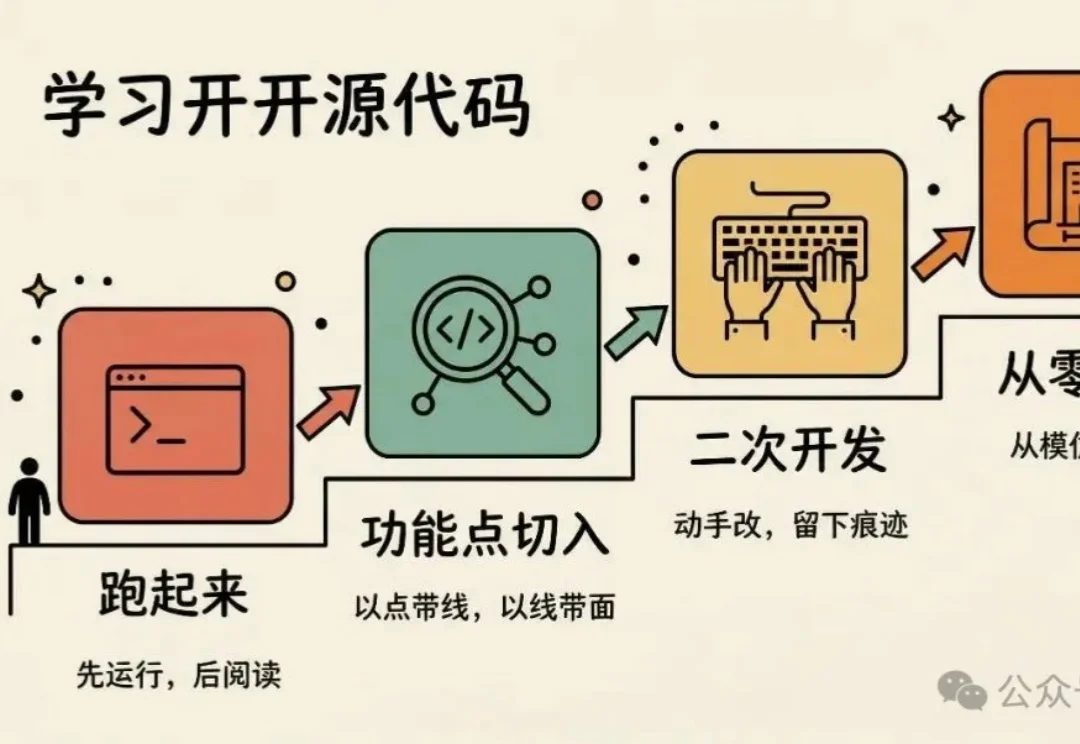

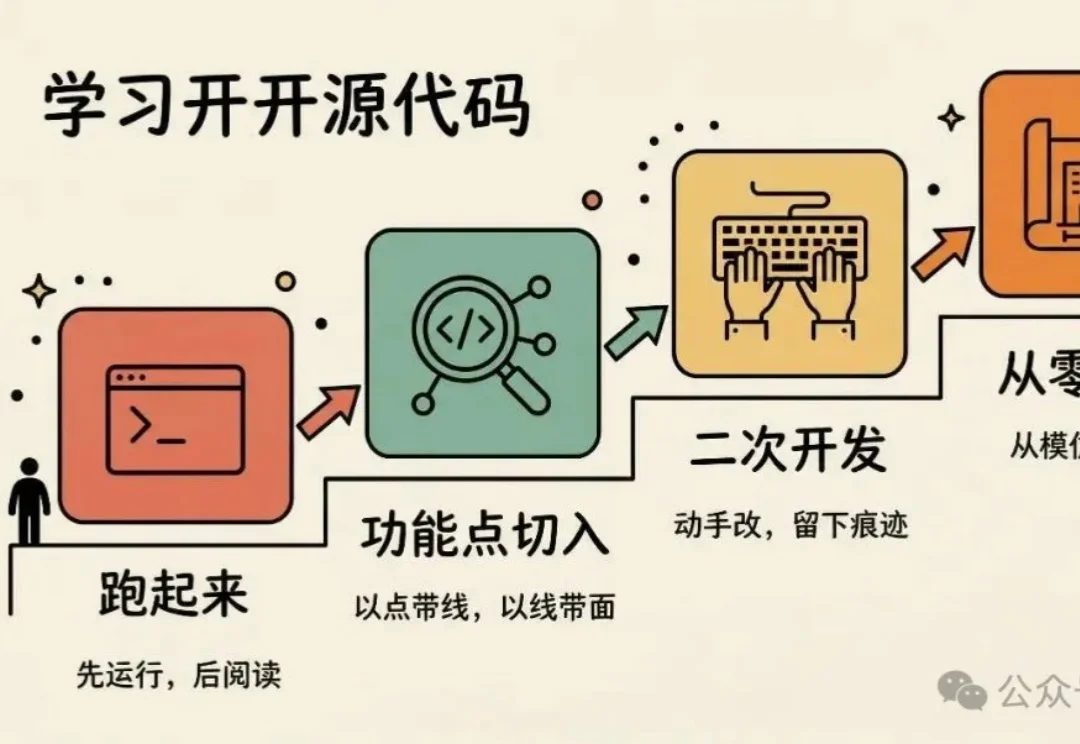

Claude Code 源码泄漏了,但我不打算写源码分析分析文章Claude Code 源码泄漏了,满屏都是“深度分析”文章。也有朋友让我写一篇分析文章,但代码才泄漏十几个小时,50 多万行代码,想深度分析清楚还是有难度的。不过授人以鱼不如授人以渔,我更想聊聊:拿到一份开源代码,怎么把它真正学到手。

Claude Code 源码泄漏了,满屏都是“深度分析”文章。也有朋友让我写一篇分析文章,但代码才泄漏十几个小时,50 多万行代码,想深度分析清楚还是有难度的。不过授人以鱼不如授人以渔,我更想聊聊:拿到一份开源代码,怎么把它真正学到手。

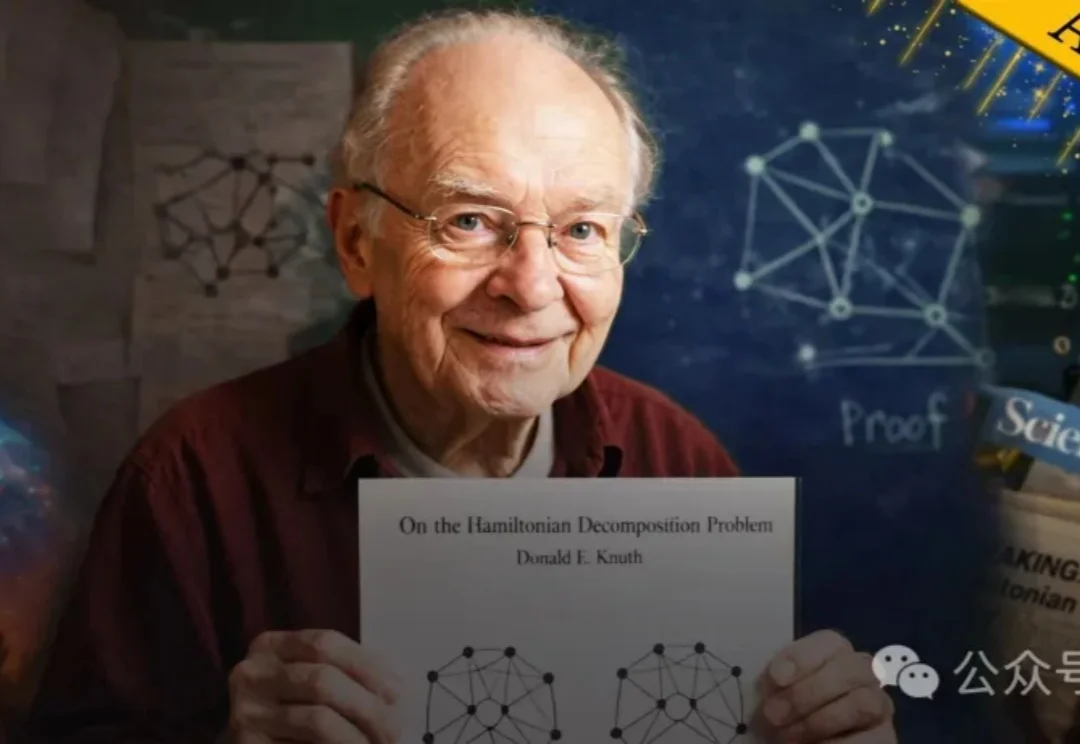

「哈密顿分解」难题,终于破解!88岁「算法祖师爷」高德纳再更论文,Claude 4.6+GPT-5.4联合破解了奇偶数情形。甚至,GPT-5.4直出一篇14页论文,引爆全网。

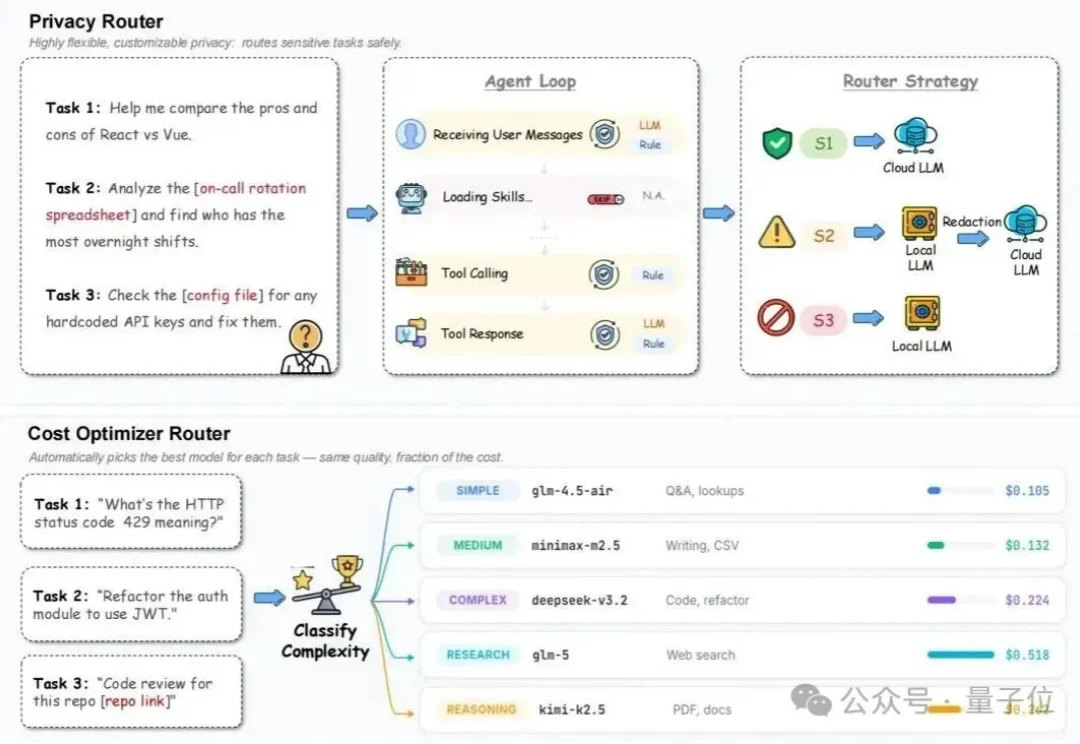

把Agent接入工作流,本该是件提效的乐事。

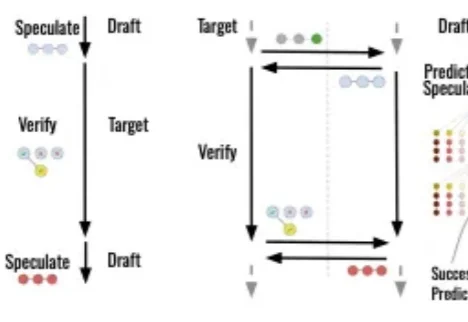

在大语言模型推理领域,虽然「推测解码」(Speculative Decoding,SD)已成为加速生成的标准配置,但它依然存在一个致命弱点: drafting(草拟)和 verification(验证)之间必须串行进行。

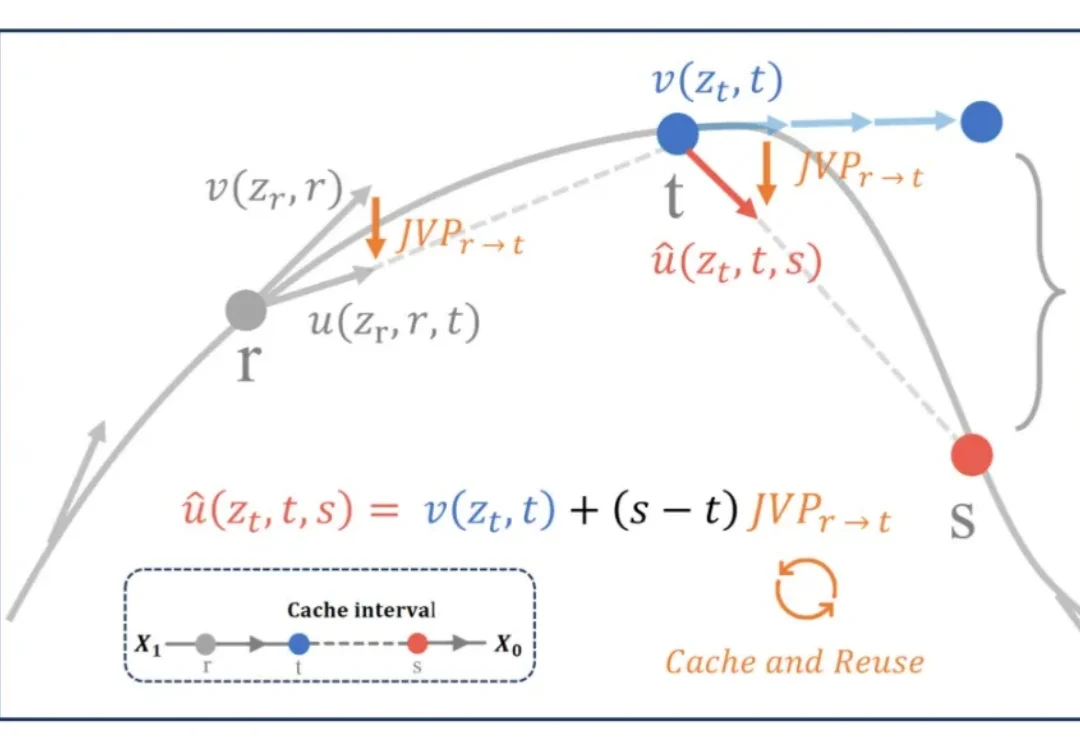

FLUX 、Qwen-Image 等多模态生成模型的推理速度一直是工业级多模态模型落地的痛点。传统的特征缓存(Feature Caching)方案在追求高倍率加速时,常因瞬时速度的剧烈波动导致轨迹漂移。

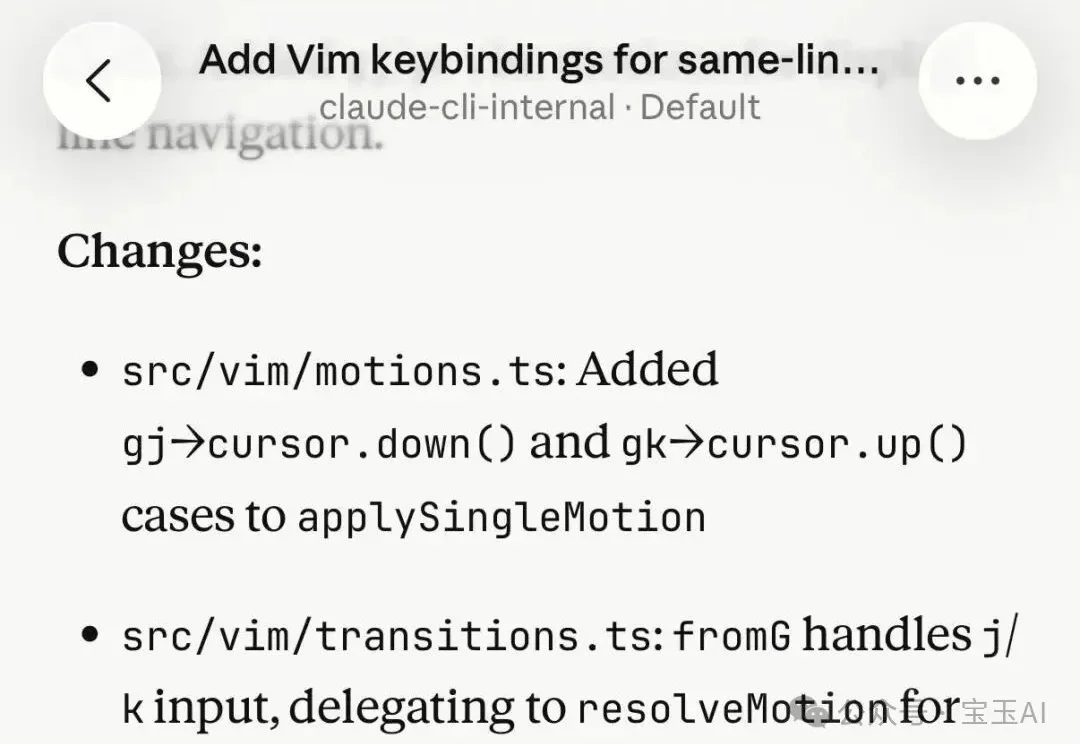

2026 年 3 月 31 日,安全研究员 Chaofan Shou 发现 Anthropic 的 Claude Code 全部源码通过 npm 包里的一个 source map 文件暴露在了公网上

Claude Code 源码泄露为业界一下子打开了 Agent 进化的大门。

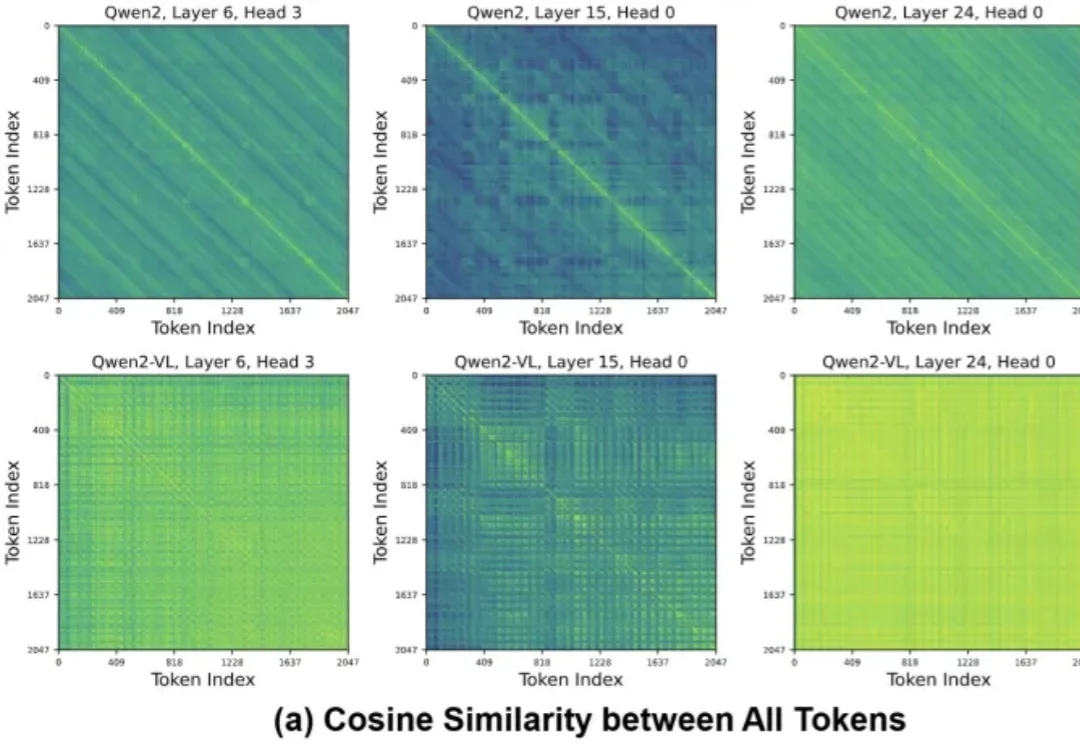

长上下文推理已经成了VLM/LLM的默认形态。

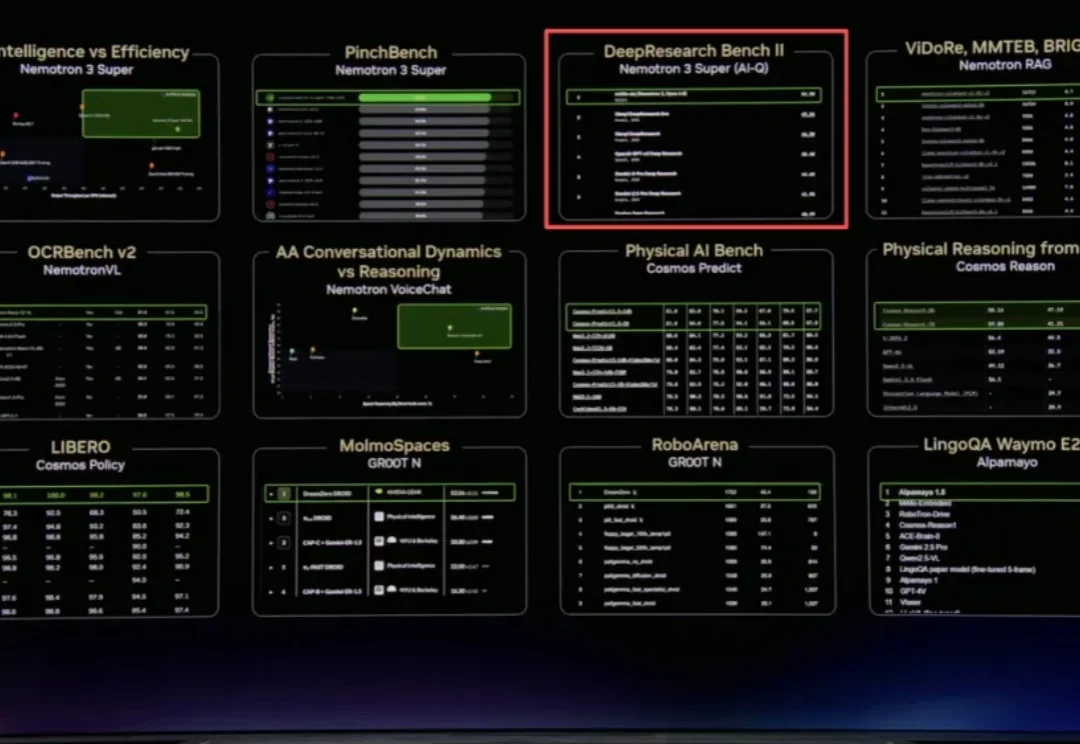

3 月 16 日,在刚刚结束的 NVIDIA GTC 2026 大会上,黄仁勋在长达三小时的 Keynote 演讲中发布了 NVIDIA Agent Toolkit 和 AI-Q 开放智能体蓝图,将 AI Agent 定位为下一个重大前沿。

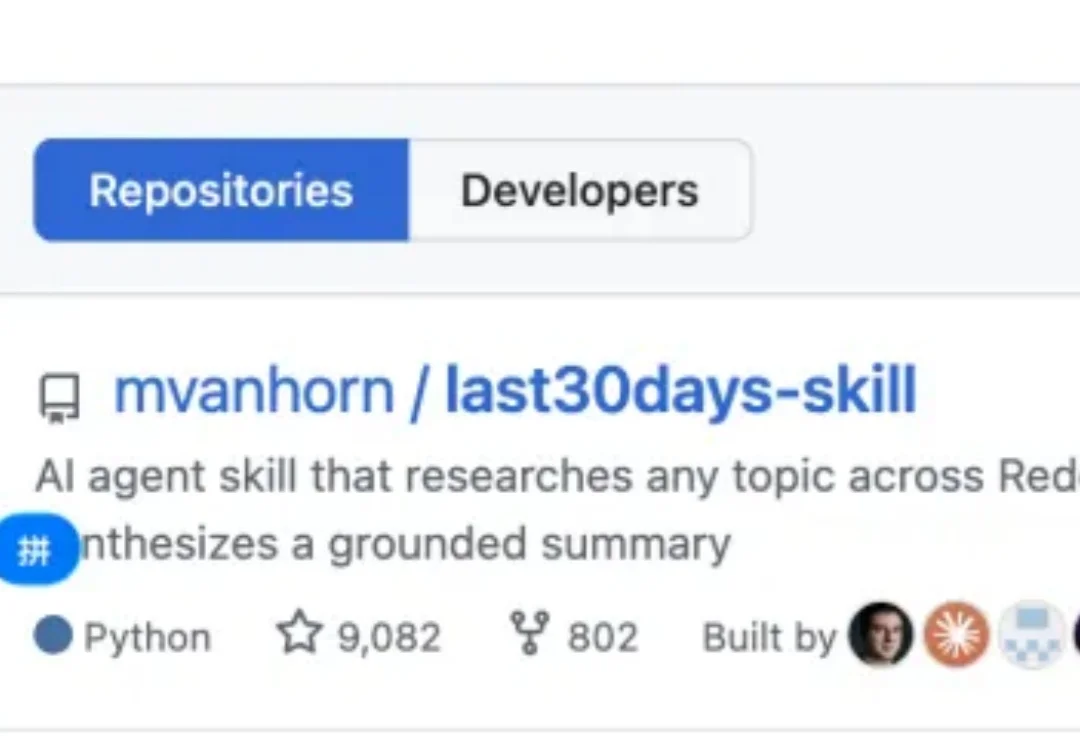

前天,我刷 GitHub Trending 的时候,看到第一名是个叫Last 30 Days的项目。

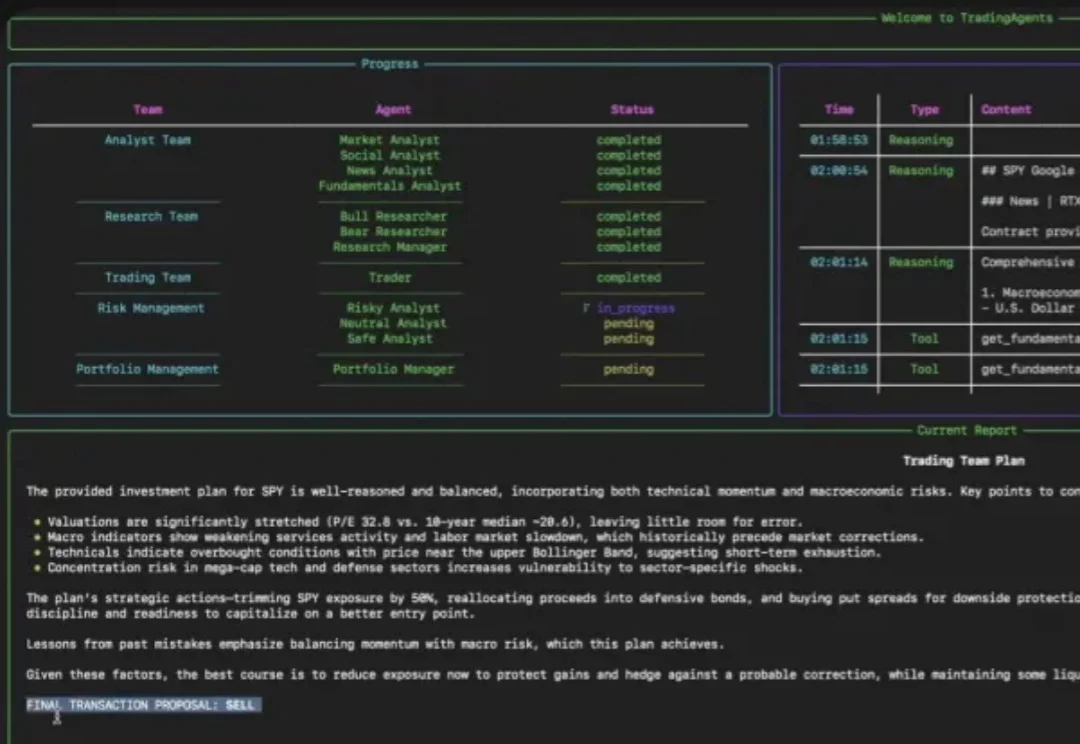

好家伙,投资版龙虾也来了。还是GitHub开源项目里最近高热高赞的那种。

过去数月,AI 领域很难绕开一个名字 ——OpenClaw。这个项目在极短时间内获得了爆发式关注:数十万星标、惊人的 Token 消耗,以及几乎所有大厂的快速跟进。从表面上看,它像是又一个现象级 AI 产品;但如果进一步审视,一个更值得思考的问题随之浮现 ——OpenClaw 的出现,究竟意味着什么?它真的是一次技术突破,还是某种更深层变化的信号?

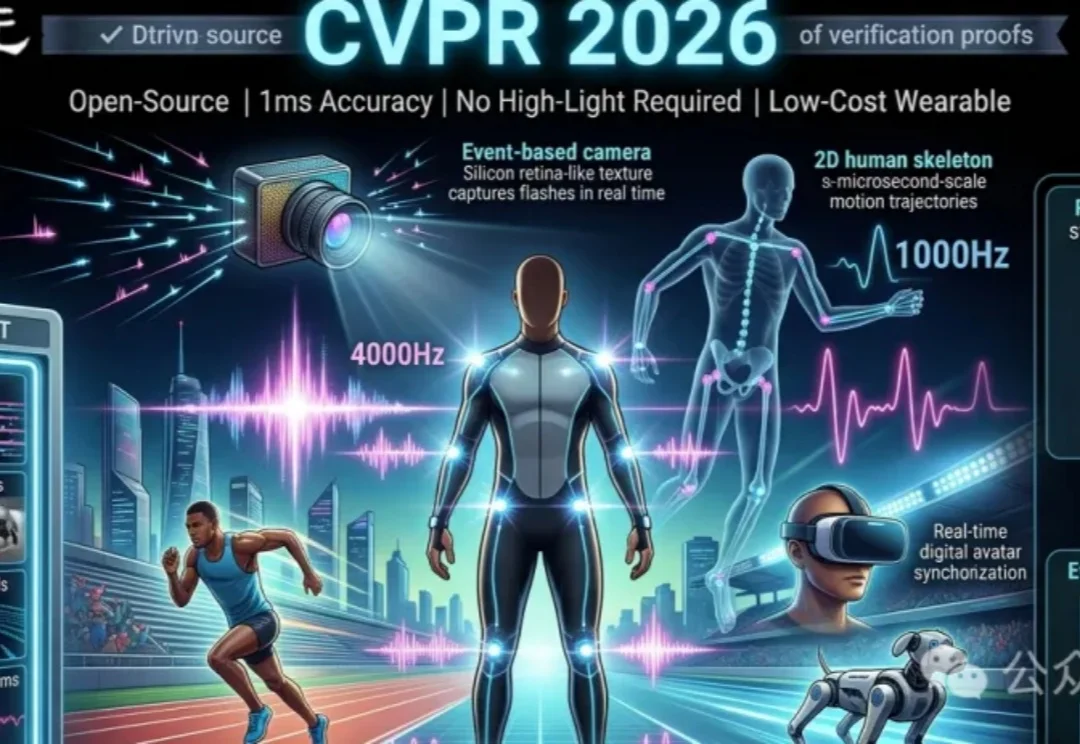

全球首个1毫秒级人体动作捕捉系统FlashCap,通过闪烁LED与事件相机结合,实现1000Hz超高帧率捕捉。无需昂贵设备或强光环境,低成本穿戴服即可精准捕捉极速动作。团队同步开源715万帧的FlashMotion数据集与多模态模型ResPose,显著提升运动分析精度,推动体育、VR与机器人领域迈向高动态智能新阶段。

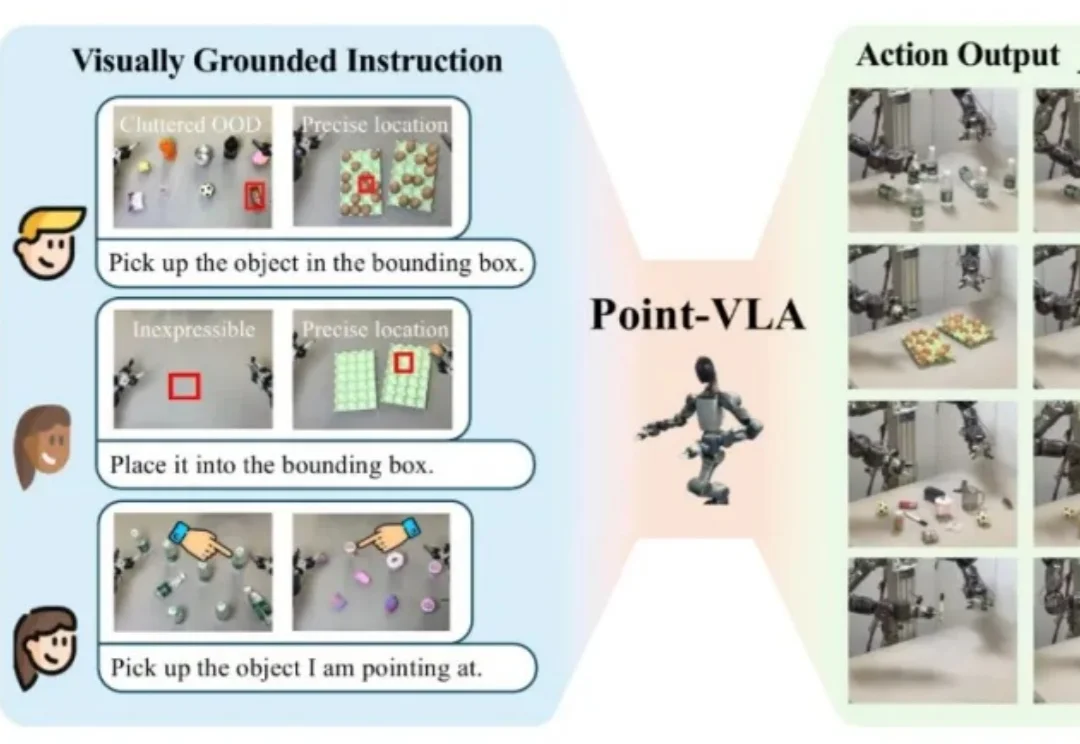

什么在限制空间智能落地?

设想这样一个场景:你打电话让同事去办公室某个地方拿东西,仅凭语言描述位置是多么困难。在办公室里,从一堆已经喝过的矿泉水瓶中,让对面同学递过来你之前喝过的那个,只用语言几乎无法准确描述——「左边第二个」?「有点旧的那个」?这时候,人们更倾向于用手指一下,或者拿出图片来指代。

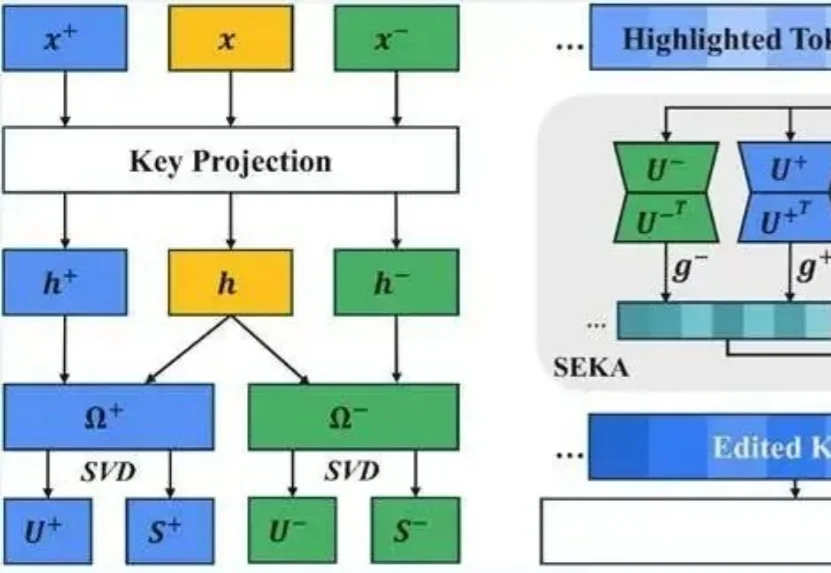

想让大模型重点关注提示词里的某句话可没那么容易。

Anthropic 研究科学家 Nicholas Carlini 在 [un]prompted 2026 安全会议上用不到 25 分钟演示了一件事:语言模型现在可以自主找到并利用零日漏洞,目标包括 Linux 内核这种被人类安全专家审计了几十年的软件。

做深度估计、深度补全的人,大概都有过这样一个瞬间。

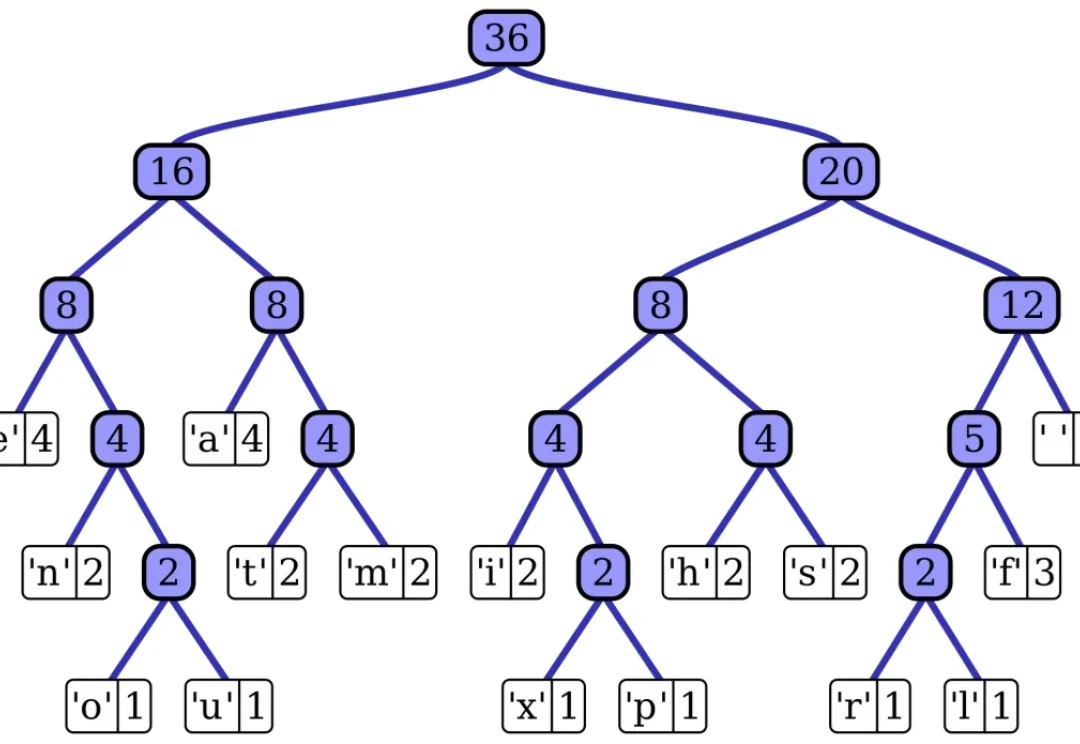

第一篇论文来自字节SEED团队, 打了一些基础; 《Over-Tokenized Transformer》。 论文标题看上去在讨论“过度分词”。 而重点必然是在第二篇上—— DeepSeek公司的学术成果Engram。 《Conditional Memory via Scalable Lookup》 也就是Engram模块所出处的论文。

GitHub OCR项目之王刚刚历史性易主。

Claude Code、Codex、QClaw、Work Buddy都能直接调用。

ICLR论文STEM架构率先提出「查表式记忆」架构,早于DeepSeek Engram三个月。它将Transformer的FFN从动态计算改为静态查表,用token索引的embedding表直接读取记忆,彻底解耦记忆容量与计算开销。

您在使用LLM时,如果遇到它胡说八道或者彻底偏题,第一反应是什么?大概率是直接关掉窗口,新开一个对话,懒得跟机器废话。但您可能不知道,这个看似再正常不过的习惯,正在给下一代大语言模型的训练库疯狂“投毒”。

在生成式 AI 领域,视觉分词器(Visual Tokenizer)通常采用固定压缩率 —— 无论是单调的监控画面,还是复杂的动作大片,都被切分为等量的 Token。这种 "一刀切" 的做法不仅会造成巨大的计算冗余,也产生了 “信息量” 不同的 Token,不利于下游理解生成任务处理。

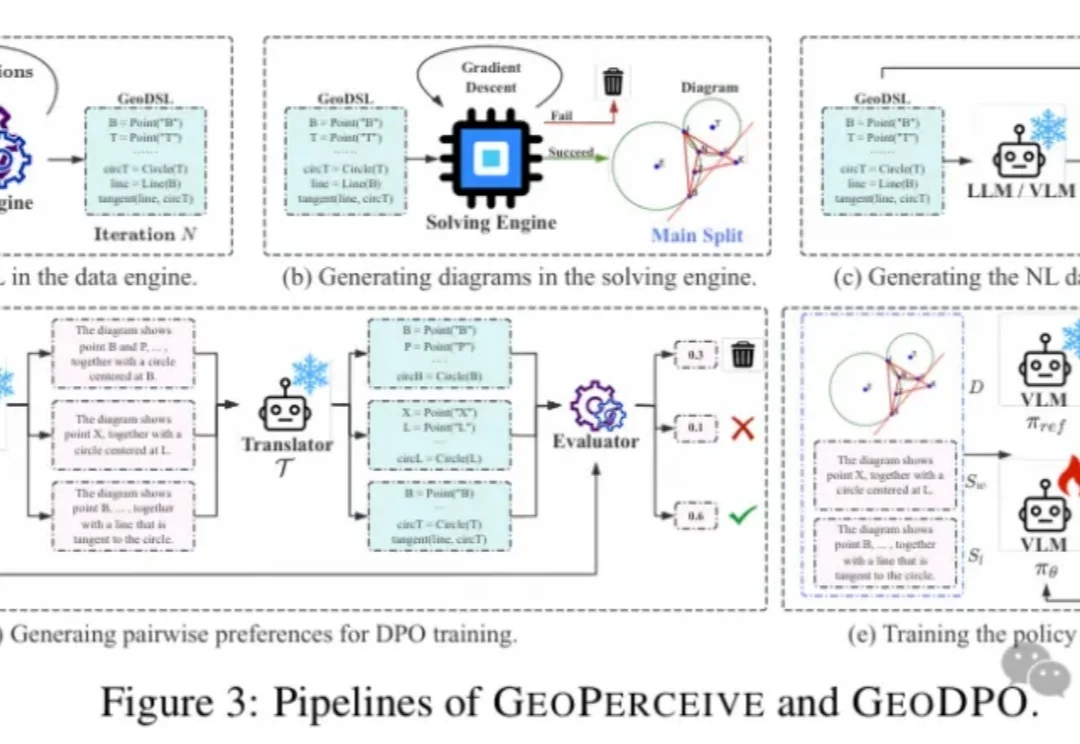

几何问题,真的只是“推理难”吗?

大模型的狂热已然退潮。当我们将目光从参数榜单转向真实的活跃数据,四家头部大厂的底层商业图谱已极度收敛。AI的竞争,早已变成一场基于算力成本与高频场景的残酷算账。

你日常用 Claude Code,用了多少功能?手机上写代码?语音编程?让 Claude 每 5 分钟自动帮你处理代码审查?

我们对 AI 的爱与怕,是同一个东西。

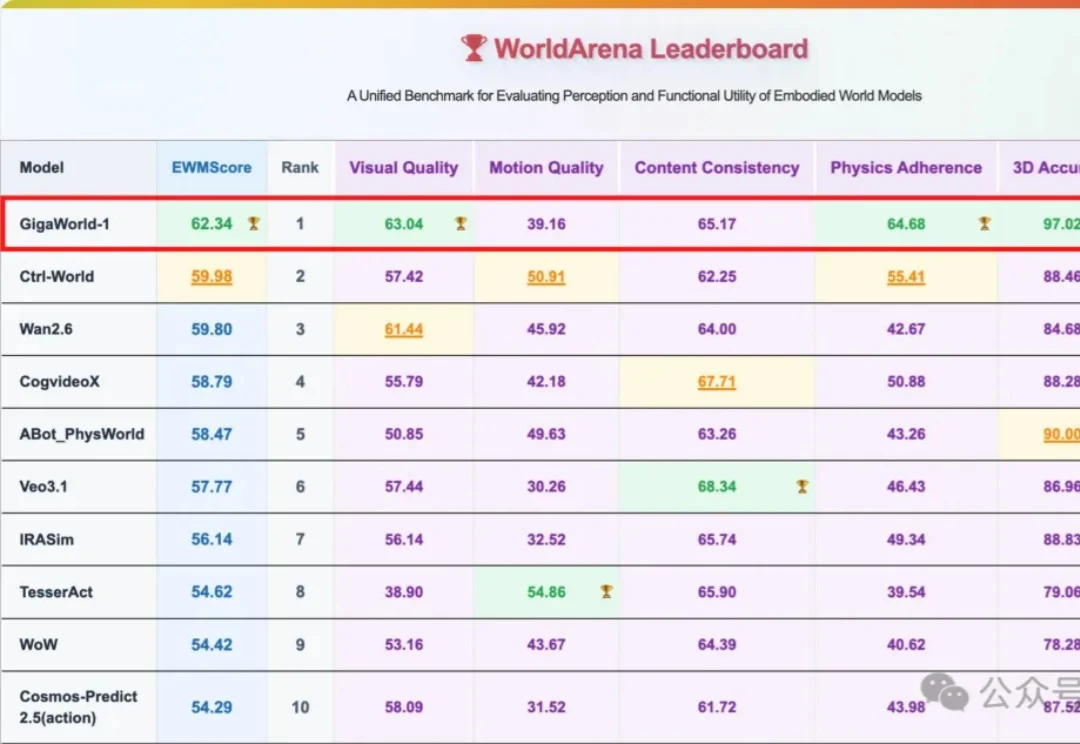

还得是咱国产世界模型牛!

自从大语言模型诞生起至今,AI 已经润物无声地融入了我们的工作生活,也成为了现代社会的重要组成部分。