开源两周4.7k标星,港大LightRAG大幅降低大模型问答成本,全面理解复杂实体依赖关系

开源两周4.7k标星,港大LightRAG大幅降低大模型问答成本,全面理解复杂实体依赖关系简单高效的大模型检索增强系统LightRAG,香港大学黄超团队最新研究成果。 开源两周时间在GitHub上获得将近5k标星,并登上趋势榜。

搜索

搜索

简单高效的大模型检索增强系统LightRAG,香港大学黄超团队最新研究成果。 开源两周时间在GitHub上获得将近5k标星,并登上趋势榜。

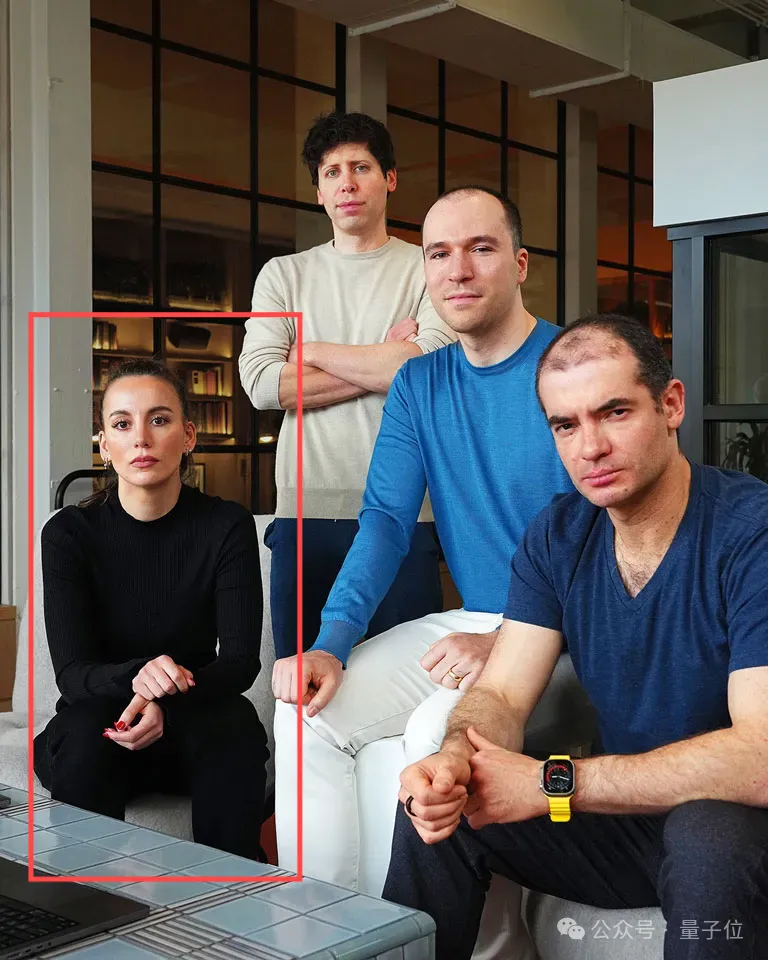

OpenAI前CTO Mira Murati出走后,动向进一步明确—— 被曝筹备新公司,吸金超1亿美元(约合7亿人民币),且和她同一天离开OpenAI的Barret Zoph(前研究副总裁)也可能入局。

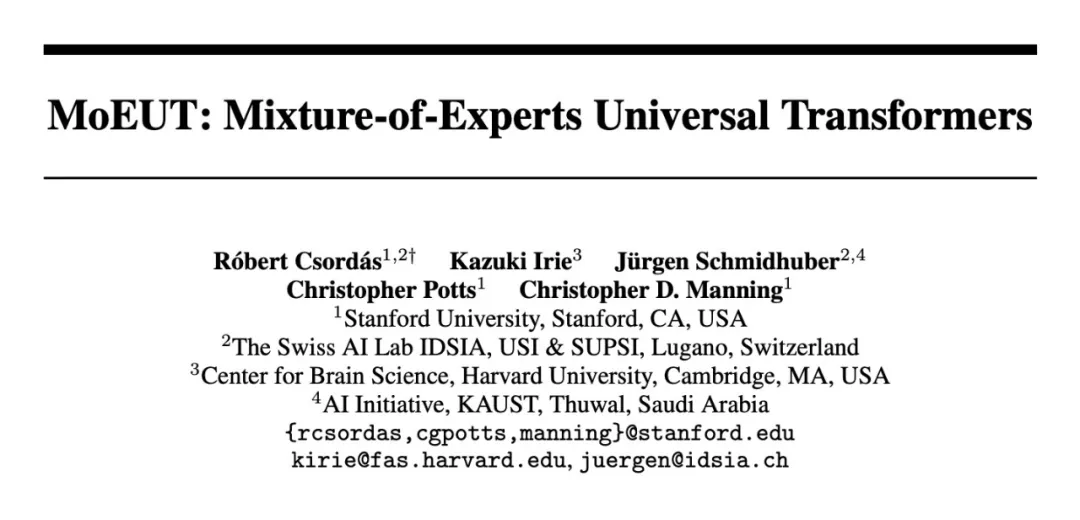

7 年前,谷歌在论文《Attention is All You Need》中提出了 Transformer。就在 Transformer 提出的第二年,谷歌又发布了 Universal Transformer(UT)。它的核心特征是通过跨层共享参数来实现深度循环,从而重新引入了 RNN 具有的循环表达能力。

Mistral AI盈利路径不明确,但其边缘AI模型性能超谷歌、Meta。

AI Agent爆火,机器人崛起 ChatGPT爆火了两年,掀起全球大模型开发热。近半年,具身智能集中融资30+笔,大模型混战继续,OpenAI以1570亿美元估值完成了66亿美元融资……

英伟达不仅要做显卡领域的领先者,还要在大模型领域逐渐建立起自己的优势。

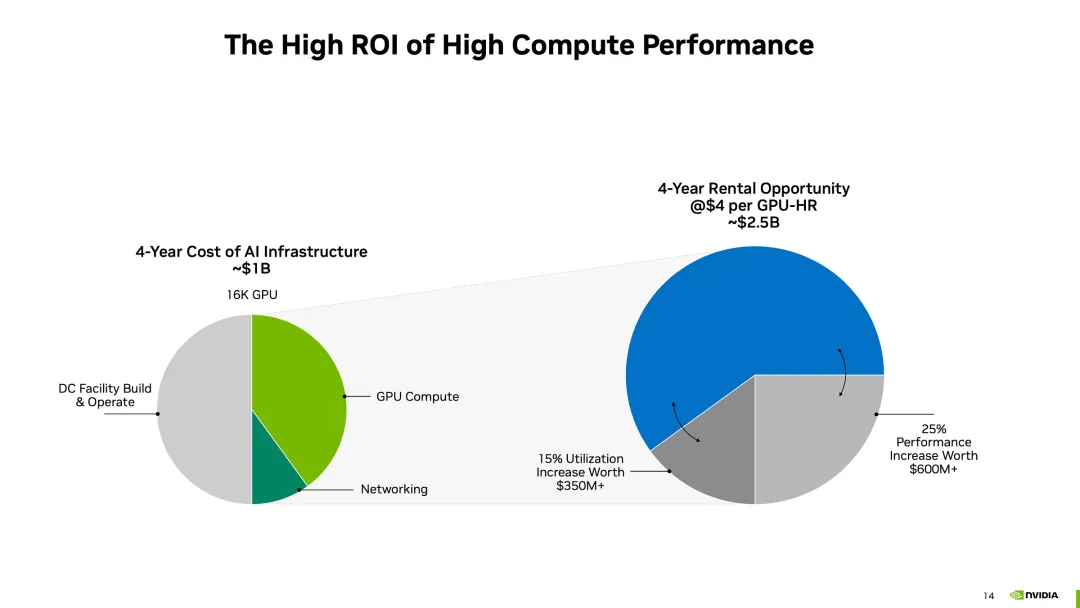

红杉资本的报告曾指出,AI产业的年产值超过6000亿美元,才够支付数据中心、加速GPU卡等AI基础设施费用。而现在一种普遍说法认为,基础模型训练的资本支出是“历史上贬值最快的资产”,但关于GPU基础设施支出的判定仍未出炉,GPU土豪战争仍在进行。

10月3日,OpenAI官方宣布成功获得66亿美元(约合人民币466.9亿元)融资。本轮融资结束后,OpenAI估值突破了1500亿美元。新一轮融资规模不小,然而却只够Open“烧”一年,其预计,今年营收可达37亿美元,亏损幅度为50亿美元。

一台4090笔记本,秒生1K质量高清图。英伟达联合MIT清华团队提出的Sana架构,得益于核心架构创新,具备了惊人的图像生成速度,而且最高能实现4k分辨率。

英伟达开源了超强模型Nemotron-70B,后者一经发布就超越了GPT-4o和Claude 3.5 Sonnet,仅次于OpenAI o1!AI社区惊呼:新的开源王者又来了?业内直呼:用Llama 3.1训出小模型吊打GPT-4o,简直是神来之笔!