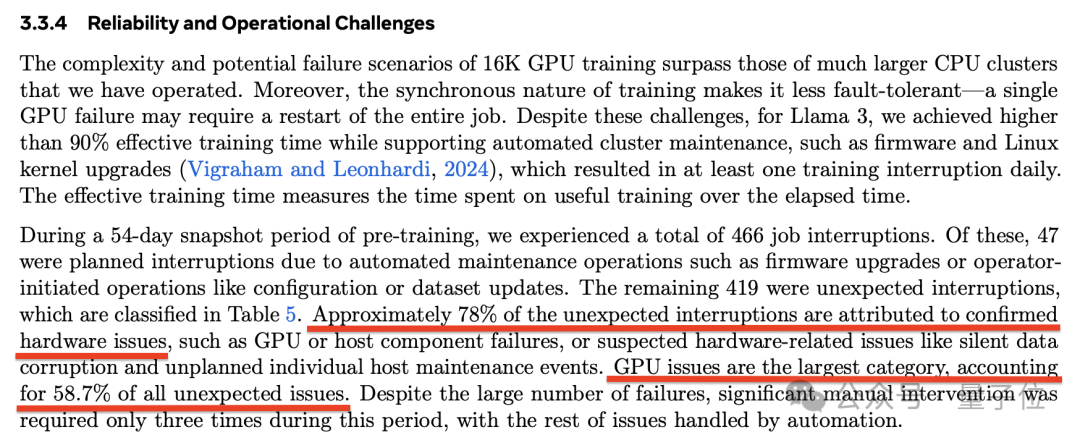

Llama3.1训练平均3小时故障一次,H100万卡集群好脆弱,气温波动都会影响吞吐量

Llama3.1训练平均3小时故障一次,H100万卡集群好脆弱,气温波动都会影响吞吐量每3个小时1次、平均1天8次,Llama 3.1 405B预训练老出故障,H100是罪魁祸首?

来自主题: AI资讯

11529 点击 2024-07-29 19:52

每3个小时1次、平均1天8次,Llama 3.1 405B预训练老出故障,H100是罪魁祸首?

榨干16000块H100、基于15亿个Tokens训练。

世界最强AI集群,马斯克建成了! 这一爆炸消息,由老马在推特上亲自官宣。

10万块液冷H100正式开工,马斯克19天建成世界最强AI训练集群。

不用H100,三台苹果电脑就能带动400B大模型。 背后的功臣,是GitHub上的一个开源分布式AI推理框架,已经斩获了2.5k星标。

整个市场不再追求大而全,都在走小而精的路线了。

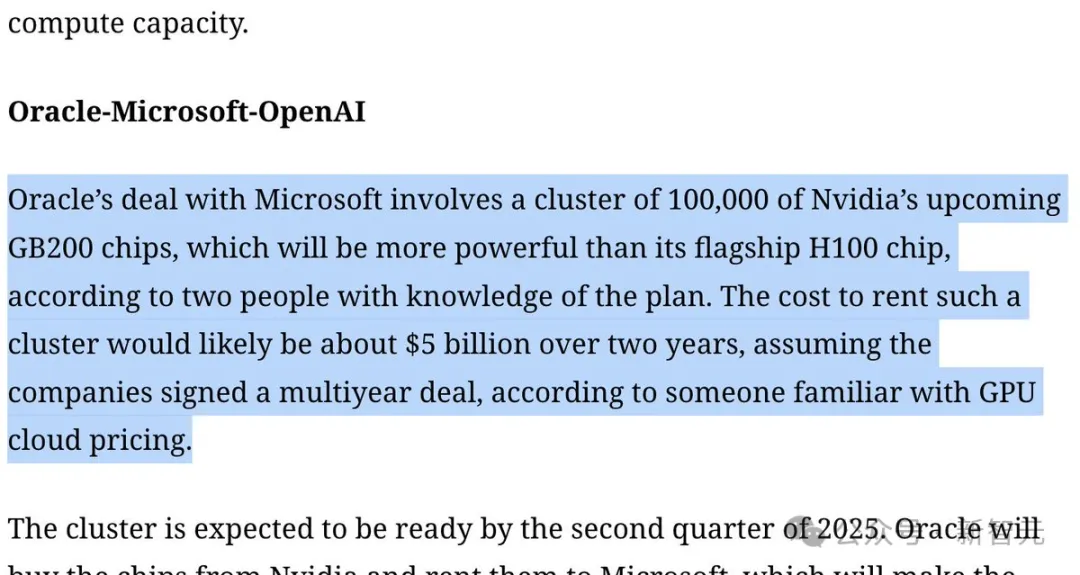

马斯克官宣xAI建造的世界最大超算集群,由10万块H100搭建,预计本月末开始投入训练。另一边,OpenAI再次加码,将打造由10万块GB200组成的超算,完全碾压xAI。

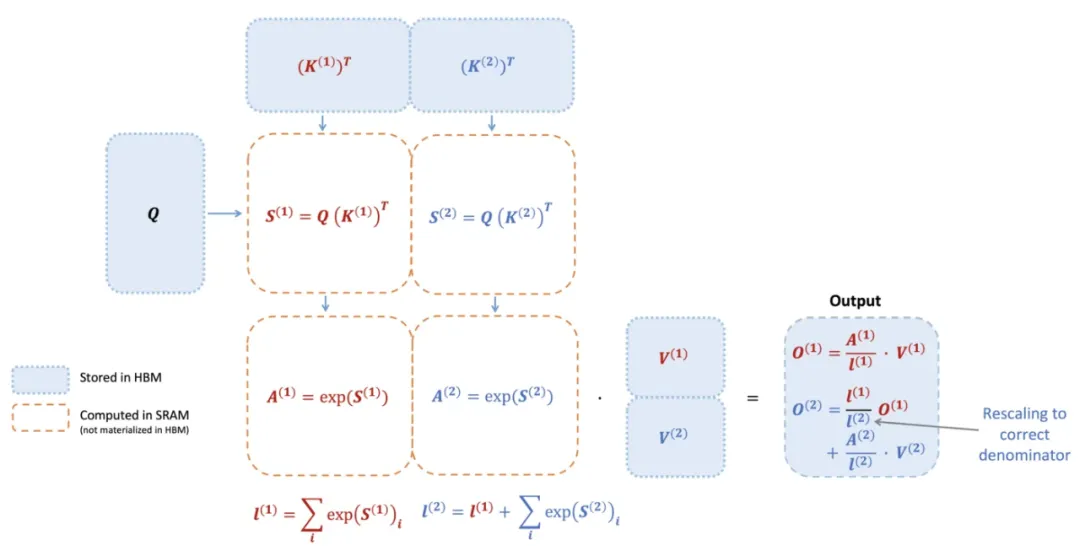

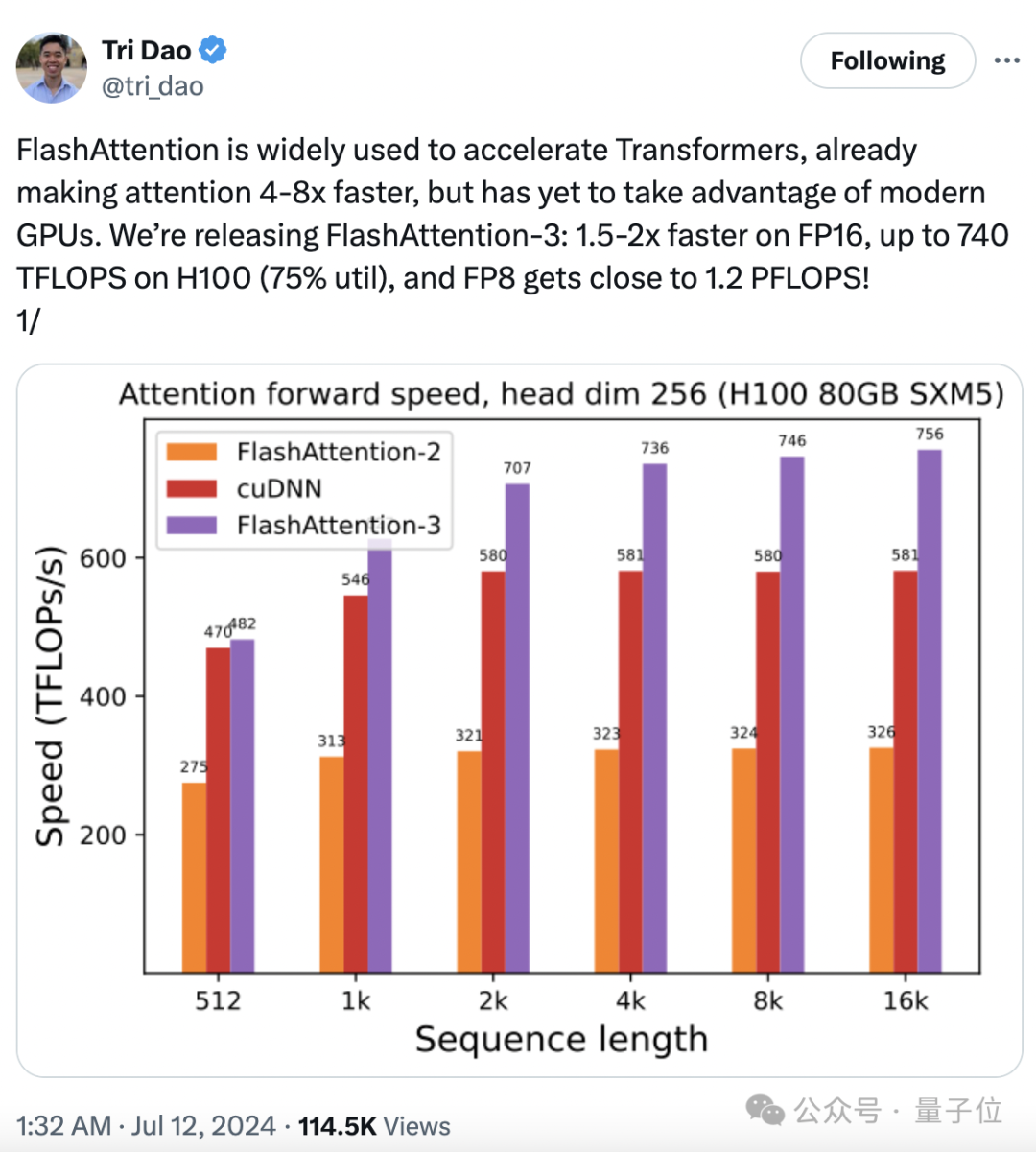

740 TFLOPS!迄今最强 FlashAttention 来了。

时隔一年,FlashAttention又推出了第三代更新,专门针对H100 GPU的新特性进行优化,在之前的基础上又实现了1.5~2倍的速度提升。

大模型训练推理神作,又更新了!