DeepSeek R1 Zero中文复现教程来了!

DeepSeek R1 Zero中文复现教程来了!各位同学好,我是来自 Unlock-DeepSeek 开源项目团队的骆师傅。先说结论,我们(Datawhale X 似然实验室)使用 3 张 A800(80G) 计算卡,花了 20 小时训练时间,做出了可能是国内首批 DeepSeek R1 Zero 的中文复现版本,我们把它叫做 Datawhale-R1,用于 R1 Zero 复现教学。

各位同学好,我是来自 Unlock-DeepSeek 开源项目团队的骆师傅。先说结论,我们(Datawhale X 似然实验室)使用 3 张 A800(80G) 计算卡,花了 20 小时训练时间,做出了可能是国内首批 DeepSeek R1 Zero 的中文复现版本,我们把它叫做 Datawhale-R1,用于 R1 Zero 复现教学。

阿里系第一个吃上DeepSeek“螃蟹”的出现了——钉钉:已经全面接入DeepSeek系列模型。现在,用户在钉钉上创建AI助理的时候,可以直接选择DeepSeek系列的R1、V3等三种模型!

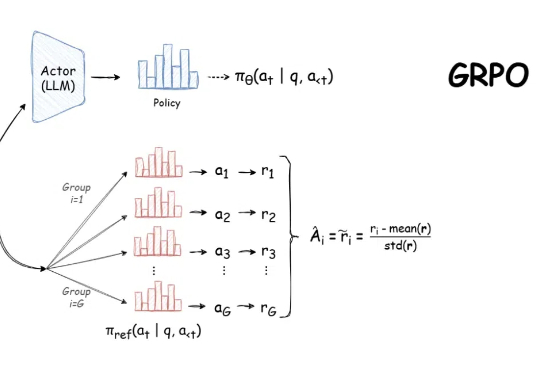

自 DeepSeek-R1 发布以来,群组相对策略优化(GRPO)因其有效性和易于训练而成为大型语言模型强化学习的热门话题。R1 论文展示了如何使用 GRPO 从遵循 LLM(DeepSeek-v3)的基本指令转变为推理模型(DeepSeek-R1)。

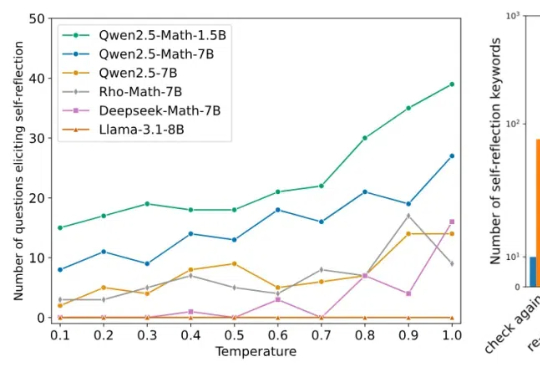

一项非常鼓舞人心的发现是:DeepSeek-R1-Zero 通过纯强化学习(RL)实现了「顿悟」。在那个瞬间,模型学会了自我反思等涌现技能,帮助它进行上下文搜索,从而解决复杂的推理问题。

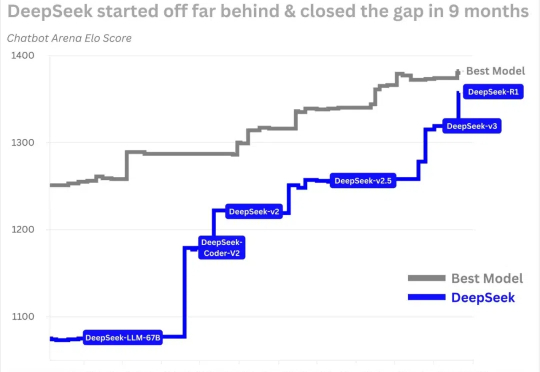

有时,当某项技术变得更便宜时,反而会促使整体投入增加。我认为,从长期来看,人类对智能和算力的需求几乎没有上限,因此我仍然看好AI计算需求的持续增长。我认为DeepSeek-R1在地缘政治上的影响尚有待厘清,同时它也为AI应用开发者带来了巨大机遇。

春节期间,互联网上最火的不是春晚小品,也不是春节档电影,而是 DeepSeek。

成本不到150元,训练出一个媲美DeepSeek-R1和OpenAI o1的推理模型?!这不是洋葱新闻,而是AI教母李飞飞、斯坦福大学、华盛顿大学、艾伦人工智能实验室等携手推出的最新杰作:s1。

本周三,该公司全面发布 Gemini 2.0 Flash、 Gemini 2.0 Flash-Lite 以及新一代旗舰大模型 Gemini 2.0 Pro 实验版本,并且还在 Gemini App 中推出了其推理模型 Gemini 2.0 Flash Thinking。

国内首个自研万卡集群,刚刚成功点亮!国产AI的高价门槛直接被打下来了。在百度智能云平台上,DeepSeek R1和V3的官方价格直接低至五折和三折,基本实现全网最低。

围绕 DeepSeek 的谣言实在太多了。 面对 DeepSeek R1 这个似乎「一夜之间」出现的先进大模型,全世界已经陷入了没日没夜的大讨论。从它的模型能力是否真的先进,到是不是真的只用了 550W 进行训练,再到神秘的研究团队,每个角度都是话题。