刚刚,奥特曼亲赴,韩国「举国」投靠!

刚刚,奥特曼亲赴,韩国「举国」投靠!奥特曼亲自飞赴首尔,与韩国总统、两大财阀巨头会晤并达成合作。三星电子与SK海力士将加速生产先进存储芯片,目标月产能达90万片DRAM晶圆,以满足OpenAI模型的需求。随着奥特曼逐渐握紧硬件的咽喉,留给竞争对手的时间,不多了。

搜索

搜索

奥特曼亲自飞赴首尔,与韩国总统、两大财阀巨头会晤并达成合作。三星电子与SK海力士将加速生产先进存储芯片,目标月产能达90万片DRAM晶圆,以满足OpenAI模型的需求。随着奥特曼逐渐握紧硬件的咽喉,留给竞争对手的时间,不多了。

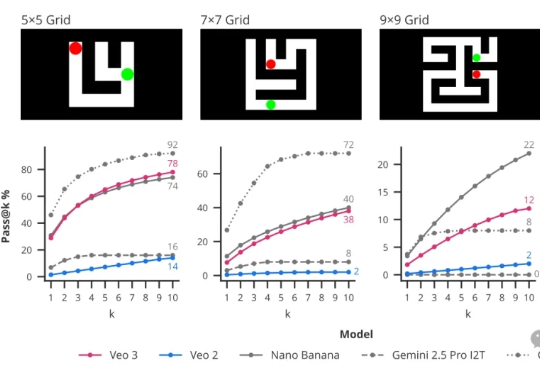

DeepMind公开了有关Veo 3视频模型最新论文!论文提出了「帧链」(Chain-of-Frames,CoF),认为视频模型也可能像通用大模型一样具备推理能力。零样本能力的涌现,表明视频模型的「GPT-3时刻」来了。

CoT思维链的下一步是什么? DeepMind提出帧链CoF(chain-of-frames)。

就在上周的 Meta Connect 开发者大会上,Meta 发布了三款全新智能眼镜,但本该展示“未来体验”的现场演示却屡屡翻车。Bosworth 随后在 Instagram 上火速澄清,否认了小扎的说法。他坦言,这不是 Wi-Fi 的问题,也不是场地的原因,而是 Meta 自己的设置和失误。

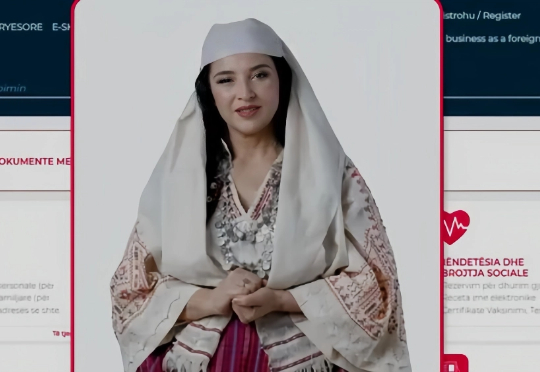

起猛了,AI当上政府官员了。 智东西9月12日消息,据多家外媒报道,阿尔巴尼亚总理埃迪·拉马(Edi Rama)宣布新内阁成员名单,任命AI虚拟机器人Diella为阿尔巴尼亚新一任公共采购部长。

Framer 是一家荷兰公司,专门开发网页设计自动化工具,目前已完成一轮估值达 20 亿美元的融资。

如今,Facebook与Instagram已正式上线Reels短视频的音频翻译功能。该功能依托AI技术,可直接将视频中的人物音频翻译成不同语种,不仅支持双人对话翻译,还能实现嘴型对齐,并根据对话双方的原始音色,合成声线高度相似的翻译音轨。

本文介绍使用四块Framework主板构建AI推理集群的完整过程,并对其在大语言模型推理任务中的性能表现进行了系统性评估。该集群基于AMD Ryzen AI Max+ 395处理器,采用mini ITX规格设计,可部署在10英寸标准机架中。

上周,一款由AI驱动的CRPG游戏《印格》(Engram)在ChinaJoy上亮相。

穿着运动鞋的鲨鱼踩着滑板冲浪,头顶卡布奇诺泡沫的芭蕾舞者在水晶球里旋转——这些被称为“脑残视频”(Brainrot Videos)的荒诞内容正在TikTok和Instagram上病毒式传播,年轻用户群体疯狂追捧这些脱离现实逻辑的视觉梗图,单条播放量动辄突破千万。