怀疑有人AI作弊,全班115人遭“连坐重考”!现场写代码+答辩+全程录像,学生怒怼:答错一句就完了?

怀疑有人AI作弊,全班115人遭“连坐重考”!现场写代码+答辩+全程录像,学生怒怼:答错一句就完了?近日,新西兰林肯大学(Lincoln University)的一门课程引发争议:因怀疑部分学生在作业中使用了生成式 AI 工具,任课教师决定让全班 100 多名学生重新接受线下考核。

搜索

搜索

近日,新西兰林肯大学(Lincoln University)的一门课程引发争议:因怀疑部分学生在作业中使用了生成式 AI 工具,任课教师决定让全班 100 多名学生重新接受线下考核。

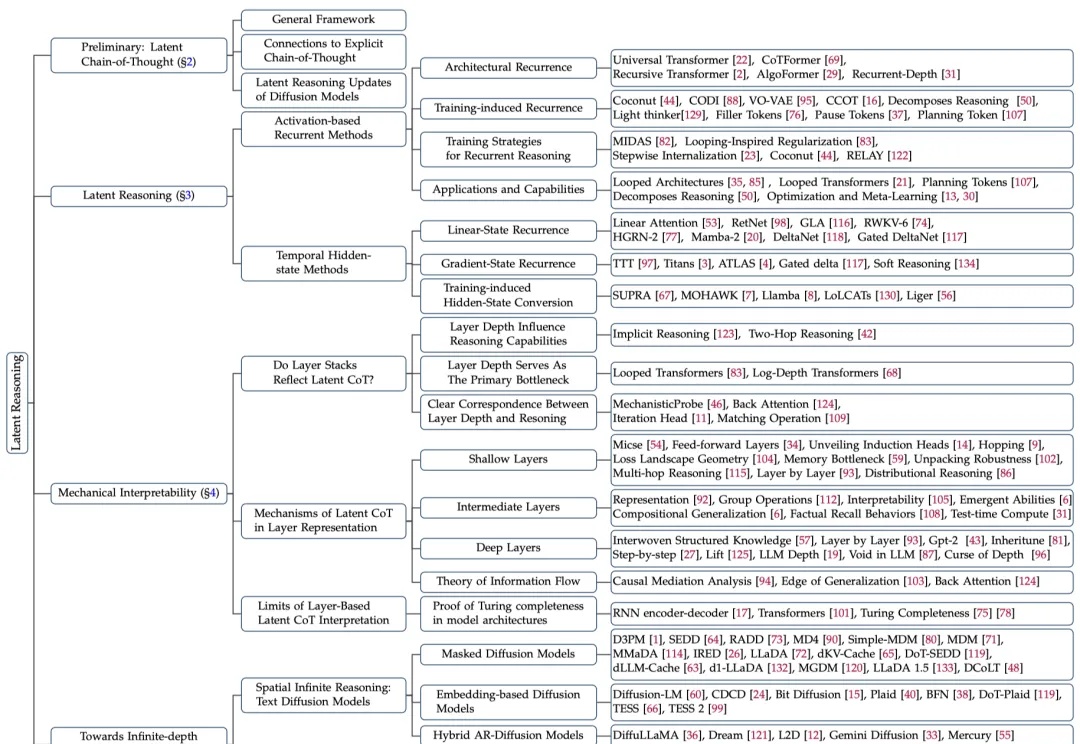

大模型在潜空间中推理,带宽能达到普通(显式)思维链(CoT)的2700多倍?

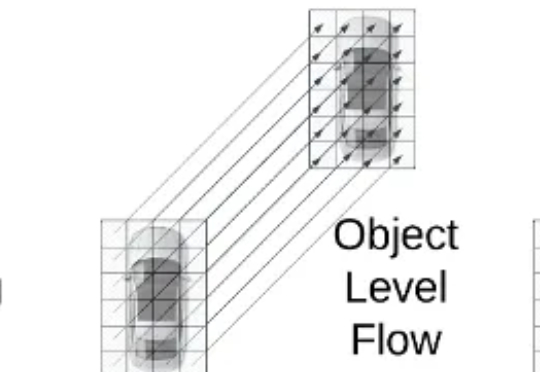

来自加州大学河滨分校(UC Riverside)、密歇根大学(University of Michigan)、威斯康星大学麦迪逊分校(University of Wisconsin–Madison)、德州农工大学(Texas A&M University)的团队在 ICCV 2025 发表首个面向自动驾驶语义占用栅格构造或预测任务的统一基准框架 UniOcc。

6 月 17 日,一款 AI 占星产品 Starla-Call the Universe 进入了 iOS 美国下载总榜前 10,当笔者以为这又是一个昙花一现的产品时,它不仅能够持续坚守榜单 Top 10 长达半个月,而且到了 6 月 24 日,另一款产品 Astra-Life Advice 也进入了美榜前 10,两款同类产品相继进入 Top 10,并双双持续在榜超 1 周的时间。

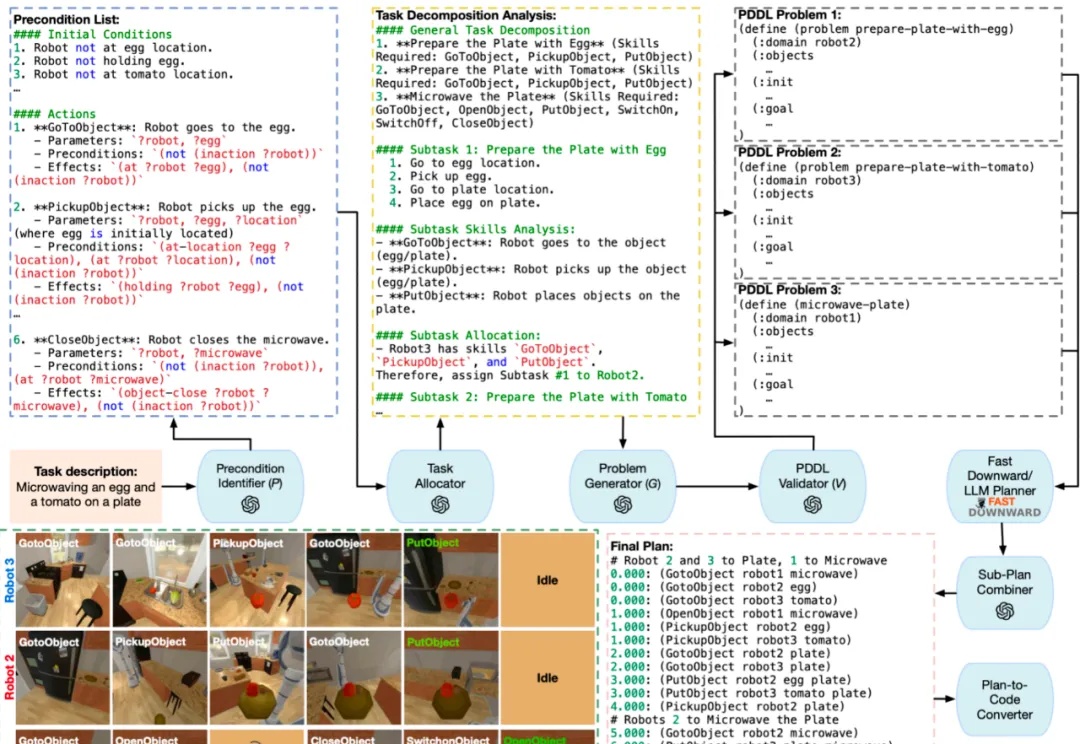

2025 年 5 月,美国加州大学河滨分校 (UC Riverside) 与宾夕法尼亚州立大学 (Penn State University) 联合团队在机器人领域顶级会议 ICRA 2025 上发布最新研究成果 LaMMA-P。

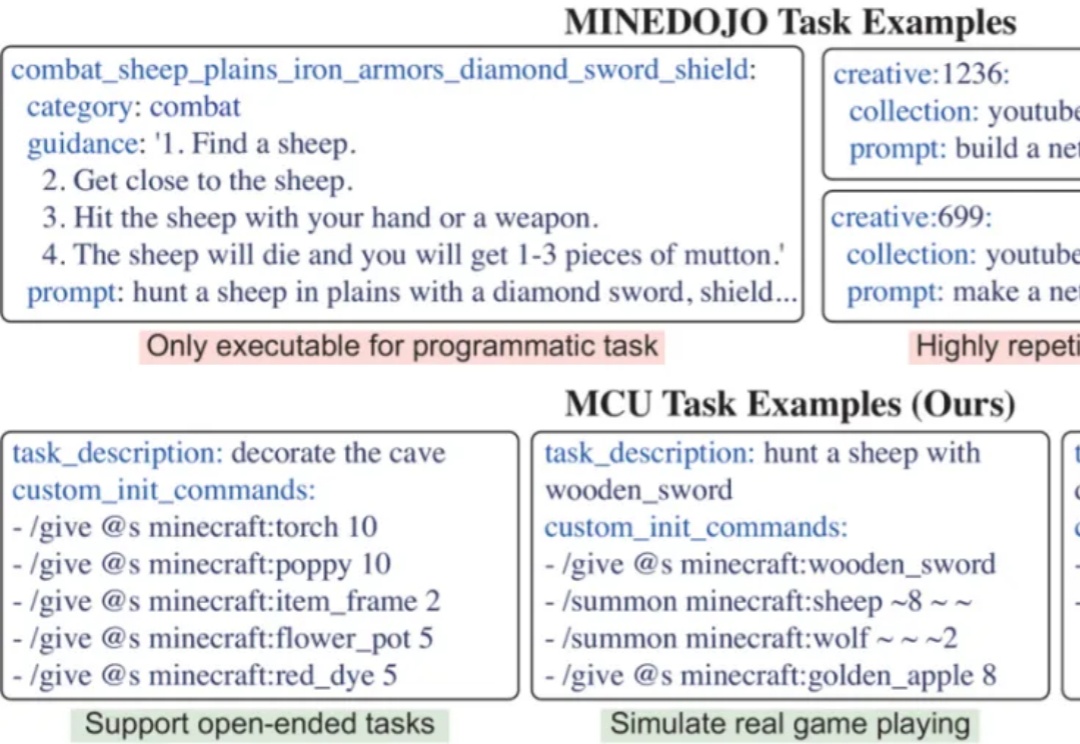

开发能在开放世界中完成多样任务的通用智能体,是AI领域的核心挑战。开放世界强调环境的动态性及任务的非预设性,智能体必须具备真正的泛化能力才能稳健应对。然而,现有评测体系多受限于任务多样化不足、任务数量有限以及环境单一等因素,难以准确衡量智能体是否真正「理解」任务,或仅是「记住」了特定解法。

北京时间 10 月 30 日,GitHub Universe 2024 如约而至,而今年正值大会十周年纪念日。本文将从 GitHub 发布的 AI 新进展入手,围绕开源模型、用户数量、盈利模式、发展历程等几个方面,全面梳理 GitHub 与 Hugging Face 两大开源平台的异同。

时隔近70年,那个用来解决最短路径问题的经典算法——Dijkstra,现在有了新突破:被证明具有普遍最优性(Universal Optimality)。

Maitrix.org 是由 UC San Diego, John Hopkins University, CMU, MBZUAI 等学术机构学者组成的开源组织,致力于发展大语言模型 (LLM)、世界模型 (World Model)、智能体模型 (Agent Model) 的技术以构建 AI 驱动的现实。

7 年前,谷歌在论文《Attention is All You Need》中提出了 Transformer。就在 Transformer 提出的第二年,谷歌又发布了 Universal Transformer(UT)。它的核心特征是通过跨层共享参数来实现深度循环,从而重新引入了 RNN 具有的循环表达能力。