谷歌放大招!Gemini「吞下」2.5亿地图数据,路痴AI一夜成精

谷歌放大招!Gemini「吞下」2.5亿地图数据,路痴AI一夜成精世界在AI眼中活了过来!谷歌Grounding with Google Maps功能上线,Gemini可调用2.5亿地点信息,结合搜索工具,提供更准确、更及时的答案,完美适用于旅行规划和本地服务。

搜索

搜索

世界在AI眼中活了过来!谷歌Grounding with Google Maps功能上线,Gemini可调用2.5亿地点信息,结合搜索工具,提供更准确、更及时的答案,完美适用于旅行规划和本地服务。

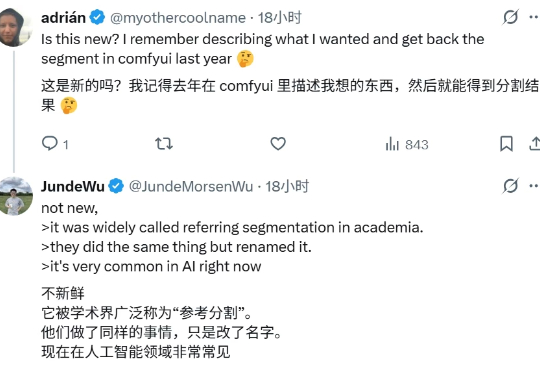

2023年Meta推出SAM,随后SAM 2扩展到视频分割,性能再度突破。近日,SAM 3悄悄现身ICLR 2026盲审论文,带来全新范式——「基于概念的分割」(Segment Anything with Concepts),这预示着视觉AI正从「看见」迈向真正的「理解」。

说出概念,SAM 3 就明白你在说什么,并在所有出现的位置精确描绘出边界。 Meta 的「分割一切」再上新? 9 月 12 日,一篇匿名论文「SAM 3: SEGMENT ANYTHING WITH CONCEPTS」登陆 ICLR 2026,引发网友广泛关注。

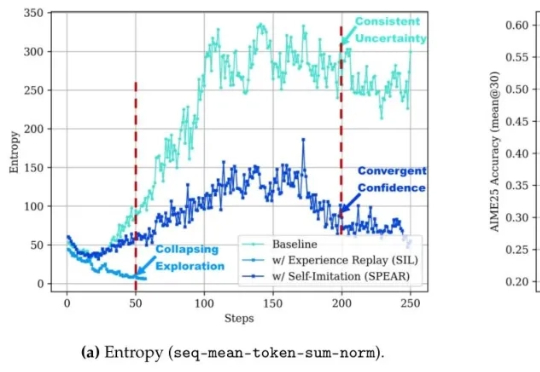

让智能体自己摸索新方法,还模仿自己的成功经验。腾讯优图实验室开源强化学习算法——SPEAR(Self-imitation with Progressive Exploration for Agentic Reinforcement Learning)。

Sora 2,用OpenAI的原话描述就是:“With Sora 2, we are jumping straight to what we think may be the GPT‑3.5 moment for video。”AI视频的ChatGPT时刻,正式来了。

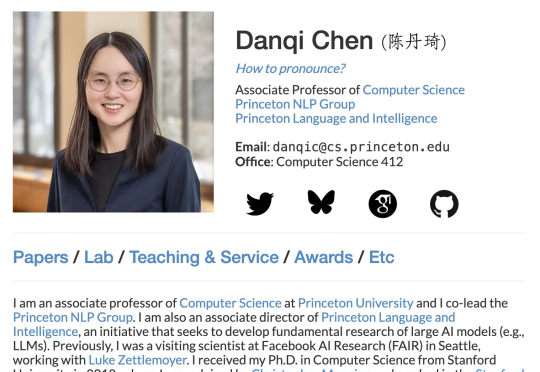

结合RLHF+RLVR,8B小模型就能超越GPT-4o、媲美Claude-3.7-Sonnet。陈丹琦新作来了。他们提出了一个结合RLHF和RLVR优点的方法,RLMT(Reinforcement Learning with Model-rewarded Thinking,基于模型奖励思维的强化学习)。

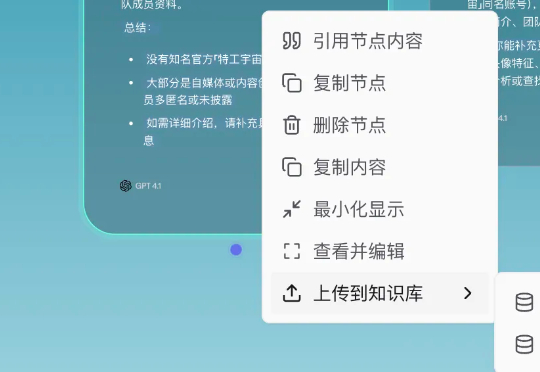

9 月 26 日,Flowith 再次迎来了大更新,这一次,它的核心所指,正是「上下文腐烂」以及更加「自由的创作」。接下来,我们分享全面实测体验。从我的实际体验来看,这次的 Flowith 更新,终于让上下文「活」起来了。

最近 flowith 推出了全新画布,交互形态全新升级,现在 AI 生成的任意内容,都可以被很方便的右键点击节点,存入任意知识库,后续工作都可以调用。说实话,flowith 是一款上手门槛比较高的产品,它不像一般对话式的 ChatBot 那样简单,

WithFeeling.ai 创始人肖敏此前是微信 AI 的产品负责人。2022 年中,她选择创业,在 2023 年初推出主打「真诚、真实」的 AI 陪伴产品 Paradot,上线至今已经积累了 1000 多万用户,且实现了盈利,成为品类的佼佼者。

就在刚刚,也许是目前最强的开源蛋白质结合剂AI设计工具,登上Nature。瑞士洛桑联邦理工学院、美国麻省理工学院等研究人员在Nature上发表了题为One-shot design of functional protein binders with BindCraft的论文。