通专融合,思维链还透明,上海AI Lab为新一代大模型打了个样

通专融合,思维链还透明,上海AI Lab为新一代大模型打了个样OpenAI 研究员姚顺雨近期发布文章,指出:AI 下半场将聚焦问题定义与评估体系重构。在 AI 发展新阶段,行业需要通过设计更有效的模型评测体系,弥补 AI 能力与真实需求的差距。

搜索

搜索

OpenAI 研究员姚顺雨近期发布文章,指出:AI 下半场将聚焦问题定义与评估体系重构。在 AI 发展新阶段,行业需要通过设计更有效的模型评测体系,弥补 AI 能力与真实需求的差距。

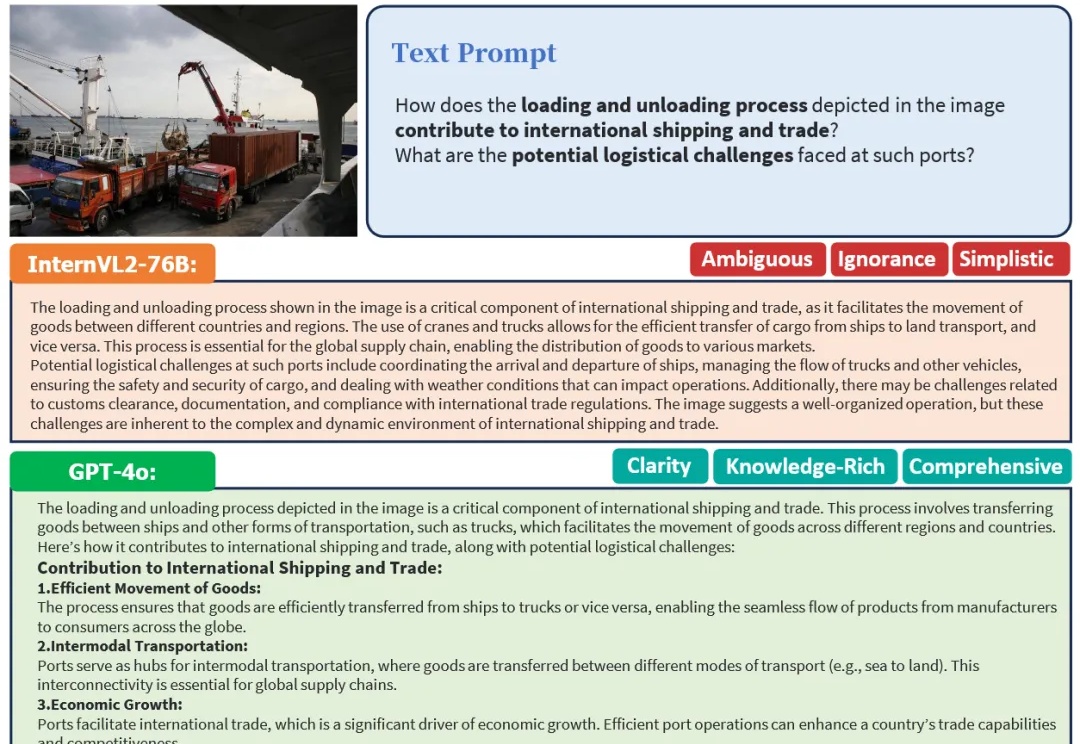

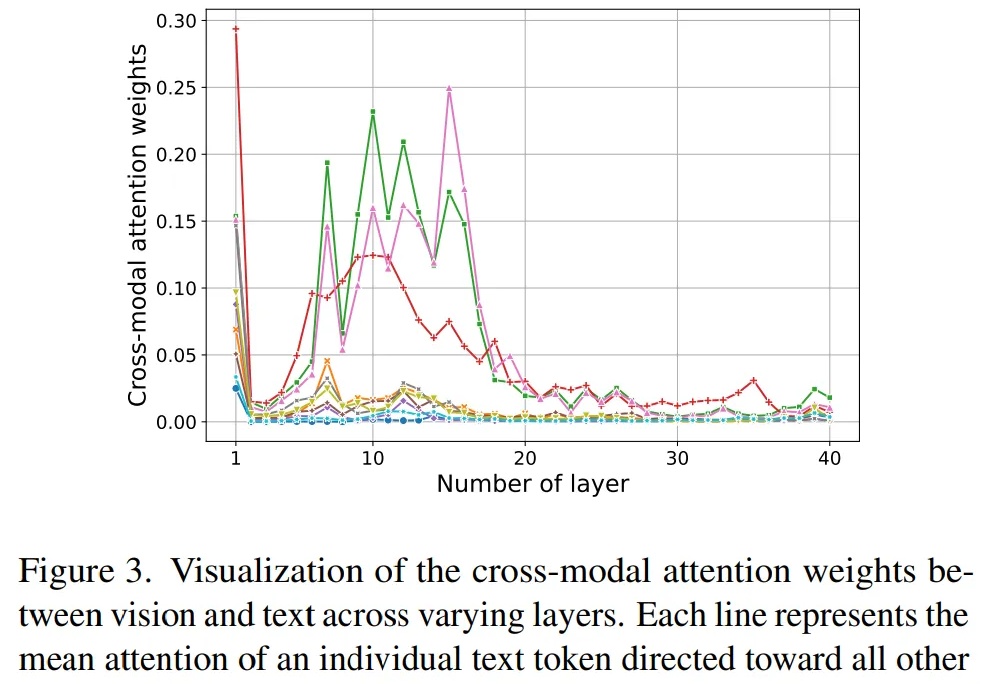

近年来,随着大型语言模型(LLMs)的快速发展,多模态理解领域取得了前所未有的进步。像 OpenAI、InternVL 和 Qwen-VL 系列这样的最先进的视觉-语言模型(VLMs),在处理复杂的视觉-文本任务时展现了卓越的能力。

是的,Rabbit,那个一度声名鹊起的第一代 AI 硬件公司,下场做 AI Agent 了。

去年 Anthropic 发布 Computer Use 的时候,引发了一次大家对 AI agent 的想象。

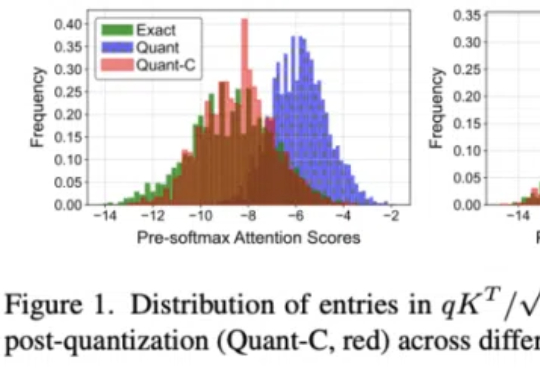

在InternVL-2.5上实现10倍吞吐量提升,模型性能几乎无损失。

清华智能产业研究院(AIR)博三在读,去年六月份,出于对语言模型 LLM 的强烈兴趣,加入了字节 as Top Seed Intern,在人工智能的最前沿进行探索。刚好这个话题和我现在做的工作强相关,我分享一下自己的观点和亲身体验。

在实际应用过程中,闭源模型(GPT-4o)等在回复的全面性、完备性、美观性等方面展示出了不俗的表现。

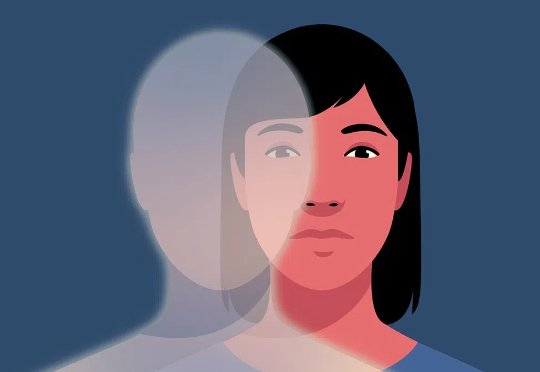

这项最新研究,由北京师范大学和南开大学的研究者们共同完成,于2025年发表于Internet Interventions 上,你只需要写一封信,写给自己,然后让ChatGPT 来给你一点反馈。不用约时间、也不用担心费用,只要在屏幕上敲下几行字,焦虑竟然真的能减少。

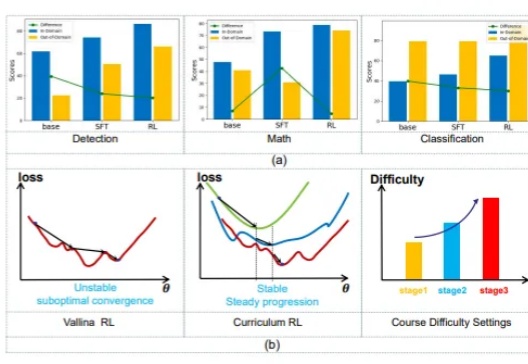

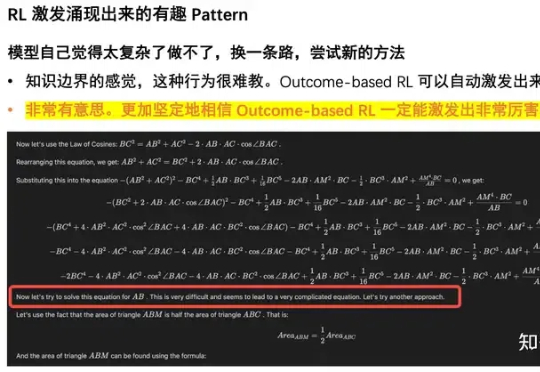

OpenAI o1大火之后,国内外上演的AI推理能力竞赛可以说是2024下半年AI领域最大看点了。

尽管近期 Qwen2-VL 和 InternVL-2.0 的出现将开源多模态大模型的 SOTA 提升到了新高度,但巨大的计算开销限制了其在很多场景下的应用。