现在,轮到人类给AI讲故事了?

现在,轮到人类给AI讲故事了?继“结构式”“压缩式”“共振式”之后,一直在想第四种与 AI 交流的路,可能会是什么?

继“结构式”“压缩式”“共振式”之后,一直在想第四种与 AI 交流的路,可能会是什么?

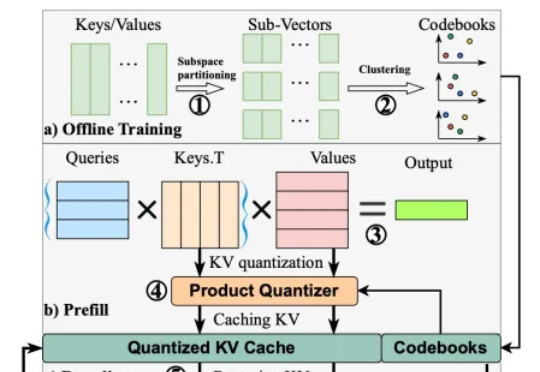

在以 transformer 模型为基础的大模型中,键值缓存虽然用以存代算的思想显著加速了推理速度,但在长上下文场景中成为了存储瓶颈。为此,本文的研究者提出了 MILLION,一种基于乘积量化的键值缓存压缩和推理加速设计。

大型语言模型(LLMs)在广泛的自然语言处理(NLP)任务中展现出了卓越的能力。

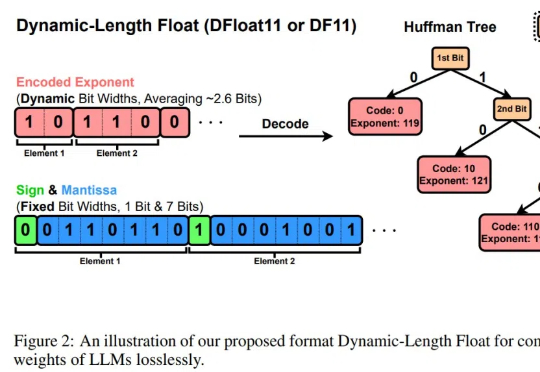

LLM的规模爆炸式增长,传统量化技术虽能压缩模型,却以牺牲精度为代价。莱斯大学团队的最新研究DFloat11打破这一僵局:它将模型压缩30%且输出与原始模型逐位一致!更惊艳的是,通过针对GPU的定制化解压缩内核,DFloat11使推理吞吐量提升最高38.8倍。

Nemotron-H模型混合了Transformer和Mamba架构,使长文本推理速度提升3倍,同时还能保持高性能,开源版本包括8B和56B尺寸。训练过程采用FP8训练和压缩技术,进一步提高了20%推理速度

从人们被大模型“震撼”完开始思考如何把这项技术用起来的第一天,教育就是被很多人天然想到的场景。一个能压缩全世界知识的AI,天然就是一个人类想象里“老师”的样子。

诺奖得主Demis Hassabis表示,通过AI,DeepMind团队在一年里,完成了10亿年的博士研究时间!10亿年的科学探索被压缩到了一年之内,或许这才代表了AI技术的最高使命。

欧洲初创公司 Pruna AI 一直在研究 AI 模型的压缩算法,该公司的优化框架将于周四开源。Pruna AI 在几个月前完成了 650 万美元的种子轮融资。参与此次初创公司投资的包括 EQT Ventures、Daphni、Motier Ventures 以及 Kima Ventures。

国内首款全流程 AI 互动小说创作工具「谜境 Agent」于近日上线,该工具通过整合剧本生成、美术绘制、交互设计等模块,将传统需要 4-6 个月的开发周期压缩至 10 分钟内完成。

「压缩即智能」。这并不是一个新想法,著名 AI 研究科学家、OpenAI 与 SSI 联合创始人 Ilya Sutskever 就曾表达过类似的观点。