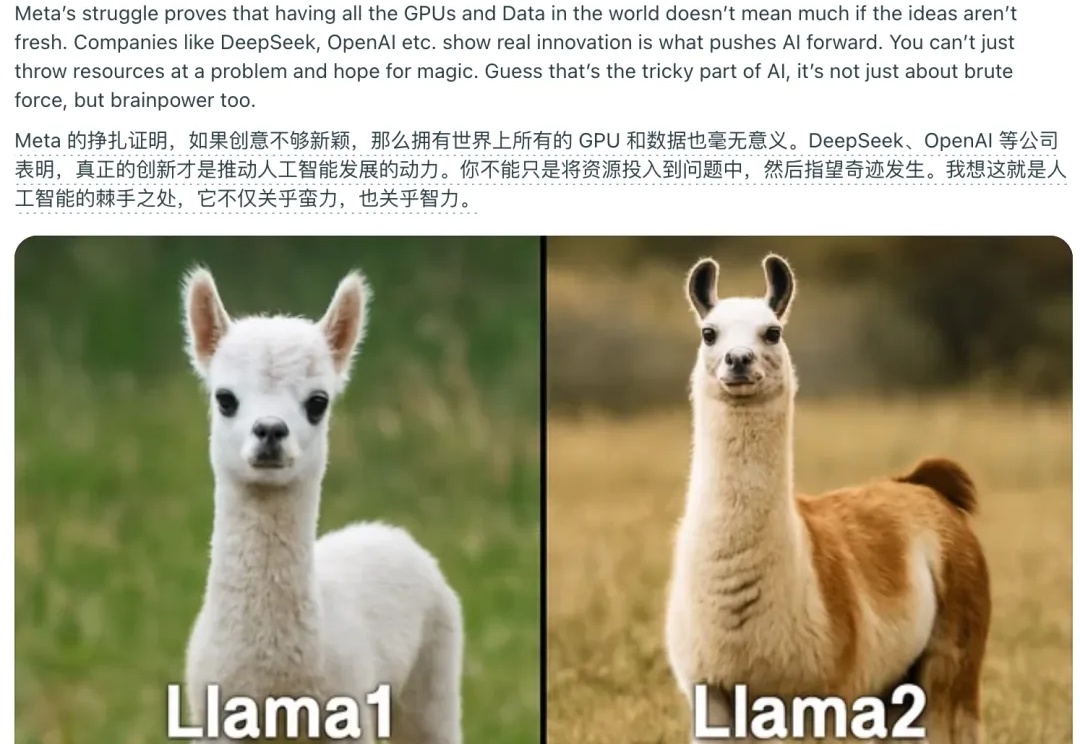

Llama 4五大疑点曝光,逐层扒皮!全球AI进步停滞,NYU教授称Scaling彻底结束

Llama 4五大疑点曝光,逐层扒皮!全球AI进步停滞,NYU教授称Scaling彻底结束刚刚,一位AI公司CEO细细扒皮了关于Llama 4的五大疑点。甚至有圈内人表示,Llama 4证明Scaling已经结束了,LLM并不能可靠推理。但更可怕的事,就是全球的AI进步恐将彻底停滞。

搜索

搜索

刚刚,一位AI公司CEO细细扒皮了关于Llama 4的五大疑点。甚至有圈内人表示,Llama 4证明Scaling已经结束了,LLM并不能可靠推理。但更可怕的事,就是全球的AI进步恐将彻底停滞。

多点发力,协同并进,才能让AI的成长有更多道路可走

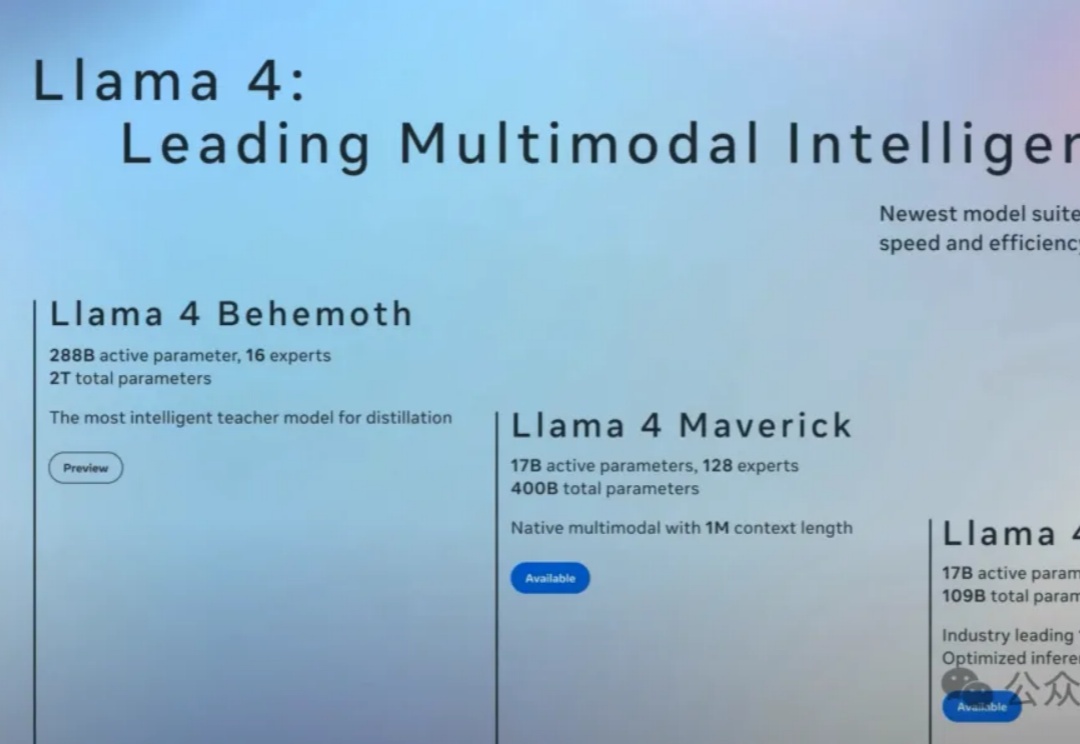

Llama 4真要被锤爆了,这次是大模型竞技场(Chatbot Arena)官方亲自下场开怼:

大家翘首以盼的 Llama 4,用起来为什么那么拉跨?

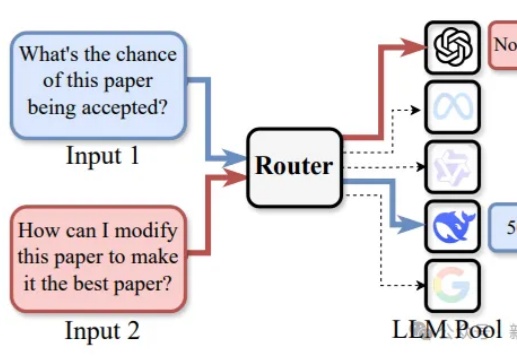

路由LLM是指一种通过router动态分配请求到若干候选LLM的机制。论文提出且开源了针对router设计的全面RouterEval基准,通过整合8500+个LLM在12个主流Benchmark上的2亿条性能记录。将大模型路由问题转化为标准的分类任务,使研究者可在单卡甚至笔记本电脑上开展前沿研究。

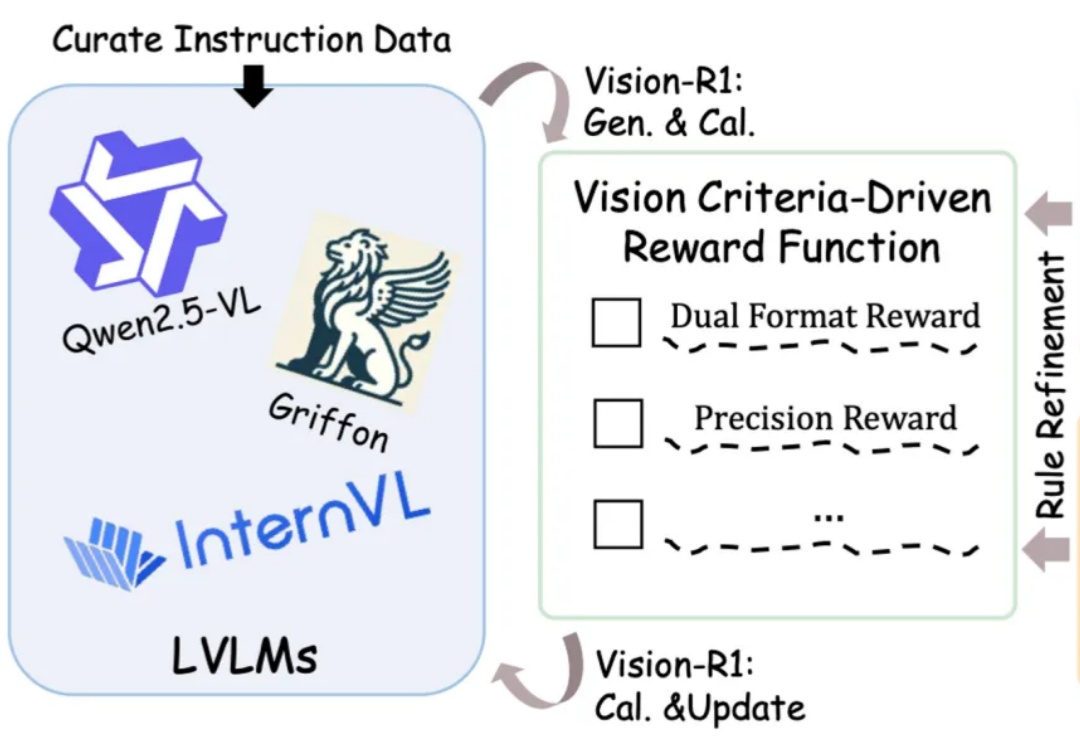

图文大模型通常采用「预训练 + 监督微调」的两阶段范式进行训练,以强化其指令跟随能力。受语言领域的启发,多模态偏好优化技术凭借其在数据效率和性能增益方面的优势,被广泛用于对齐人类偏好。目前,该技术主要依赖高质量的偏好数据标注和精准的奖励模型训练来提升模型表现。然而,这一方法不仅资源消耗巨大,训练过程仍然极具挑战。

今日凌晨,Meta AI 部门副总裁 Ahmad Al-Dahle 发文,回应了近日发布的 Llama 4 大模型的争议问题:对于「不同服务中模型质量参差不齐」这一问题,Ahmad Al-Dahle 解释称,由于模型一准备好就发布了,所以 Meta 的团队预计所有公开的应用实现都需要几天时间来进行优化调整,团队后续会继续进行漏洞修复工作。

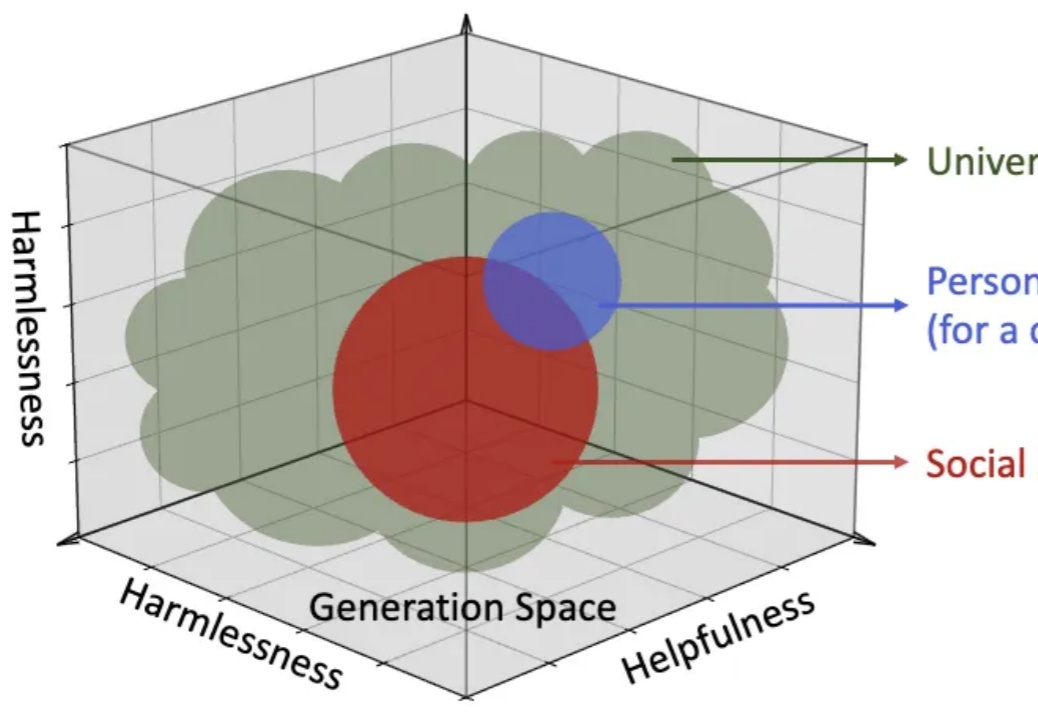

如何让大模型更懂「人」?

Meta最新基础模型Llama 4发布36小时后,评论区居然是这个画风:

「未来,99% 的 attention 将是大模型 attention,而不是人类 attention。」这是 AI 大牛 Andrej Karpathy 前段时间的一个预言。这里的「attention」可以理解为对内容的需求、处理和分析。也就是说,他预测未来绝大多数资料的处理工作将由大模型来完成,而不是人类。