大模型「强崩溃」!Meta新作:合成数据有「剧毒」,1%即成LLM杀手

大模型「强崩溃」!Meta新作:合成数据有「剧毒」,1%即成LLM杀手1%的合成数据,就让LLM完全崩溃了? 7月,登上Nature封面一篇论文证实,用合成数据训练模型就相当于「近亲繁殖」,9次迭代后就会让模型原地崩溃。

来自主题: AI技术研报

6102 点击 2024-10-14 10:12

搜索

搜索

1%的合成数据,就让LLM完全崩溃了? 7月,登上Nature封面一篇论文证实,用合成数据训练模型就相当于「近亲繁殖」,9次迭代后就会让模型原地崩溃。

善智者,动于九天之上。

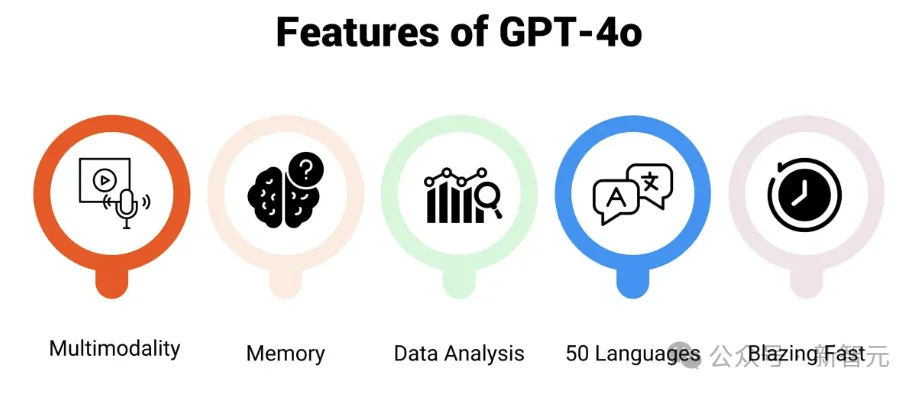

多模态大语言模型(MLLM)如今已是大势所趋。 过去的一年中,闭源阵营的GPT-4o、GPT-4V、Gemini-1.5和Claude-3.5等模型引领了时代。

教育大模型是真刚需。

计算资源并非性能提升的唯一途径:Arvind Narayanan 认为,仅仅增加计算资源并不总是能带来模型性能的等比提升。目前,数据量正逐渐成为限制AI发展的主要瓶颈。

5 大证据显示,LLM 在推理复杂问题时非常脆弱。

借助AI工具,研究人员有更多方法来快速筛选总结研究文献,他们又是如何正确/谨慎使用这些AI工具的?

AI浪潮已至,威胁更要警惕

中国厂商如何在AI浪潮中破局? 近日,在2024年诺贝尔三大科学奖项中,两大奖项与人工智能研究相关,先是物理学奖颁给了曾获图灵奖的机器学习先驱,紧接着化学奖也将一半颁给了“程序员”。

大厂在内容生态上的深耕,成为Kimi们难以企及的优势。 国内互联网行业许久不见的烧钱大战,终于在AI大模型应用的厮杀中复现。