从模型、数据和框架三个视角出发,这里有份54页的高效大语言模型综述

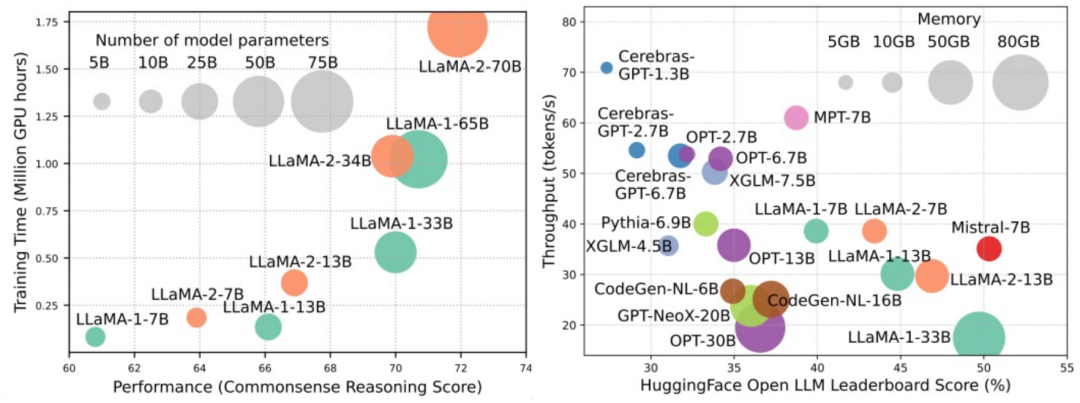

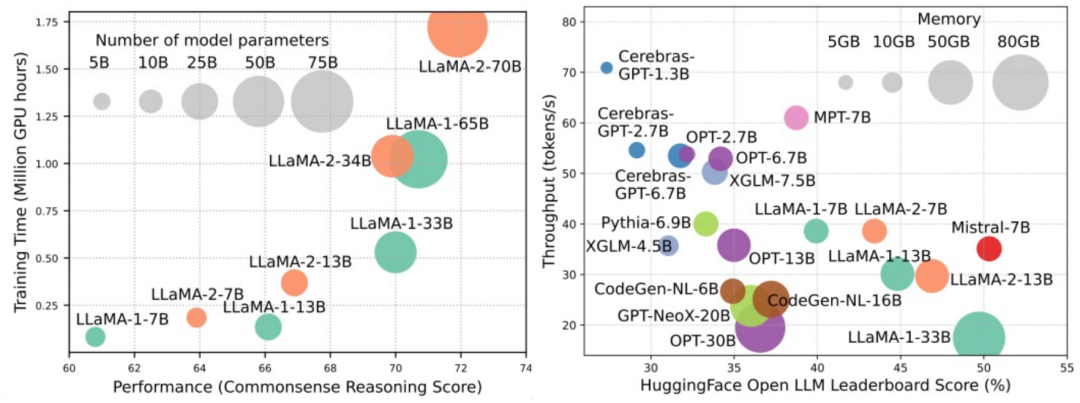

从模型、数据和框架三个视角出发,这里有份54页的高效大语言模型综述大规模语言模型(LLMs)在很多关键任务中展现出显著的能力,比如自然语言理解、语言生成和复杂推理,并对社会产生深远的影响。然而,这些卓越的能力伴随着对庞大训练资源的需求(如下图左)和较长推理时延(如下图右)。因此,研究者们需要开发出有效的技术手段去解决其效率问题。

大规模语言模型(LLMs)在很多关键任务中展现出显著的能力,比如自然语言理解、语言生成和复杂推理,并对社会产生深远的影响。然而,这些卓越的能力伴随着对庞大训练资源的需求(如下图左)和较长推理时延(如下图右)。因此,研究者们需要开发出有效的技术手段去解决其效率问题。

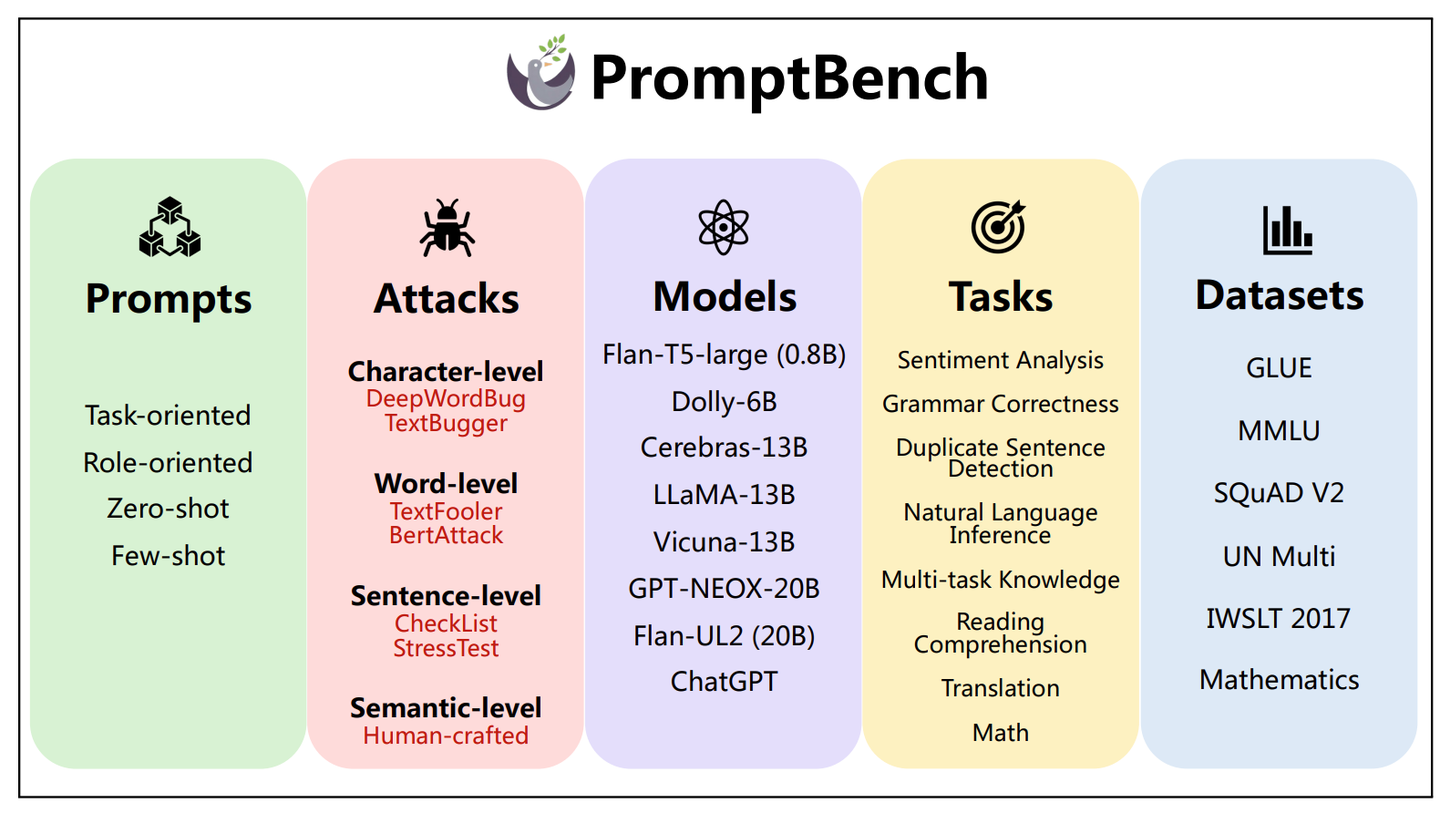

作为连接人类与大模型的桥梁,大模型对 「Prompt (提示词)」 究竟有多敏感?同样的prompt,可能写错个单词、写法不一样,都会出现不一样的结果。

MIT、微软联合研究:不需要额外训练,也能增强大语言模型的任务性能并降低其大小。

游戏行业真在加速拥抱大语言模型等AI技术,不论是大厂还是独立游戏制作人,都开始依靠LLM的技术创立全新的AI NPC体验。

教育硬件可能是AI大语言模型最大受益者。

你敢信?大熊猫都会打牌了!

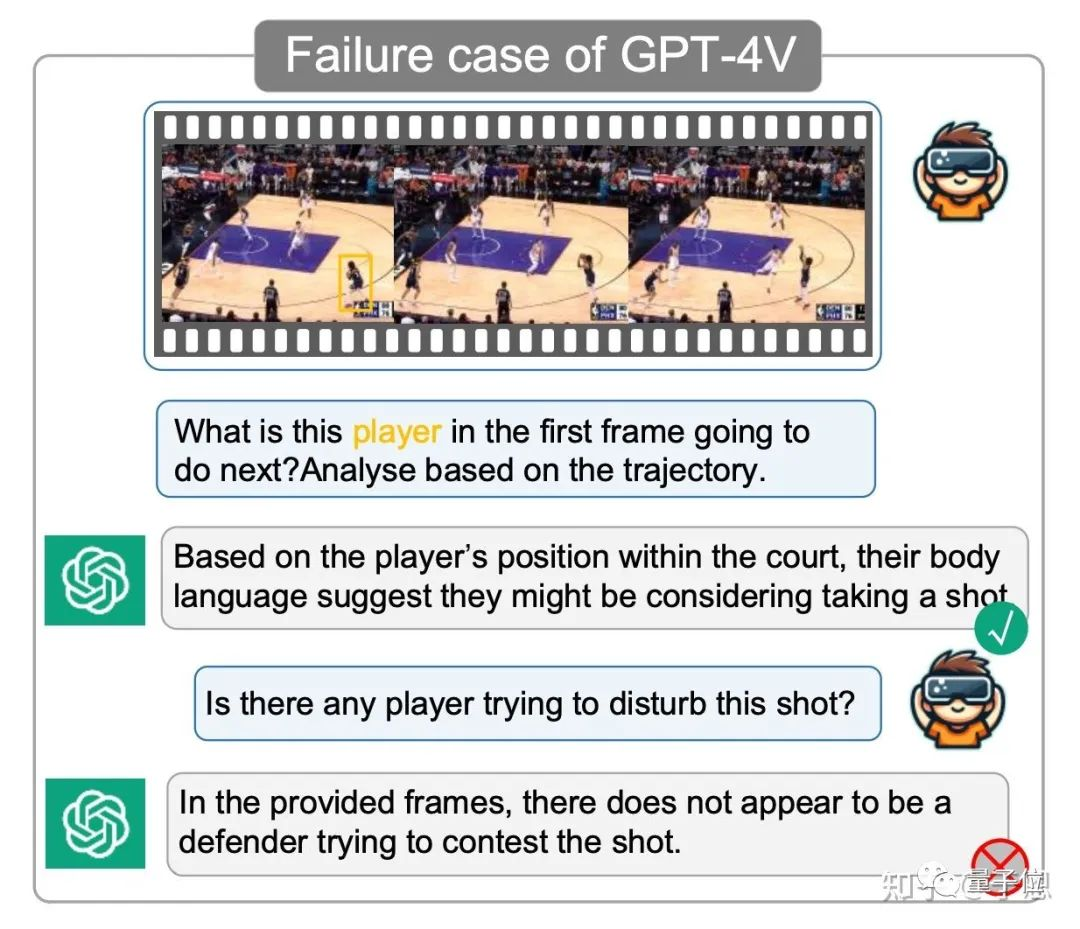

多模态大语言模型展现了强大的图像理解和推理能力。但要让它们基于当前观测来对未来事件进行预测推理仍然非常困难。

大语言模型作为操作系统级的技术革新,在 2023 年涌现出强大的理解和推理能力。在大模型走向日臻完善的过程中,相信 AGI 的先行者已经率先把新一代技术底座融入进产品,来增强个体的人生。

据外媒报道,在生成式AI竞争中处于落后的字节跳动想要“抄近道”,该公司一直在秘密使用OpenAI的技术开发自家大语言模型,这违反了OpenAI的服务条款。

大语言模型(LLM)被越来越多应用于各种领域。然而,它们的文本生成过程既昂贵又缓慢。这种低效率归因于自回归解码的运算规则:每个词(token)的生成都需要进行一次前向传播,需要访问数十亿至数千亿参数的 LLM。这导致传统自回归解码的速度较慢。