扩散模型如何构建新一代决策智能体?超越自回归,同时生成长序列规划轨迹

扩散模型如何构建新一代决策智能体?超越自回归,同时生成长序列规划轨迹近期的研究表明,采用扩散模型的规划模块能够同时生成长序列的轨迹规划,这更加符合人类的决策模式。此外,扩散模型在策略表征和数据合成方面也能为现有的决策智能算法提供更优的选择。

搜索

搜索

近期的研究表明,采用扩散模型的规划模块能够同时生成长序列的轨迹规划,这更加符合人类的决策模式。此外,扩散模型在策略表征和数据合成方面也能为现有的决策智能算法提供更优的选择。

“猛增至91万、涨幅高达264%、34倍”这一数据来自GitHub 上的AI开源项目统计对比。

牛津大学 VGG 实验室 Andrew Zisserman 团队最新工作系统性解决了任意物体的遮挡补全问题,并且为这一问题提出了一个新的更加精确的评估数据集。该工作受到了 MPI 大佬 Michael Black、CVPR 官方账号、南加州大学计算机系官方账号等在 X 平台的点赞。

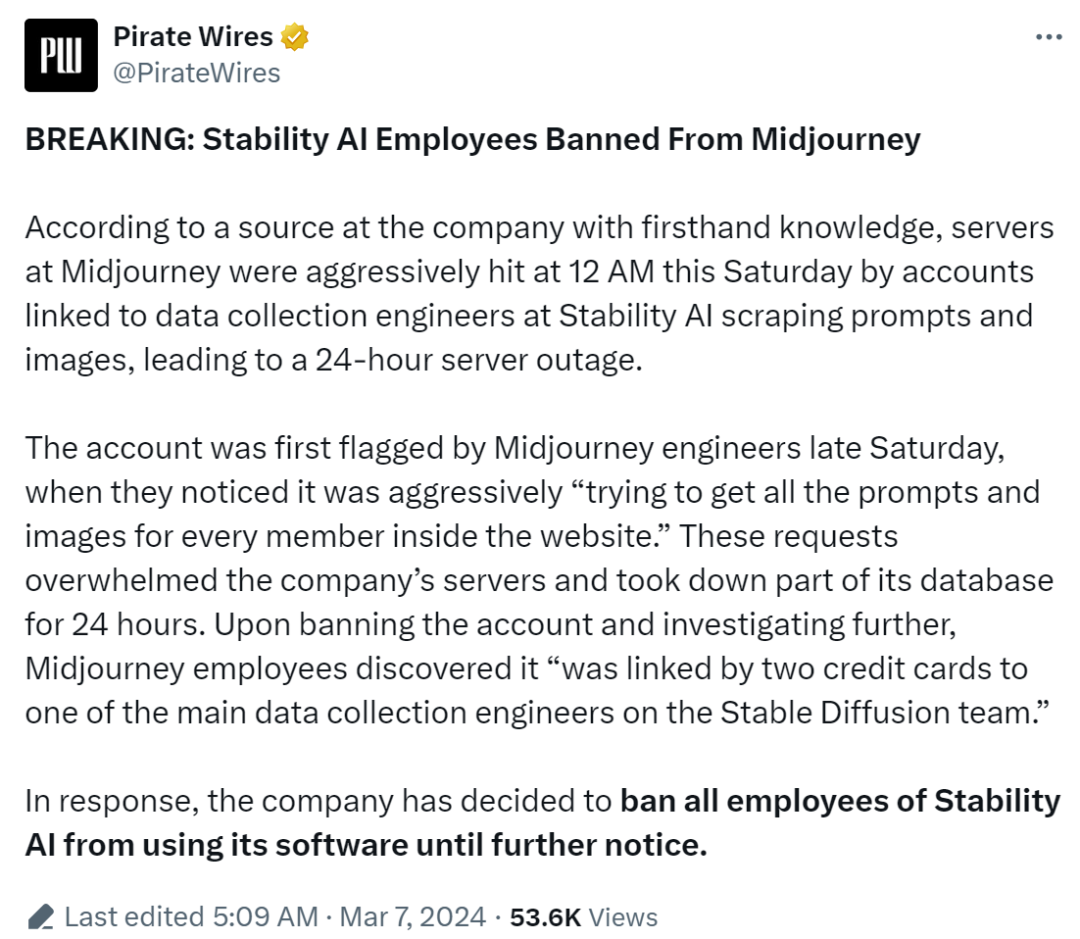

Midjourney 把 Stability AI 拉入黑名单了,禁止后者所有员工使用其软件,直至另行通知。

高中阶段学习数据科学能不能代替数学,这个话题的讨论已经延伸到了 AI 圈。

虽然 AI 生图领域,看似百花齐放,但论资排辈,Midjourney、Stability AI 还是很受用户欢迎的。就算是竞争对手,Midjourney 也不至于禁止 Stability AI 员工使用其软件吧。

谷歌决定不共享用于生成模型的数据,甚至不共享模型结果本身。唯一共享的数据是模型最终识别出的稳定晶体,这让人难以复现模型。

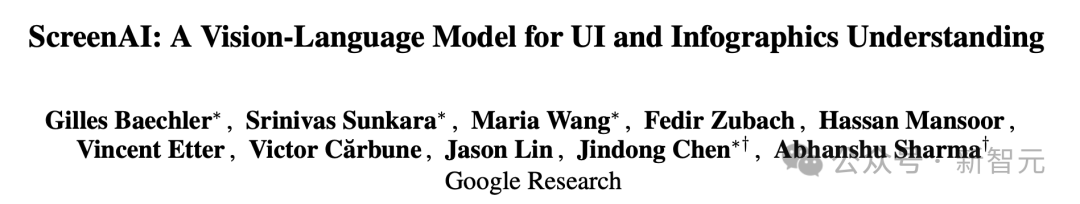

谷歌在语言和声控计算机界面的漫长道路上又迈出了重要一步。最新ScreenAI视觉语言模型,能够完成各种屏幕QA问答、总结摘要等任务。

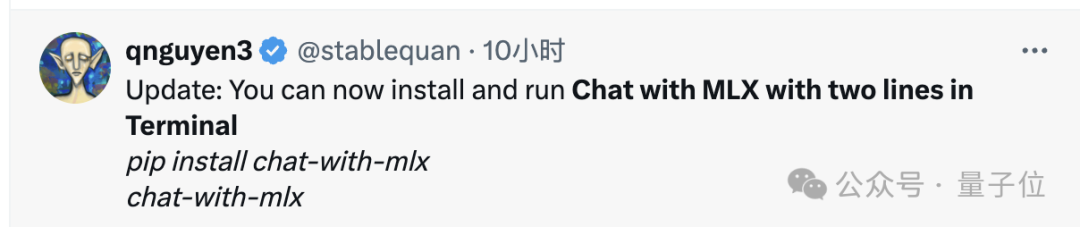

Mac用户,终于不用羡慕N卡玩家有专属大模型Chat with RTX了!

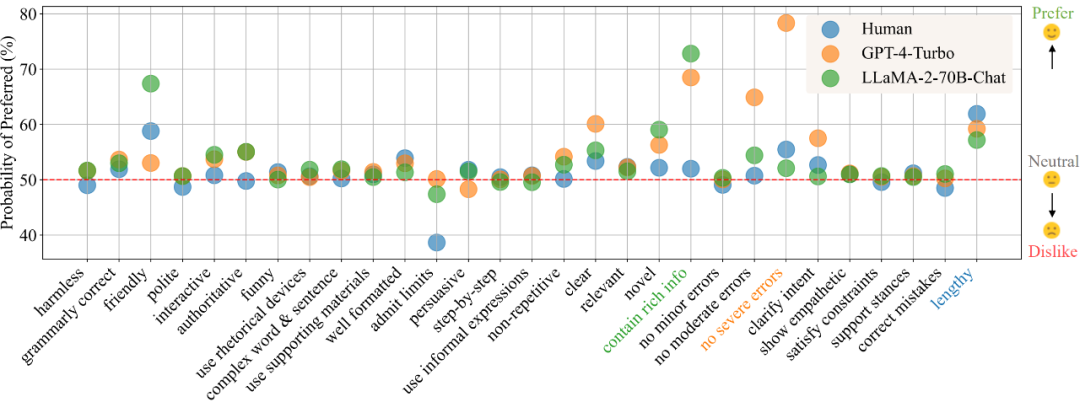

在目前的模型训练范式中,偏好数据的的获取与使用已经成为了不可或缺的一环。在训练中,偏好数据通常被用作对齐(alignment)时的训练优化目标,如基于人类或 AI 反馈的强化学习(RLHF/RLAIF)或者直接偏好优化(DPO),而在模型评估中,由于任务的复杂性且通常没有标准答案,则通常直接以人类标注者或高性能大模型(LLM-as-a-Judge)的偏好标注作为评判标准。