挑战WorldLabs:Visionary,一个全面超越Marble底层渲染器的WebGPU渲染平台

挑战WorldLabs:Visionary,一个全面超越Marble底层渲染器的WebGPU渲染平台在李飞飞团队 WorldLabs 推出 Marble、引爆「世界模型(World Model)」热潮之后,一个现实问题逐渐浮出水面:世界模型的可视化与交互,依然严重受限于底层 Web 端渲染能力。

在李飞飞团队 WorldLabs 推出 Marble、引爆「世界模型(World Model)」热潮之后,一个现实问题逐渐浮出水面:世界模型的可视化与交互,依然严重受限于底层 Web 端渲染能力。

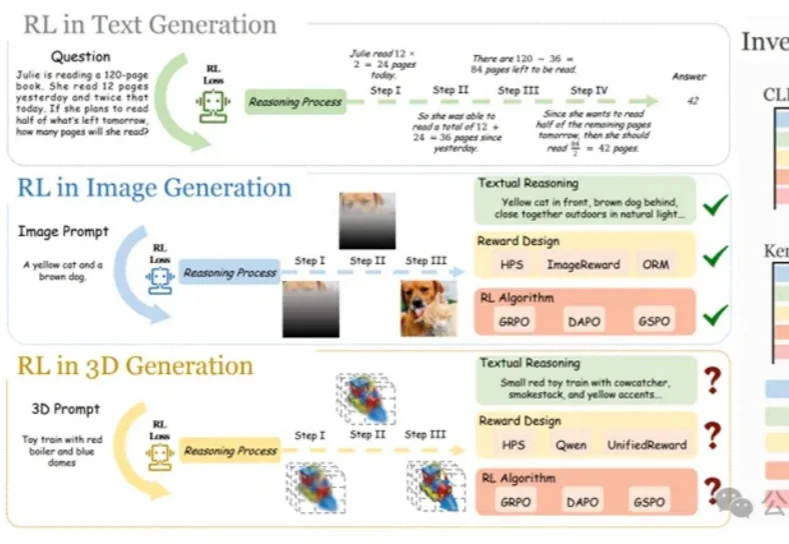

在大语言模型和文生图领域,强化学习(RL)已成为提升模型思维链与生成质量的关键方法。

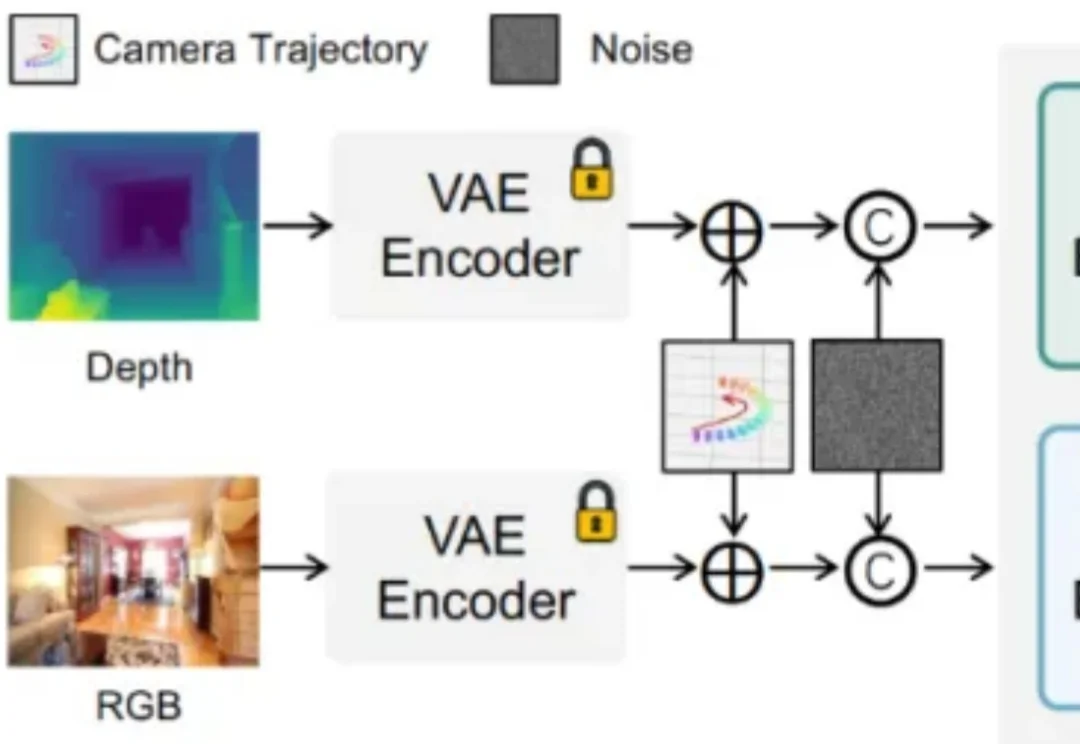

你的生成模型真的「懂几何」吗?还是只是在假装对齐相机轨迹?

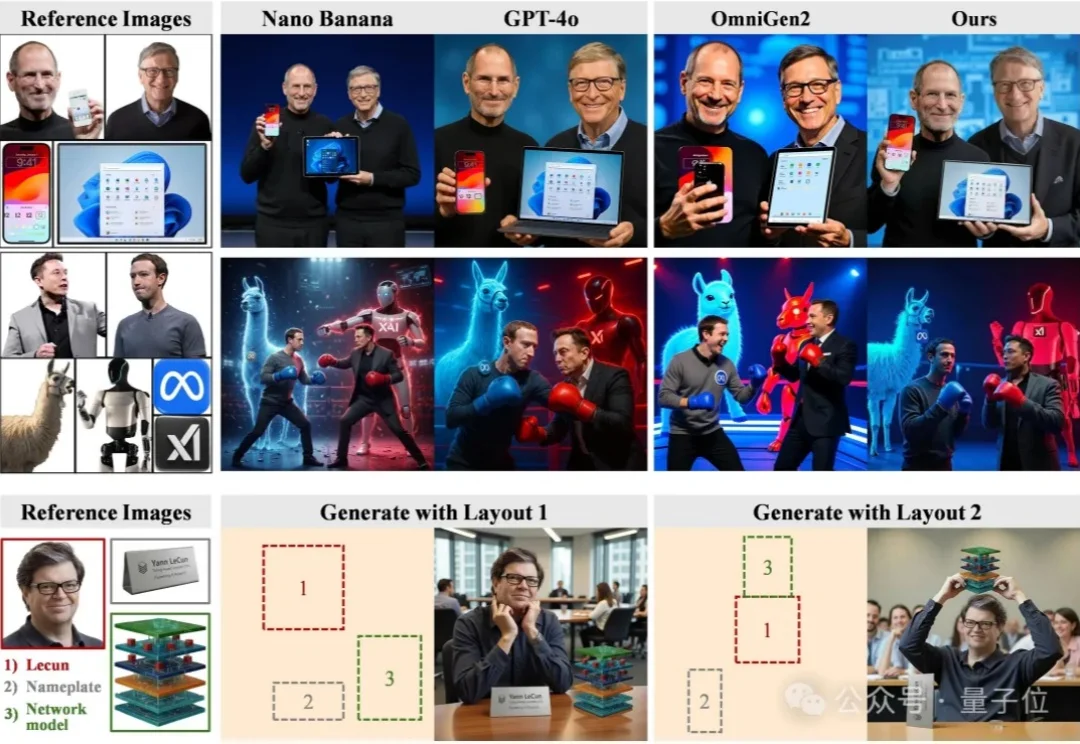

尽管扩散模型在单图像生成上已经日渐成熟,但当任务升级为高度定制化的多实例图像生成(Multi-Instance Image Generation, MIG)时,挑战随之显现:

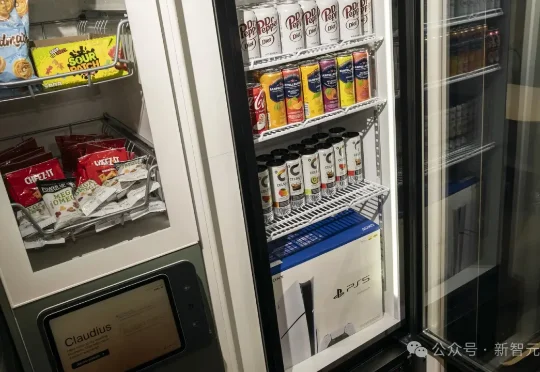

Anthropic让Claude独立经营小卖部,没想到全球顶尖的智能体,在实验中不仅免费送PS5和各种商品,连小卖部的AI「老板」也被一张伪造的PDF文件「骗」下了台。在人类面前,再顶级的大模型仍显得过于「天真」和「单纯」,很容易就被套路和操纵。

刚刚,上海大模型独角兽MiniMax,正式通过港交所聆讯,吹响了IPO冲刺号角。但直到招股书披露,更重要的资本吸引力原因才完全明确——不仅因为全模态能力全球领先,更关键的是,累计花费只用了5亿美元,不到OpenAI的1%。

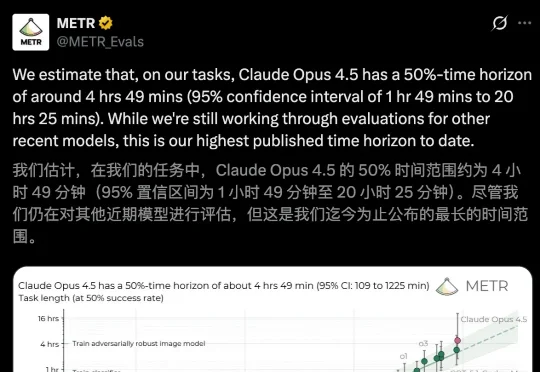

2025年就要结束了,原来真正的高手,隐藏在「民间」!不是谷歌、不是OpenAI,是Anthropic王者编程模型Claude Opus 4.5。在METR最新公布报告称,Claude Opus 4.5已能够持续自主编码「长达5小时不崩」。

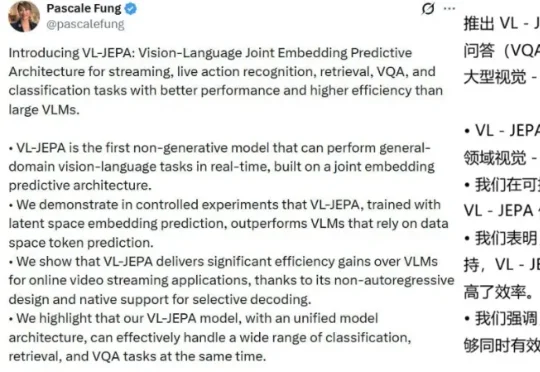

近日,来自 Meta、香港科技大学、索邦大学、纽约大学的一个联合团队基于 JEPA 打造了一个视觉-语言模型:VL-JEPA。据作者 Pascale Fung 介绍,VL-JEPA 是第一个基于联合嵌入预测架构,能够实时执行通用领域视觉-语言任务的非生成模型。

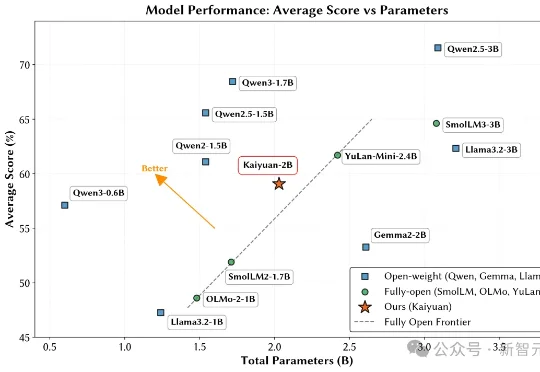

鹏城实验室与清华大学PACMAN实验室联合发布了鹏城脑海‑2.1‑开元‑2B(PCMind‑2.1‑Kaiyuan‑2B,简称开元‑2B)模型,并以全流程开源的方式回应了这一挑战——从训练数据、数据处理框架、训练框架、完整技术报告到最终模型权重,全部开源。

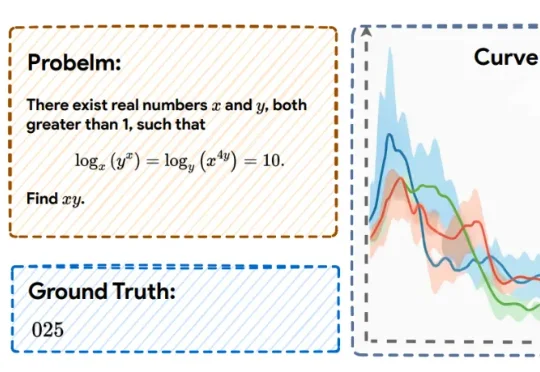

近日,上海人工智能实验室的研究团队提出了一种全新的后训练范式——RePro(Rectifying Process-level Reward)。这篇论文将推理的过程视为模型内部状态的优化过程,从而对如何重塑大模型的CoT提供了一个全新视角: