看懂网飞版「三体」!Reka Core登场:挑战GPT-4、Claude 3

看懂网飞版「三体」!Reka Core登场:挑战GPT-4、Claude 3近日,由DeepMind、谷歌和Meta的研究人员创立的AI初创公司Reka,推出了他们最新的多模态语言模型——Reka Core

近日,由DeepMind、谷歌和Meta的研究人员创立的AI初创公司Reka,推出了他们最新的多模态语言模型——Reka Core

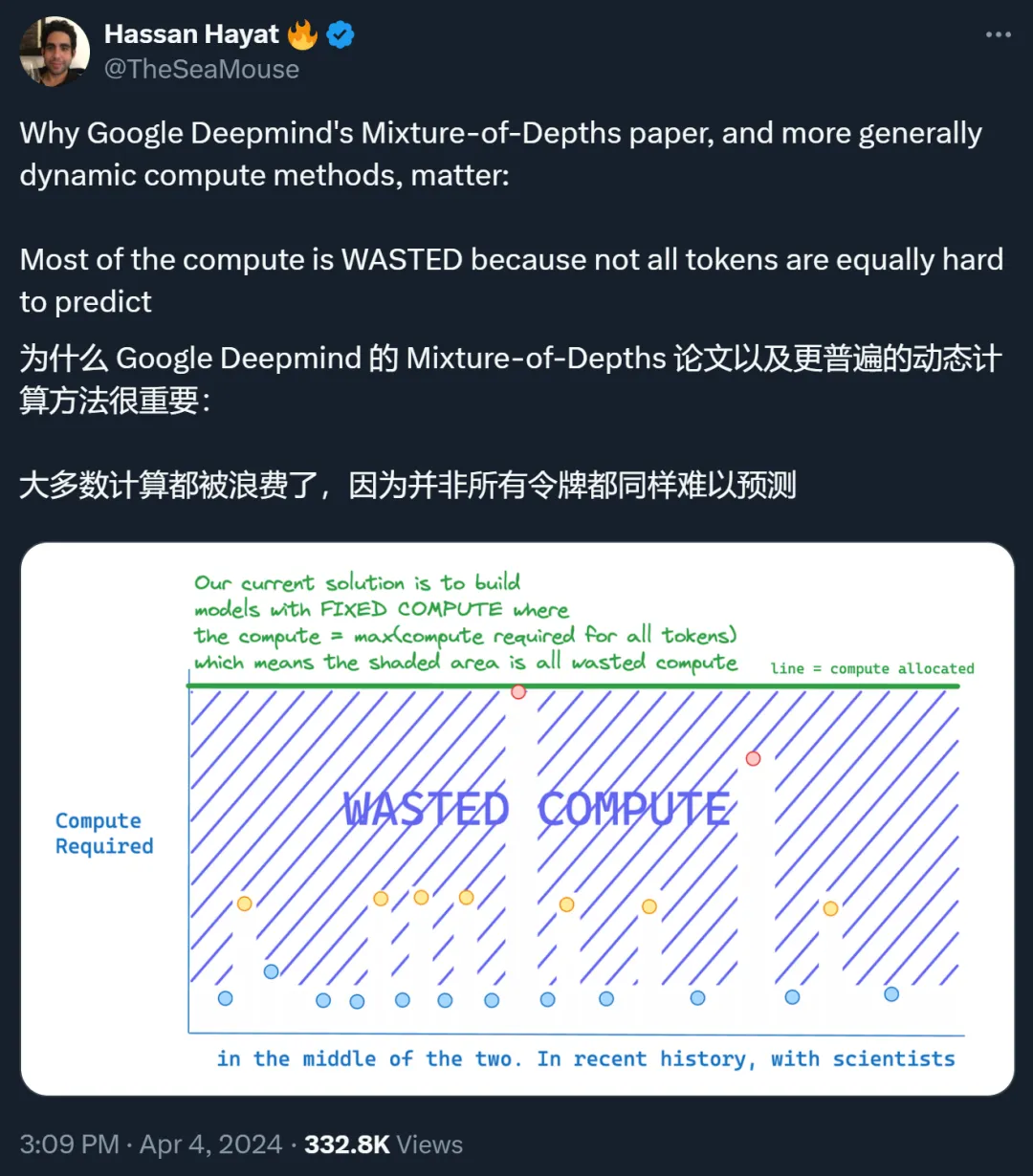

Transformer 的重要性无需多言,目前也有很多研究团队致力于改进这种变革性技术,其中一个重要的改进方向是提升 Transformer 的效率,比如让其具备自适应计算能力,从而可以节省下不必要的计算。

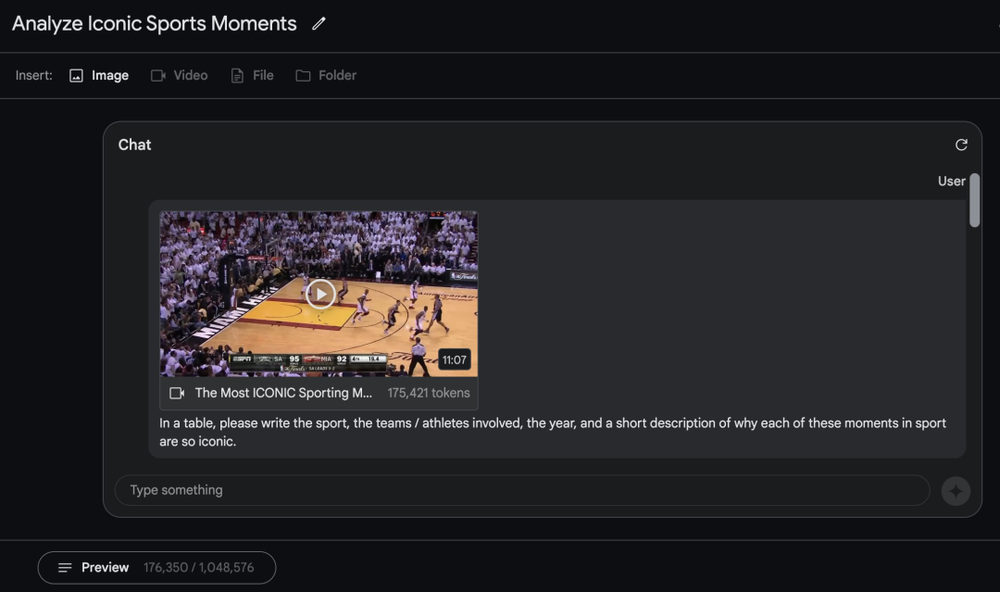

通过这项技术,能使transformer大模型在有限的计算资源 条件下,处理无限长度的输入。

2016 年,Google CEO 桑达尔·皮查伊在 I/O 开发者大会上豪情满怀地向全世界宣布: Google 已经成为了搜索的代名词,Alphabet 未来将成为一家 AI 优先的公司。

太平洋时间4月9日,谷歌、OpenAl、Mistral在24小时内,接连发布大模型重磅更新。

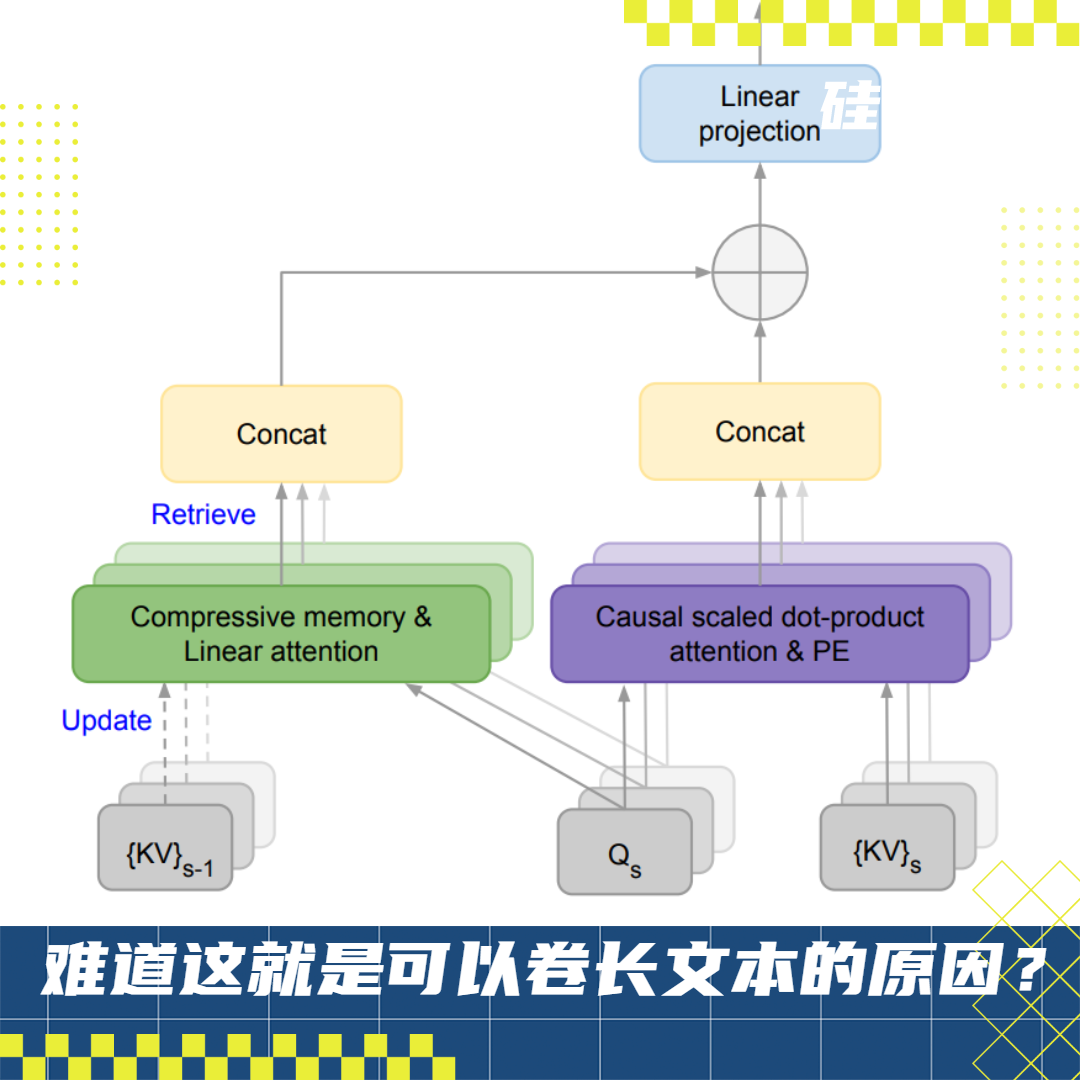

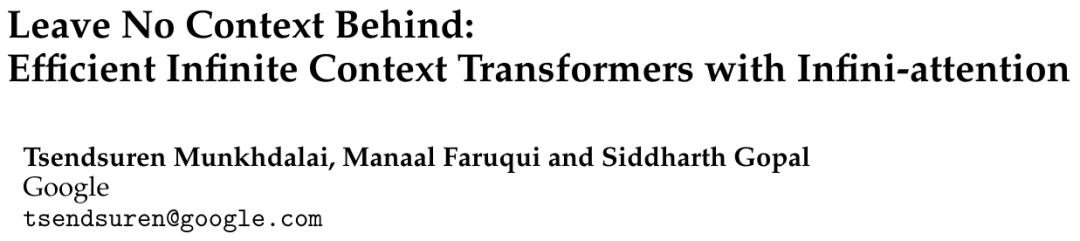

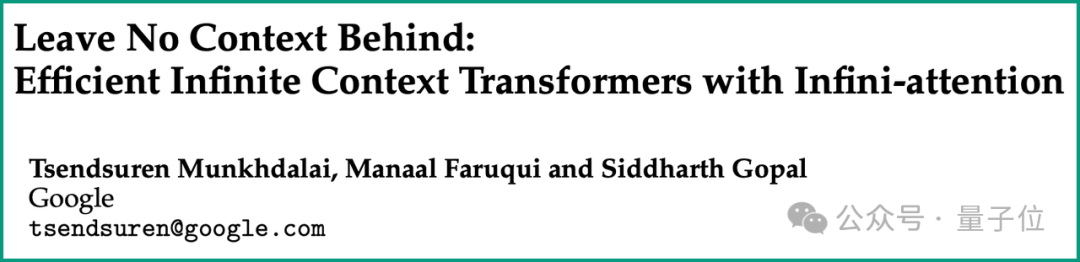

为解决大模型(LLMs)在处理超长输入序列时遇到的内存限制问题,本文作者提出了一种新型架构:Infini-Transformer,它可以在有限内存条件下,让基于Transformer的大语言模型(LLMs)高效处理无限长的输入序列。实验结果表明:Infini-Transformer在长上下文语言建模任务上超越了基线模型,内存最高可节约114倍。

它通过将压缩记忆(compressive memory)整合到线性注意力机制中,用来处理无限长上下文

谷歌又放大招了,发布下一代 Transformer 模型 Infini-Transformer。

正式与其他几位伯克利大牛学者、谷歌DeepMind科学家共同创业,全力为机 器人打造智能大脑

趁着谷歌开大会,OpenAI果然又来定向狙击了。 谷歌前脚刚官宣一系列更新,OpenAI立马跟着抛出重大消息—— GPT-4 Turbo迎来「重大升级」!