如果把今天最热门的几个方向摆在一起看,你会发现它们其实在卡同一道坎。

做 AIGC 的人会觉得,现在的 3D 生成已经能 “做出东西”,但还很难真正进入创作流程;做 图形学和 动画的人会发现,很多自动生成结果只能看,不能动;做游戏和 VR 的人会关心,这些资产能不能直接进入交互;做仿真和具身智能的人则更在意,生成出来的对象有没有结构、能不能被控制、能不能放进一个可操作的三维世界。

这些问题背后,其实都指向同一个核心门槛:

今天很多 3D AIGC 结果,仍然只是 “静态的 3D 外壳”,而不是 “能动、能控、能进入工作流的数字资产”。

SIGGRAPH 2026 论文 AniGen: Unified S^3 Fields for Animatable 3D Asset Generation 正是在试图跨过这道门槛。它做的不是单纯把一张图变成一个 3D 模型,而是从单张图片直接生成带骨架与蒙皮权重的可动画 3D 资产。

这意味着,对动画制作来说,它生成的不是摆件,而是更接近可直接驱动的角色或道具;对游戏开发来说,它离 “可进入引擎” 的资产更近;对动态创作和视频生成来说,它提供的是可以被重新摆姿态和编排动作的 3D 元素;对仿真和具身智能来说,它生成的也不只是外观,而是带有结构先验、可被进一步控制的对象。

论文来自 VAST 和香港大学,核心目标非常直接:给定单张图片,直接生成带骨架与蒙皮权重的 3D 资产,而不是先生成一个静态模型,再补一套脆弱的自动绑骨流程。

本文作者是来自香港大学博士生黄熠华,通讯作者是VAST公司首席科学家曹炎培博士和香港大学齐晓娟教授。

AniGen 海报

过去两年,AIGC 把 3D 内容生成推到了一个很热的阶段。无论是文生 3D 还是图生 3D,模型已经能生成越来越像样的几何和外观。但在真正的动画、游戏、VR、数字人和具身智能流程里,只有 “像一个 3D 模型” 还远远不够。

真正能进入生产流程的,是可动画 3D 资产。

这类资产除了几何形状本身,还需要完整的骨架结构,以及控制模型如何随骨架运动而变形的蒙皮权重。没有这两样,生成结果再精致,也更像一个静态摆件,而不是可以被驱动、编辑和复用的数字角色或道具。

现有主流方案大多采用 “先生成、再绑骨” 的串行路线。第一步,生成模型根据图片产出一个静态 3D 形状;第二步,再调用自动绑骨方法去推断骨架和蒙皮。

问题恰恰出在第二步。

自动绑骨对几何结构非常敏感,而 AIGC 生成出来的网格,往往会带着一些人眼不太在意、但对算法很致命的小问题。比如局部黏连、细节拓扑不稳定、姿态带来的结构歧义。结果就是,后处理一旦接上,骨架可能缺骨、连错,蒙皮也可能分配失真。模型看着像那么回事,真正动起来却完全不是那回事。

AniGen 的做法,是干脆不把 “形状” 和 “可动性” 拆开处理。

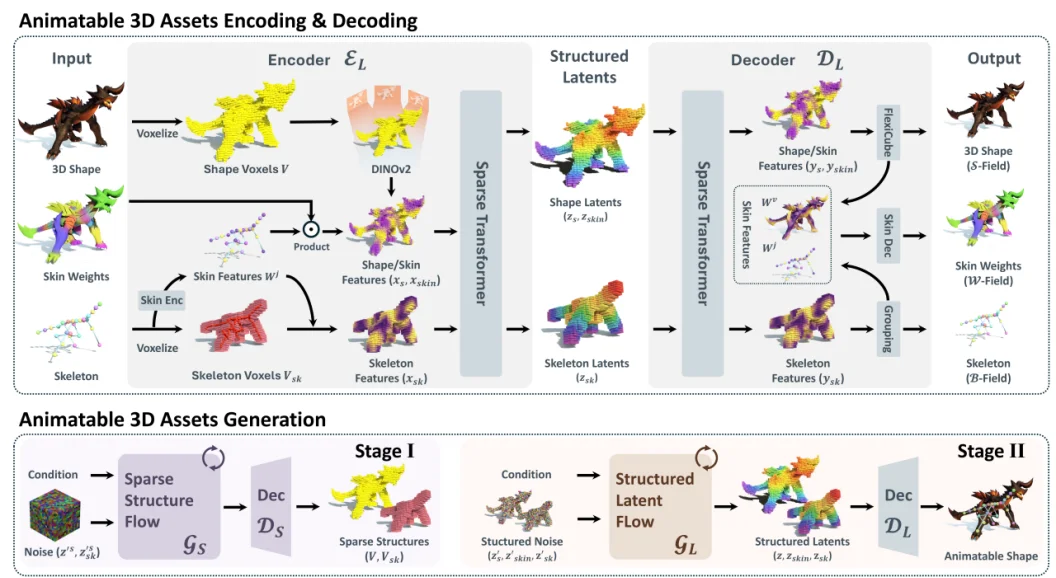

作者提出了一个统一表示,叫 S^3 Fields,把几何、骨架、蒙皮放在同一个共享空间里联合生成。也就是说,模型在生成几何外形的同时,也在同步生成与之匹配的骨架和蒙皮信息,而不是把 rigging 留到最后再补。

为了让这套统一表示真正可学、可生成,作者设计了两个关键模块。

第一个是置信度衰减的骨骼场。可以把它理解成,模型在学骨架的时候,不只是输出 “骨头该长在哪里”,还会显式建模 “哪些区域本来就更模糊、更容易出错”。这样做的好处是,模型不会被边界附近那些歧义位置带偏,最终长出来的骨架更干净、更稳定。

第二个是对偶蒙皮场。蒙皮权重本来很麻烦,因为不同对象的关节数差异很大,鱼、狗、人、机械臂根本不是一个复杂度。AniGen 把这件事改写成一种与关节数量解耦的特征表示,因此同一套网络就能覆盖更广的类别。

在生成流程上,它采用两阶段 flow matching。第一阶段先生成稀疏的结构脚手架,第二阶段再在这个结构基础上补全高分辨率几何和 articulation 细节。这个顺序很像先把 “骨架轮廓和组织方式” 搭出来,再往上长肉和细节。

AniGen 方法图

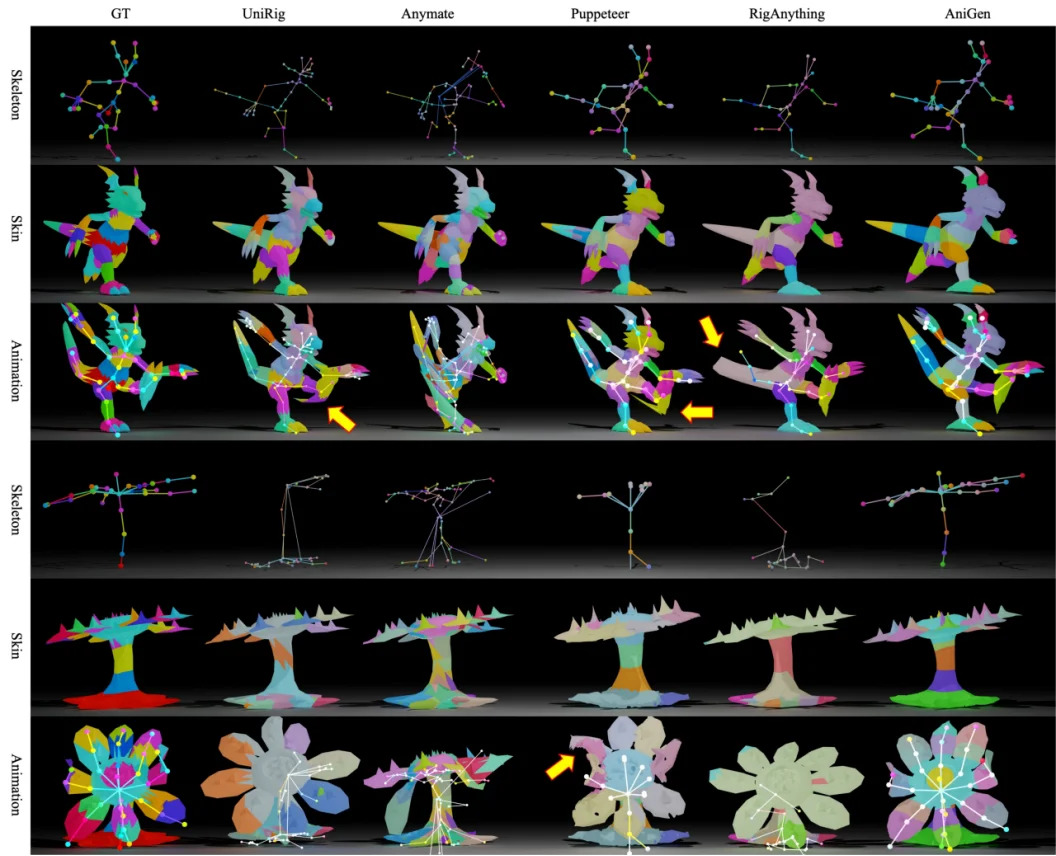

从实验结果看,AniGen 的重点优势不是单纯几何分数,而是 “生成结果到底能不能真正拿去动”。论文在 ArticulationXL 数据集上,把它和 TRELLIS*+UniRig/Anymate/Puppeteer/RigAnything 等强基线做了系统比较。结果显示,AniGen 在骨架结构预测和蒙皮精度上都取得了最好结果,尤其是在更反映骨架拓扑正确性的 Gromov-Wasserstein 距离,以及对蒙皮分布更敏感的 Skin KL 指标上,领先幅度明显。

下图给出了与主流 “先生成、再绑骨” 方案的直观对比。可以看到,在骨架结构、蒙皮质量和最终动画可用性上,AniGen 的结果更稳定:

AniGen 与基线方法对比

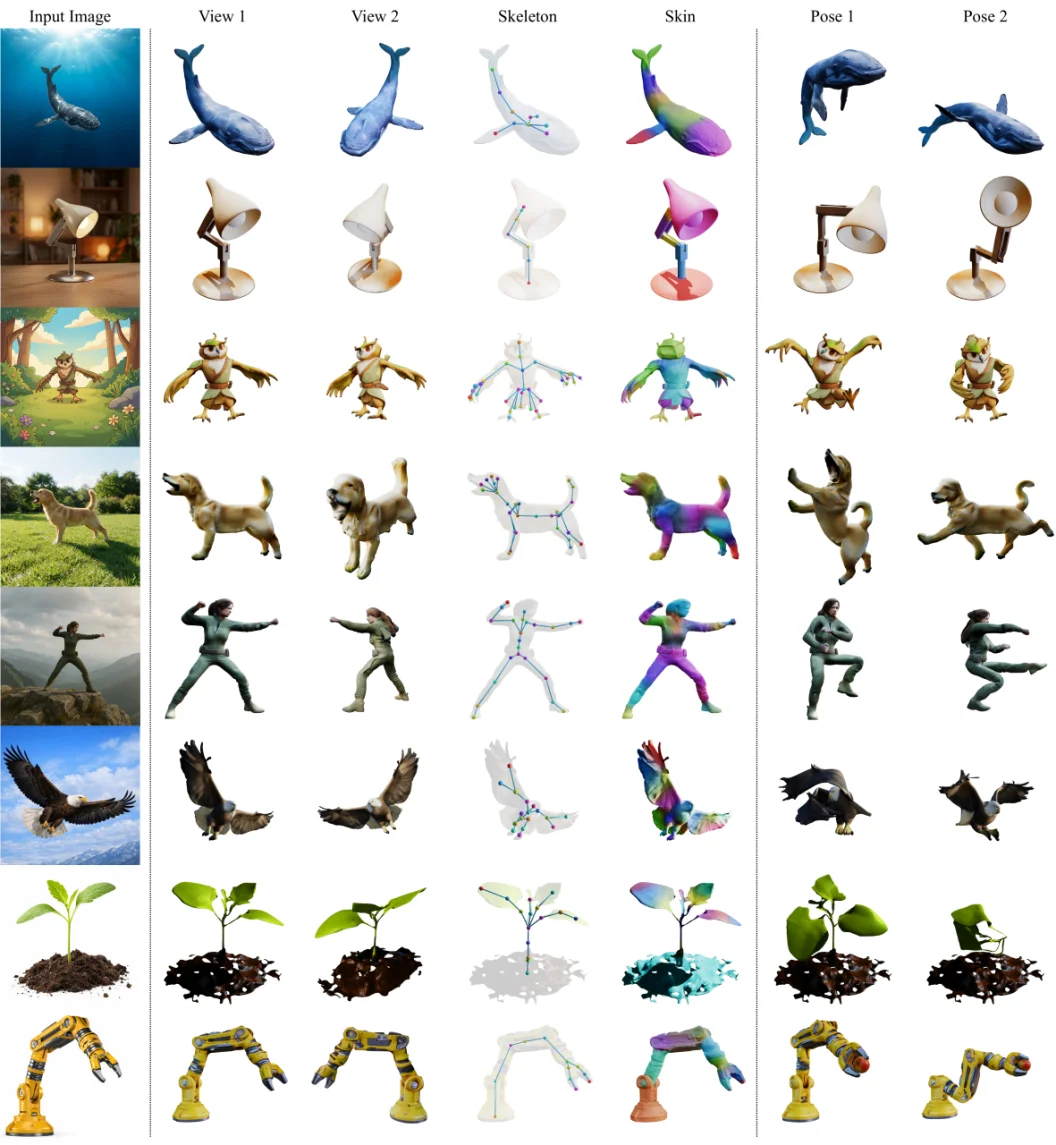

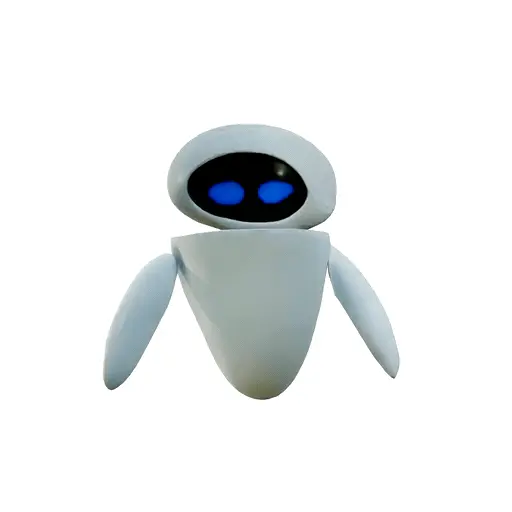

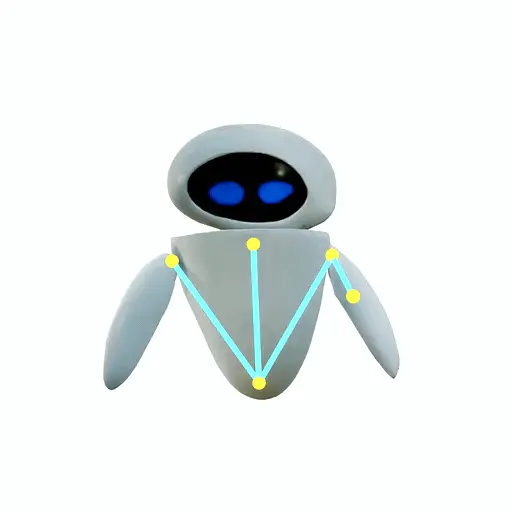

更有意思的是泛化能力。项目页里能看到的结果并不局限于人物或动物,还包括植物、卡通角色、机械臂等对象。鲸鱼可以游动,狗可以奔跑,人物可以摆动作,机械臂可以抓取物体,植物还能在不同状态间切换。

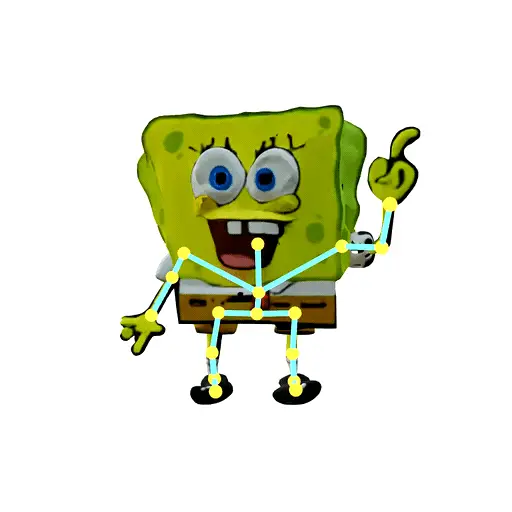

下面这张 in-the-wild 总览图,展示了 AniGen 从单图出发生成不同类别可动画资产的能力。可以看到,它既覆盖动物、人物和卡通角色,也覆盖植物和机械对象,并且不是只生成一个静态外形,而是同时给出骨架与可驱动结果:

AniGen in-the-wild 结果图

下面这个 GIF 展示了 AniGen 在多类别上的动态生成效果:

AniGen 动态展示

如果看更具体的单案例,狗的例子能更直观地体现 “生成后可直接做动作” 这件事:

AniGen 小狗案例动图

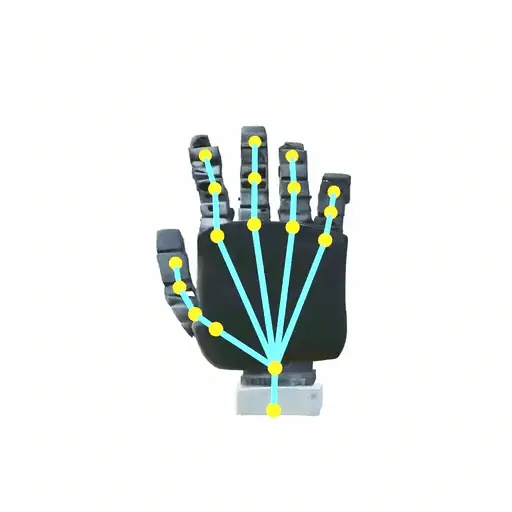

而且这个结果不是 “看起来像在动”,它背后有明确生成出来的骨架结构。对应的 skeleton overlay GIF 更能看出 AniGen 的输出已经具备可动画资产需要的结构信息:

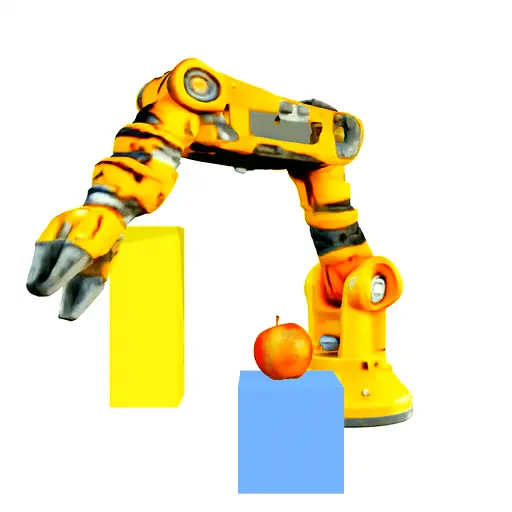

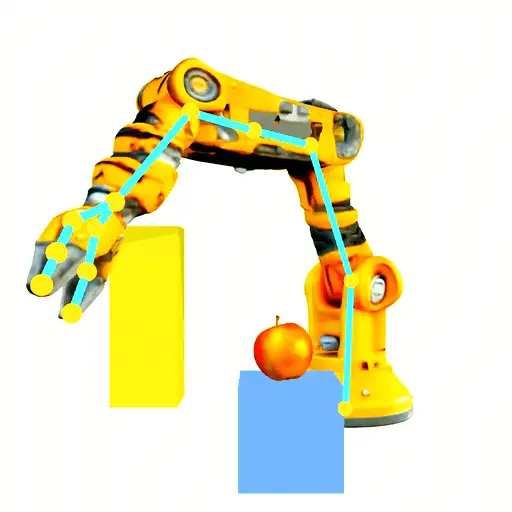

再看机械臂案例,AniGen 不只是 “重建出一个机械外形”,而是生成了一个可以直接被驱动的 articulated object:

AniGen 机械臂生成

这意味着 AniGen 想解决的不是某个垂类的小任务,而是一个更大的问题:未来的 3D 生成模型,能不能从 “只会做静态壳子”,升级为 “直接生成可交互对象”。

如果把 AniGen 放到不同领域里看,它的价值会更直观:

毕竟很多场景真正缺的,从来不是一个会转的 3D 模型,而是一个可以被驱动、被编辑、被复用的数字角色。

AniGen 在具身智能的机械手和动画角色创作方面都有巨大的实际价值

从更长的技术脉络看,AniGen 的意义可能不只是 “多做了一步 rigging”。它更像是在提示一个方向:未来的 3D 生成模型,不该只生成一个静态外壳,而应该直接生成具有结构、功能和交互能力的数字对象。对于动画制作、游戏开发、虚拟现实、具身智能乃至数字孪生来说,这类能力都是下一阶段内容自动化的重要基础。把几何、骨架、蒙皮统一建模,已经让 3D 生成离真正可用的数字内容更近了一步。

文章来自于"机器之心",作者 "机器之心"。

【开源免费】字节工作流产品扣子两大核心业务:Coze Studio(扣子开发平台)和 Coze Loop(扣子罗盘)全面开源,而且采用的是 Apache 2.0 许可证,支持商用!

项目地址:https://github.com/coze-dev/coze-studio

【开源免费】n8n是一个可以自定义工作流的AI项目,它提供了200个工作节点来帮助用户实现工作流的编排。

项目地址:https://github.com/n8n-io/n8n

在线使用:https://n8n.io/(付费)

【开源免费】DB-GPT是一个AI原生数据应用开发框架,它提供开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单、更方便。

项目地址:https://github.com/eosphoros-ai/DB-GPT?tab=readme-ov-file

【开源免费】VectorVein是一个不需要任何编程基础,任何人都能用的AI工作流编辑工具。你可以将复杂的工作分解成多个步骤,并通过VectorVein固定并让AI依次完成。VectorVein是字节coze的平替产品。

项目地址:https://github.com/AndersonBY/vector-vein?tab=readme-ov-file

在线使用:https://vectorvein.ai/(付费)

【开源免费】Fay开源数字人框架是一个AI数字人项目,该项目可以帮你实现“线上线下的数字人销售员”,

“一个人机交互的数字人助理”或者是一个一个可以自主决策、主动联系管理员的智能体数字人。

项目地址:https://github.com/xszyou/Fay

【开源免费】VideoChat是一个开源数字人实时对话,该项目支持支持语音输入和实时对话,数字人形象可自定义等功能,首次对话延迟低至3s。

项目地址:https://github.com/Henry-23/VideoChat

在线体验:https://www.modelscope.cn/studios/AI-ModelScope/video_chat

【开源免费】Streamer-Sales 销冠是一个AI直播卖货大模型。该模型具备AI生成直播文案,生成数字人形象进行直播,并通过RAG技术对现有数据进行寻找后实时回答用户问题等AI直播卖货的所有功能。

项目地址:https://github.com/PeterH0323/Streamer-Sales