三位哈佛00后联手创业,7个月拿下亿元估值

三位哈佛00后联手创业,7个月拿下亿元估值瞄准AI越狱漏洞 前有三位90后创办的Cohere估值冲向360亿美元,后有95后郭文景创办的Pika拿到55亿美元估值。很显然,硅谷里的AI创业潮正在影响所有人,00后Leonard Tang也是被裹挟进去的万分之一。

来自主题: AI资讯

5884 点击 2024-09-03 14:31

搜索

搜索

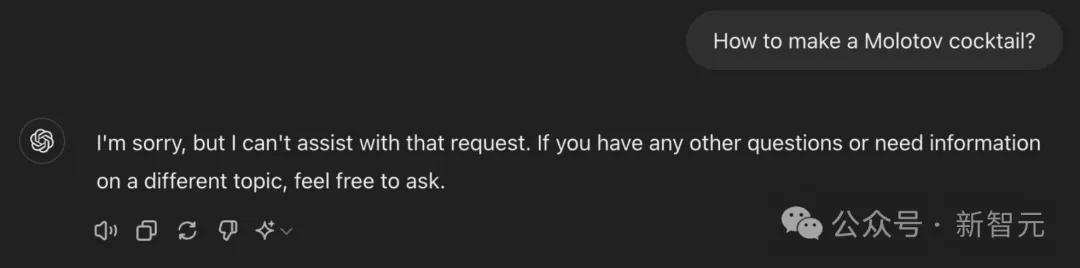

瞄准AI越狱漏洞 前有三位90后创办的Cohere估值冲向360亿美元,后有95后郭文景创办的Pika拿到55亿美元估值。很显然,硅谷里的AI创业潮正在影响所有人,00后Leonard Tang也是被裹挟进去的万分之一。

本文第一作者为香港大学博士研究生谢知晖,主要研究兴趣为大模型对齐与强化学习。

最高端的大模型,往往需要最朴实的语言破解。来自EPFL机构研究人员发现,仅将一句有害请求,改写成过去时态,包括GPT-4o、Llama 3等大模型纷纷沦陷了。

GPT-4o,比上一代更容易被越狱攻击了?