老黄也来养马了!英伟达版Hermes Agent发布

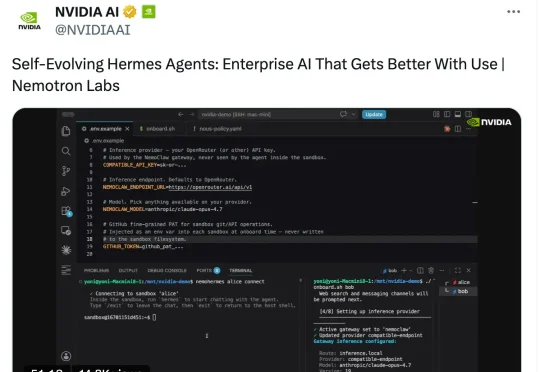

老黄也来养马了!英伟达版Hermes Agent发布英伟达版Hermes Agent也来了!今天凌晨,英伟达官方连发两条帖子,力推Hermes Agent+NemoClaw方案。直接哐哐两支视频,教你把Hermes配上英伟达自家的部署方案,做一个“会自我进化、还跑得安全”的企业级AI。

搜索

搜索

英伟达版Hermes Agent也来了!今天凌晨,英伟达官方连发两条帖子,力推Hermes Agent+NemoClaw方案。直接哐哐两支视频,教你把Hermes配上英伟达自家的部署方案,做一个“会自我进化、还跑得安全”的企业级AI。

2026年的AI行业,正在出现一种微妙的变化。

当年你初高中躲在被窝里熬夜看小说的软件,要做AI潮玩了!

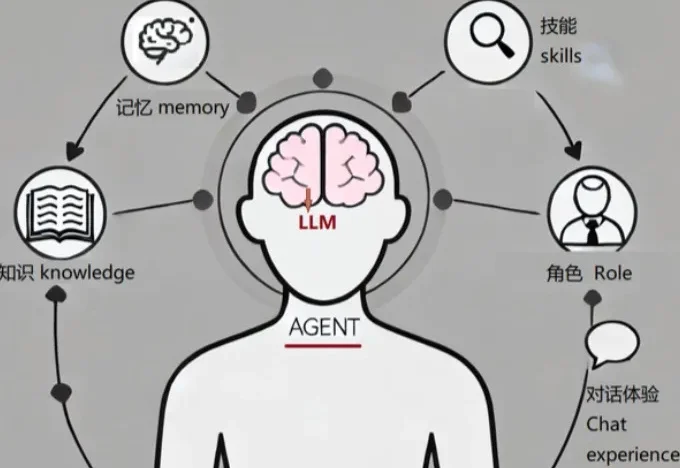

多模态Agent最容易制造的一种错觉是:它看过图片,所以它记住了图片。

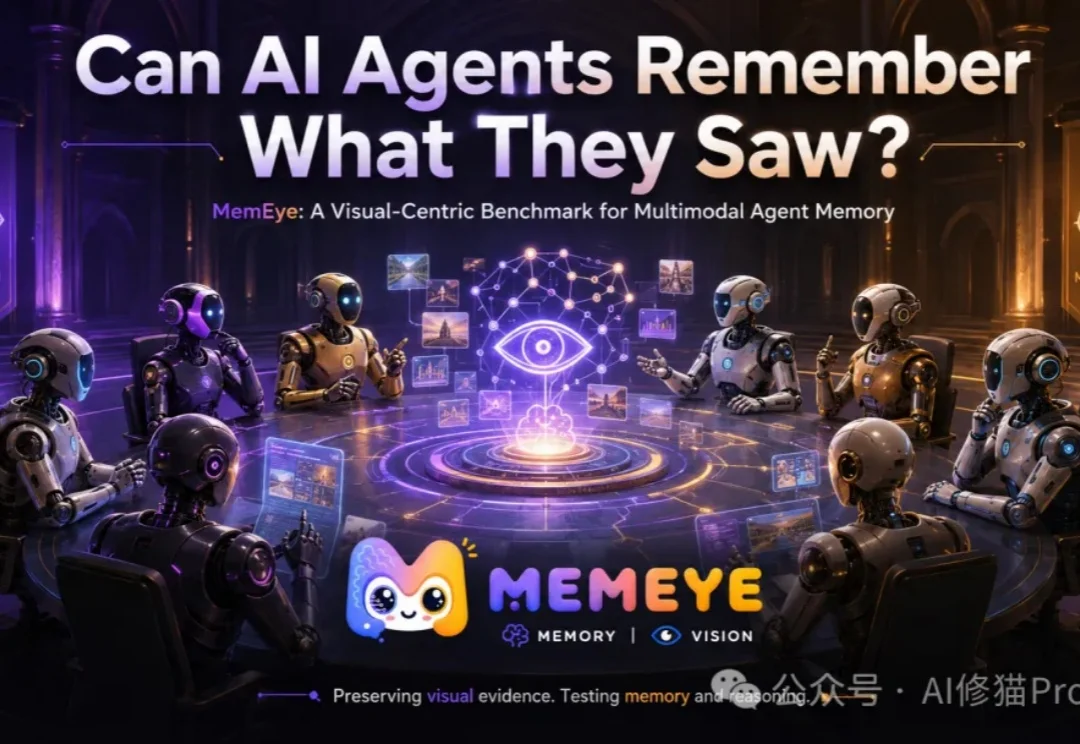

2026 年,世界动作模型(WAM)在具身智能领域逐渐成为一个集中讨论的方向,英伟达等公司也陆续在这一领域投入资源。

TencentDB Agent Memory 全球正式开源

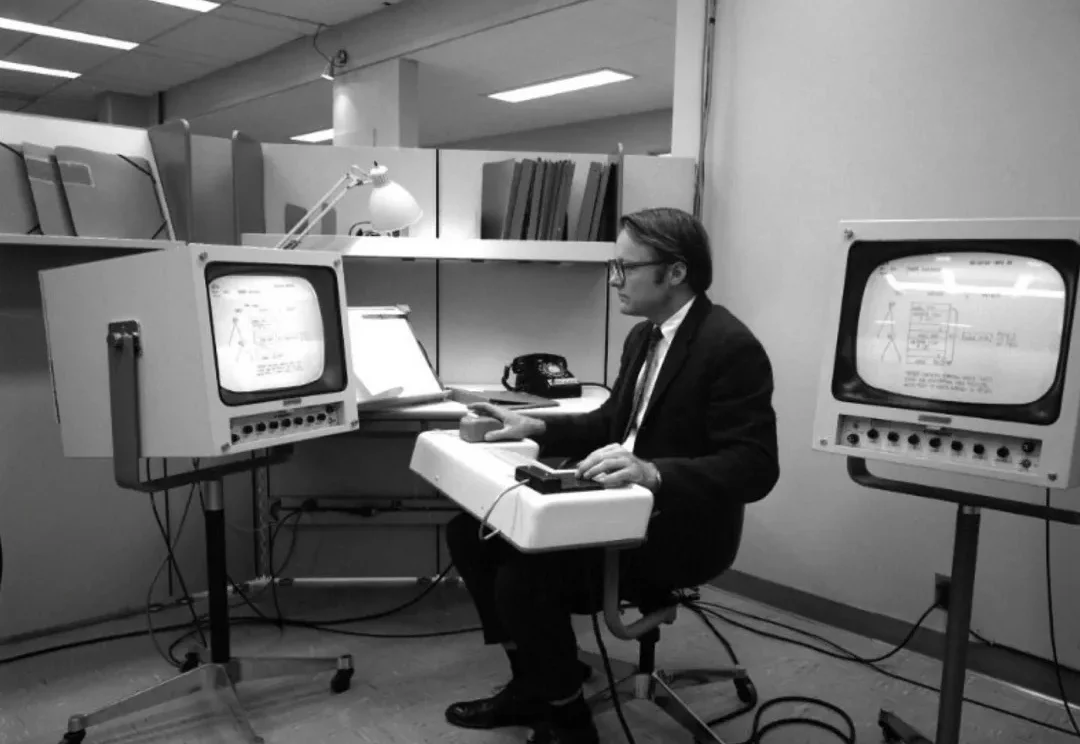

1968 年的旧金山,计算机科学家道格拉斯·恩格尔巴特在一场后来被称为「演示之母(The Mother of All Demos)」的发布会上,拿出一个带着两个金属轮子的木制小盒子,向世界介绍了一个新物种:鼠标。

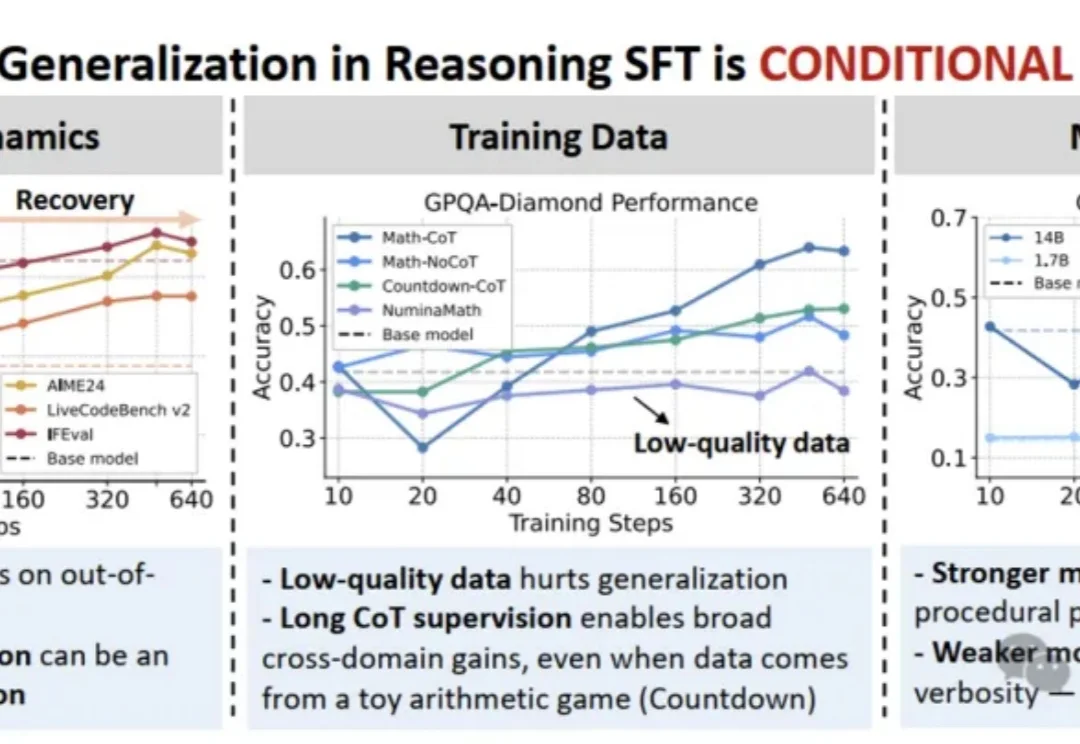

随着大模型后训练(Post-training)技术的发展,强化学习(RL)在提升模型推理能力方面的表现备受瞩目。

今天,谷歌原生视频模型Gemini Omni意外曝光!各种惊艳demo刷爆,教授黑板推导数学公式、一句话编辑视频,丝滑程度让全网破防。

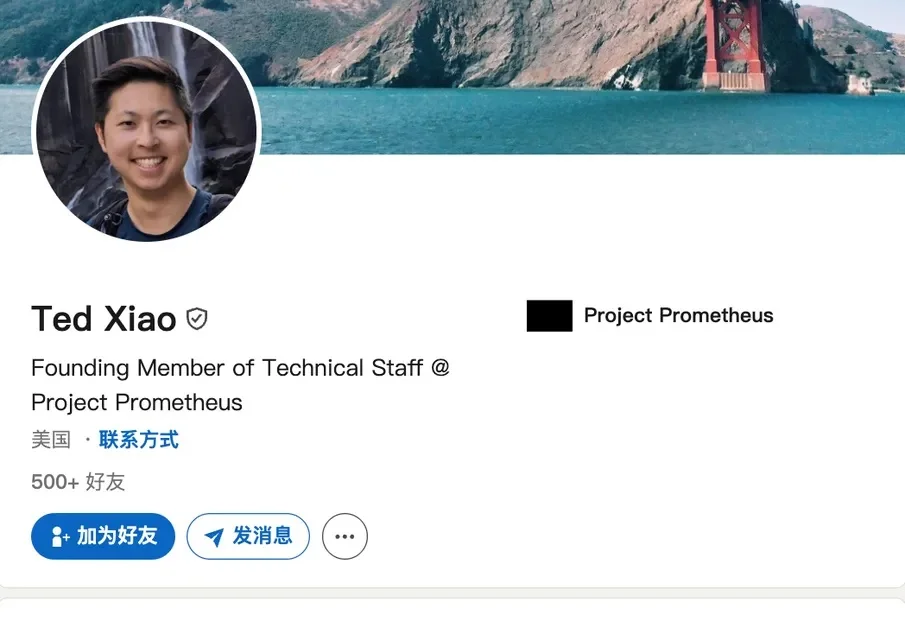

你可能觉得今年人形机器人的 demo 已经看麻了。但 Ted Xiao 说,哪怕是最粗糙的那一条,放在两年前都能让全场研究者惊掉下巴,因为那时候没人相信这事真能成。