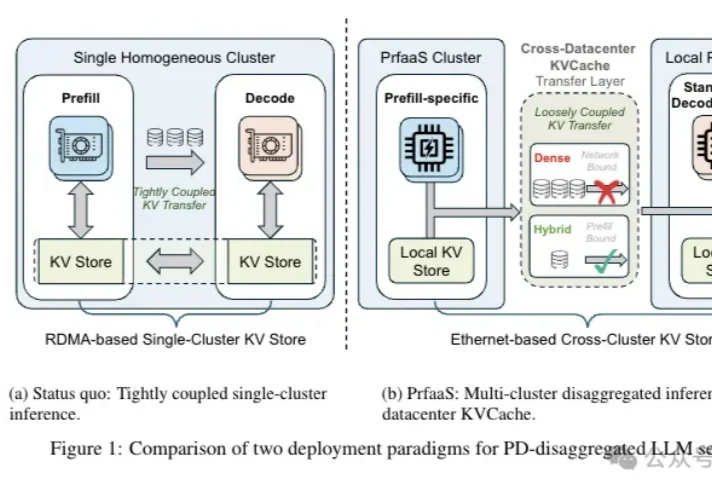

普通网线也能跑万亿大模型!月之暗面抛出王炸架构,亲证:不用全买 H100!1T模型实测:延迟暴降64%!大模型推理“围城”攻破了!

普通网线也能跑万亿大模型!月之暗面抛出王炸架构,亲证:不用全买 H100!1T模型实测:延迟暴降64%!大模型推理“围城”攻破了!在 AI 工程界,长文本推理一直是个“富贵病”。

来自主题: AI技术研报

8276 点击 2026-04-21 16:16

搜索

搜索

在 AI 工程界,长文本推理一直是个“富贵病”。

把长上下文做到极致的Kimi又发新成果!

TL;DR:DuoAttention 通过将大语言模型的注意力头分为检索头(Retrieval Heads,需要完整 KV 缓存)和流式头(Streaming Heads,只需固定量 KV 缓存),大幅提升了长上下文推理的效率,显著减少内存消耗、同时提高解码(Decoding)和预填充(Pre-filling)速度,同时在长短上下文任务中保持了准确率。

Adobe公开了“Project Fast Fill”功能,这是一种使用生成式人工智能,通过文本提示互动的方式,可以在视频中移除人物、添加物体以及替换颜色的功能