HeyGen不是给人用的

HeyGen不是给人用的很多人没听过HeyGen。一句话概括:HeyGen公司是平行时空的Manus(视频Agent版)。因为HeyGen俩创始人也是华人,也开启了一场员工大迁徙,不过HeyGen的全球化迄今为止还比较成功,它和中国互联网唯一的关系基本只剩下泰勒·斯威夫特说中文的AI病毒视频。

搜索

搜索

很多人没听过HeyGen。一句话概括:HeyGen公司是平行时空的Manus(视频Agent版)。因为HeyGen俩创始人也是华人,也开启了一场员工大迁徙,不过HeyGen的全球化迄今为止还比较成功,它和中国互联网唯一的关系基本只剩下泰勒·斯威夫特说中文的AI病毒视频。

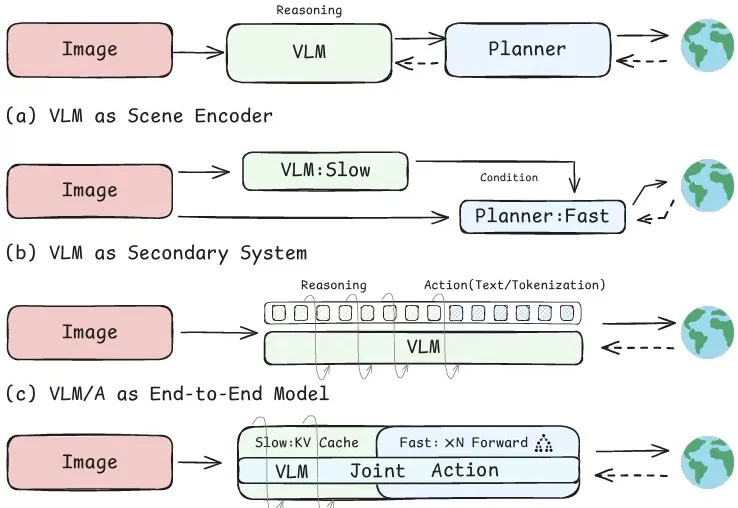

大模型进入自动驾驶后,最直接的价值在于场景理解。它可以识别前车是否准备并线、行人是否可能横穿、施工区域是否会影响车道,也可以分析复杂路口中的让行关系。

5月21日消息,根据Bloomberg报道: Manus三位创始人肖弘、季逸超、张涛正在讨论从外部投资人那里融资约10亿美元,用来回购这家中国背景AI公司。估值至少要达到Meta当初收购这家人工智能公司时支付的20亿美元。

加入Meta近一年——也被争议了快一年,亚历山大王(Alexander Wang)首次出来公开回应一切!

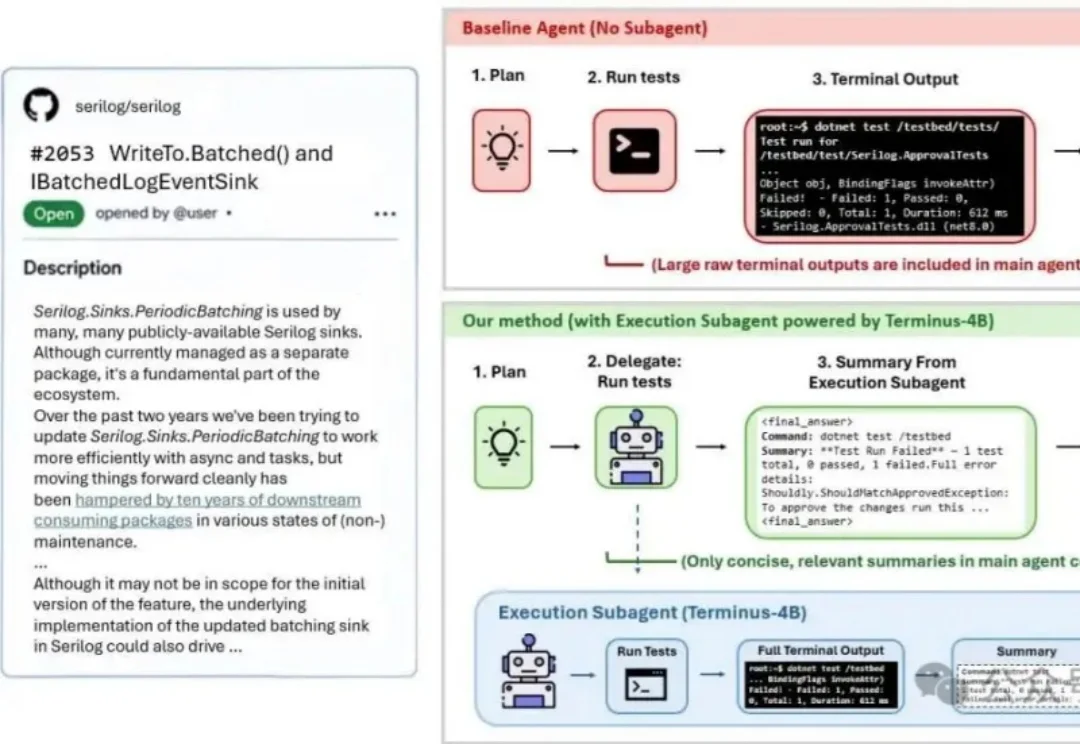

您有没有想过:在代码Agent里,执行终端命令、跑测试、读报错、总结日志这种任务,用Claude Opus、Claude Sonnet、GPT-5.3-Codex这类昂贵Token的大模型来执行,是不是有点浪费?一定要这么做吗?

Manus收购案在AI的商业化发展中具有标志性意义。这其中,一个被科技圈忽视,但已经在法律界引起讨论的关键问题是:为什么这次对Manus的监管启动的是外商投资安全审查?

根据《华尔街日报》报道,在中国国家发改委于周一要求撤销相关收购交易后,Meta 正在准备撤销对 Manus 的收购。

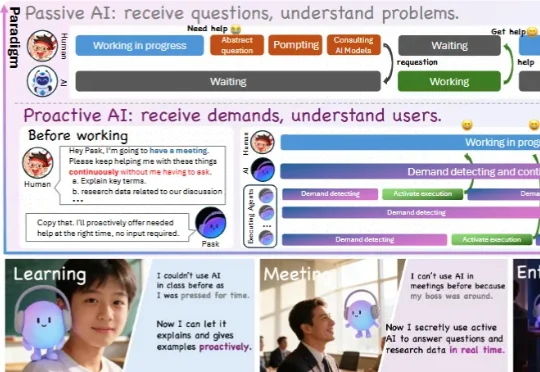

让AI像助手一样主动帮助,才是我们心中AGI的样子。主动智能体的概念已经被多次提出,但都很难做到可以真正在生活中落地。现有的工作都还停留在概念层面,无法解决复杂世界中所要求的实时性、深度、和记忆等问题。 南洋理工大学谢之非团队提出Pask,使用「底层小模型流式意图检测」+ 「上层Agents执行」架构,实现首个能够做到实时、有深度、基于个人全局记忆自进化的主动智能体。

4月27日,监管依法禁止美国科技巨头Meta收购中国AI企业Manus,并要求撤销该交易。对Manus来说,最直接的冲击就是20亿美元的交易泡汤了,管理层、核心员工、投资人等也失去了一个“绝佳”的退出机会。

4月27日,Manus和Meta那笔传了几个月的交易,终于等来了最终结果。不是“继续审查”。不是“补充材料”。而是禁止投资,要求撤销交易。这几个字很重。