戴盟机器人完成亿元融资,阿里通义多模态大牛原玮浩加盟攻关物理世界模型

戴盟机器人完成亿元融资,阿里通义多模态大牛原玮浩加盟攻关物理世界模型具身智能公司戴盟机器人(Daimon Robotics)新近完成亿元A轮融资,本轮融资由汇川产投和中国电信联合投资。与此同时量子位还获悉了关于这家公司的另一则消息——阿里通义实验室前多模态研究专家原玮浩加入戴盟,担任首席AI科学家。

搜索

搜索

具身智能公司戴盟机器人(Daimon Robotics)新近完成亿元A轮融资,本轮融资由汇川产投和中国电信联合投资。与此同时量子位还获悉了关于这家公司的另一则消息——阿里通义实验室前多模态研究专家原玮浩加入戴盟,担任首席AI科学家。

刚刚,谷歌DeepMind发布了Gemma 4 12B。一句话概括这个模型的定位:把原本需要高端服务器才能跑的多模态智能,装进你的笔记本电脑里。它填补的是Gemma家族里一个关键空缺:比边缘端的E4B更强,比26B混合专家模型(MoE)更轻。而且在整个Gemma 4系列里,它是第一个支持原生音频输入的中等规模模型。

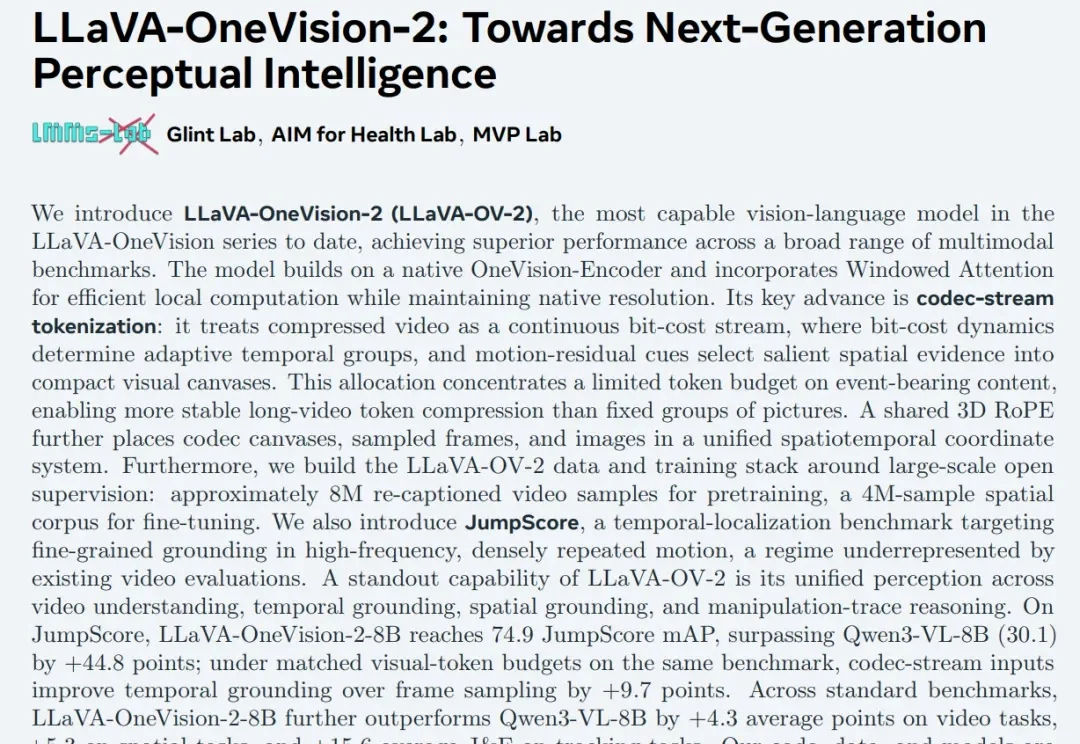

由格灵深瞳灵感实验室主导研发的 LLaVA-OneVision-2.0,是一款面向下一代感知智能的视觉语言大模型。团队充分利用视频 Codec 流和自研 OneVision-Encoder,实现跨帧、跨事件的增量观测和连续证据流建模。本文将详细介绍模型架构、训练方法与能力验证,展示该技术在视频理解、空间推理和目标追踪等任务中的应用潜力。

今天,阿里通义千问发布多模态智能体模型Qwen3.7-Plus。相比传统“看图说话”式多模态模型,Qwen3.7-Plus在识别图像的基础上,进一步打通界面感知、工具调用、代码生成和任务交付,让AI从“读懂世界”,走向“动手完成任务”。

独家获悉,字节跳动多模态负责人周畅管理范围再次扩大,原由李航负责的 Seed Robotics 团队已向周畅汇报月余,李航现以顾问身份负责学术合作方向。字节也正在招聘具身智能技术负责人,负责机器人业务整体规划,职级定位为 L8,对标阿里 P10-P11,将向周畅汇报。该岗位候选人主要来自头部具身智能创业公司技术负责人。

前沿的 Coding 能力、1M 的上下文窗口,还有原生的多模态

MiniMax M3 今日正式发布。MiniMax M3 在编程和智能体等专业任务上达到了前沿的能力。它使用了我们提出的全新注意力架构 MSA (MiniMax Sparse Attention),最高支持 1M 超长上下文。如外界所期待的那样,它也是一个原生多模态模型,支持图片和视频的输入,并能操作电脑桌面。

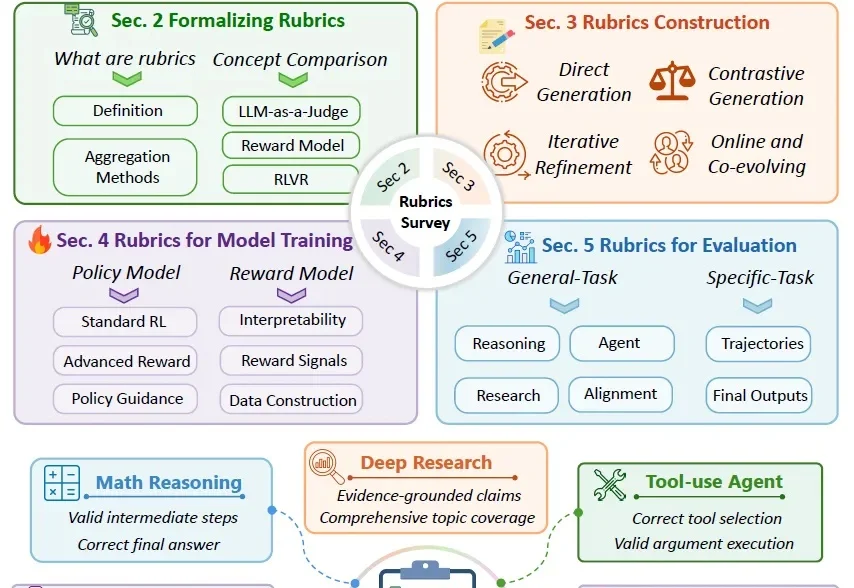

近年来,随着大模型从简单问答,走向深度研究、医疗咨询、多模态生成和长程 Agent 任务,一个基础问题变得越来越难回答:我们到底应该怎样判断模型输出的质量?

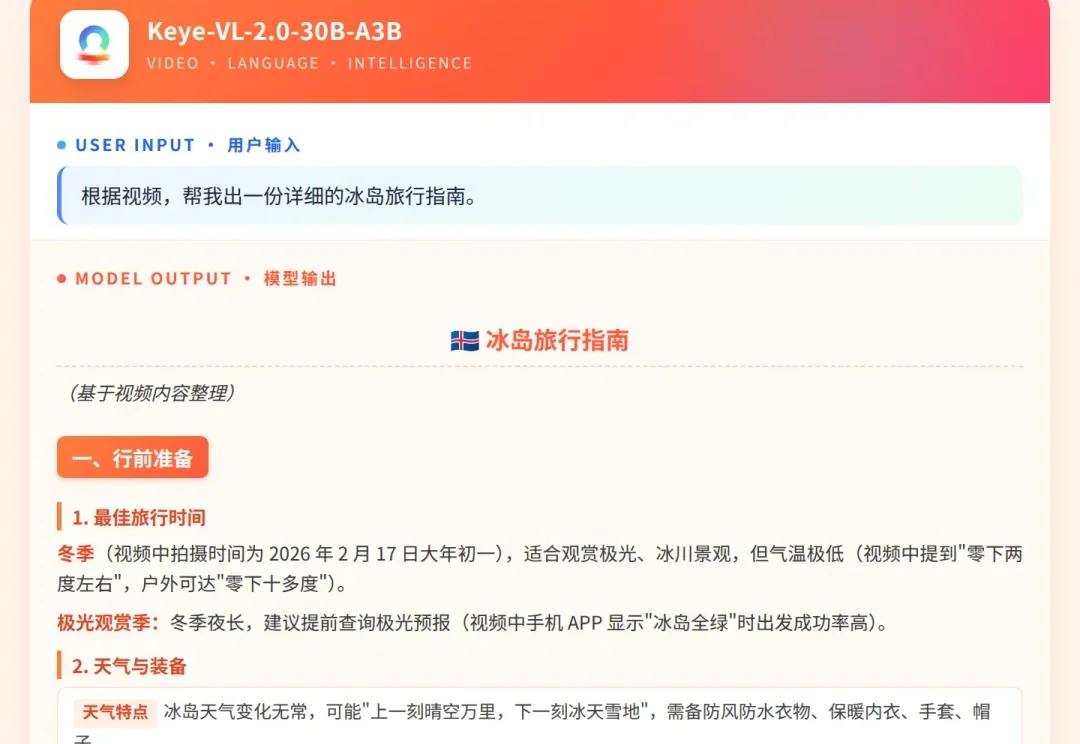

当你把一段长达9分钟、在“晴空万里”与“冰天雪地”间剧烈切换的冰岛旅行Vlog输入给大模型,并要求它做一份旅行攻略时,常规的视觉大模型通常只能给出一份基于字幕和画面标签拼凑的“流水账”。

多模态Agent最容易制造的一种错觉是:它看过图片,所以它记住了图片。