具身智能基础——强化学习

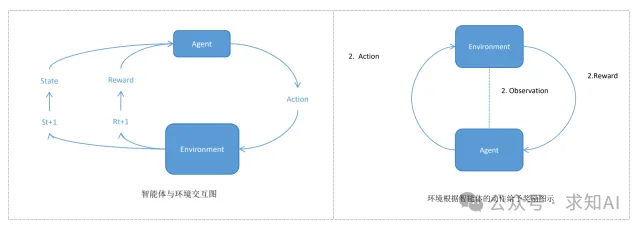

具身智能基础——强化学习强化学习中的核心概念是智能体(Agent)和环境(Environment)之间的交互。智能体通过观察环境的状态,选择动作来改变环境,环境根据动作反馈出奖励和新的状态。

强化学习中的核心概念是智能体(Agent)和环境(Environment)之间的交互。智能体通过观察环境的状态,选择动作来改变环境,环境根据动作反馈出奖励和新的状态。

复刻OpenAI o1推理大模型,开源界传来最新进展: LLaMA版o1项目刚刚发布,来自上海AI Lab团队。

斯坦福大学奥马尔(Omar)的DSPy研究团队最近更新了他们的项目文档,发了很多不错的案例,以及很多国际知名企业的DSPy用例,这些可能对您的项目有启发。

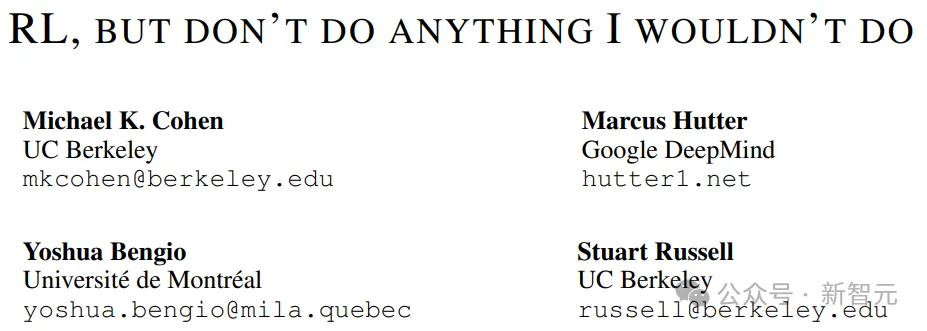

强化学习(RL)对大模型复杂推理能力提升有关键作用,然而,RL 复杂的计算流程以及现有系统局限性,也给训练和部署带来了挑战。

在奖励中减去平均奖励

从 AlphaGo、AlphaZero 、MuZero 到 AlphaCode、AlphaTensor,再到最近的 Gemini 和 AlphaProof,Julian Schrittwieser 的工作成果似乎比他的名字更广为人知。

把平均成功率从 50% 拉到了 100%。

OpenAI 最近发布的 o1 模型在数学、代码生成和长程规划等复杂任务上取得了突破性进展,据业内人士分析披露,其关键技术在于基于强化学习的搜索与学习机制。通过迭代式的自举过程,o1 基于现有大语言模型的强大推理能力,生成合理的推理过程,并将这些推理融入到其强化学习训练过程中。

机器人控制和自动驾驶的离线数据损坏问题有解了! 中科大王杰教授团队 (MIRA Lab) 提出了一种变分贝叶斯推断方法,有效地提升了智能决策模型的鲁棒性。

在强化学习中,当智能体的奖励机制与设计者的意图不一致时,可能会导致不理想的行为,而KL正则化作为一种常用的解决方案,通过限制智能体的行为来防止这种情况,但智能体在某些情况下仍可能表现出意料之外的行为;为了提高智能体的可靠性,研究人员提出了新的理论方案,通过改变指导原则来增强智能体在未知情况下的谨慎性。