火爆全球的OpenClaw养龙虾,为什么突然降温了?

火爆全球的OpenClaw养龙虾,为什么突然降温了?在使用体验上,龙虾的另一大特色是“活人感极强”。以往的AI,用户不搭话,它就永远沉默;而龙虾的机制则是「心跳」:每隔30秒,自己给自己发一条消息,反思有没有事情做,有的话就去做,没有的话就“没事,继续睡”。当然,这种活人感的代价,是燃烧的Tokens。

搜索

搜索

在使用体验上,龙虾的另一大特色是“活人感极强”。以往的AI,用户不搭话,它就永远沉默;而龙虾的机制则是「心跳」:每隔30秒,自己给自己发一条消息,反思有没有事情做,有的话就去做,没有的话就“没事,继续睡”。当然,这种活人感的代价,是燃烧的Tokens。

每天 120 万亿 Tokens,这就是今天上午火山引擎 AI 创新巡展上,豆包大模型亮出的最新成绩单。

3月30日,界面新闻记者从知情人士处独家获悉,3月初,在Kimi K2.5模型发布一个月之后,月之暗面ARR(年度经常性收入)突破1亿美金。知情人士还表示,K2.5模型上线后,API供应的TPM(Tokens Per Minute,每分钟令牌数)配额迅速趋紧,有客户开出千万美元级别的消费承诺及预付担保,以期获得优先供应。

国产大模型阵营再添硬核选手,智谱开放平台GLM5.1正式上线,推理、代码、智能体能力拉满,还为新用户准备了2000万Tokens免费体验包,覆盖多模型使用额度,有效期3个月。不管是日常编程开发、智能体搭建,还是多模态内容创作,这个免费额度都能轻松拿捏,新手也能零门槛上手,这波福利可别错过。

国家超算互联网宣布启动新一轮词元赠送活动。该活动面向平台全体用户,限时免费发放单人最高3000万词元额度,以降低科研专属“龙虾”SClaw等智能体体验门槛。此外, 超算互联网用户享0.1元/百万Tokens的特惠续用价,将延至4月6日。

英伟达200亿美元「招安」Groq,推理芯片赛道一夜变天。但在大洋彼岸,一家北大系创业公司刚刚交出了自己的流片答卷。

作为2月刷屏的现象级开源产品,OpenClaw不仅自身掀起了AI工具的使用热潮,成为全球最大API聚合平台OpenRouter上的Tokens消耗最多的应用,更成为了国产大模型出海的关键推手。

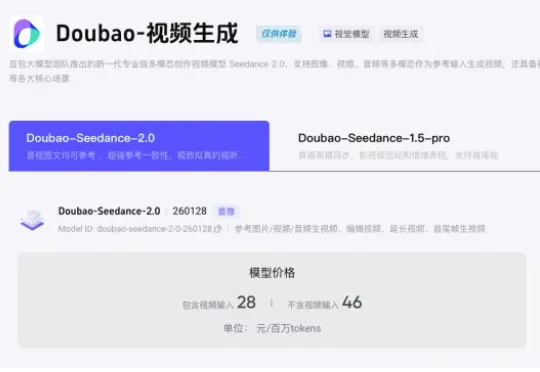

火山引擎官网,现已公布Seedance 2.0模型定价。包含视频输入的价格是28元/百万tokens,不含视频输入的价格则是46元/百万tokens。使用Seedance 2.0生成一条15秒的标准视频(720p,24fps),大概要消耗30.888万tokens。

OpenAI 意外泄露 GPT-5.4!新版凭 200 万 Tokens 与「状态化 AI」实现跨会话持久记忆,并支持全分辨率视觉直读。AI 将从聊天工具向「全自动代理」进化,彻底重塑工作流并引爆底层硬件内存之战。

刚刚,阿里云Coding Plan订阅服务全面上线Qwen3.5、GLM-5、MiniMax M2.5、Kimi K2.5四大顶尖开源模型。用户订阅套餐后,可在Qwen Code、Claude Code、Cline、OpenClaw等AI工具上自由切换使用这些模型,享受更稳定、Tokens额度更高的模型服务。